神经网络激活函数是深度学习中不可或缺的一部分,它们赋予网络非线性学习能力,从而让模型能够处理复杂的输入数据。本文汇总了30种常见的神经网络激活函数,包括了25种配有时函数图像及其导数图像,以帮助理解和选择最适合特定任务的函数。

1. **阶跃函数(Step函数)**:起源于早期神经网络对人类神经元行为的模拟,输出仅在输入超过阈值0时为1,其他为0。它的主要特点是具有非连续性,不可导,因此不适合梯度优化。

2. **Signum函数**:是对阶跃函数的扩展,同样不可导,但提供了二值输出的能力,用于二分类问题。

3. **线性函数(Identity)**:可导且导数恒为1,适合用于线性回归任务,但不能处理非线性问题。在输出层使用时,可以保持线性部分的简单计算。

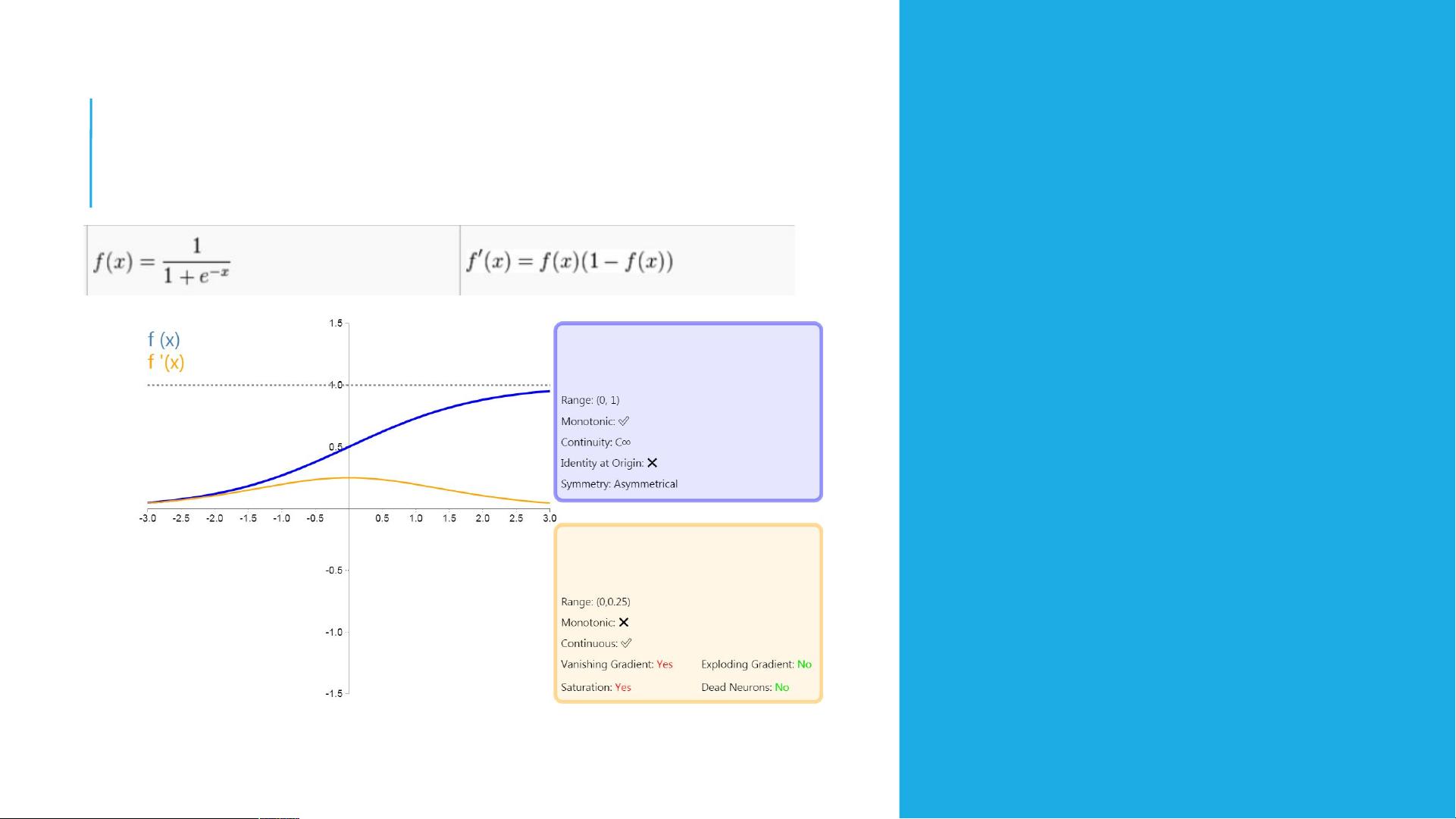

4. **Sigmoid函数(S函数)**:输出范围在(0,1),用于概率映射,常用于二分类问题。缺点是梯度软饱和,可能导致梯度消失,且运算速度较慢。

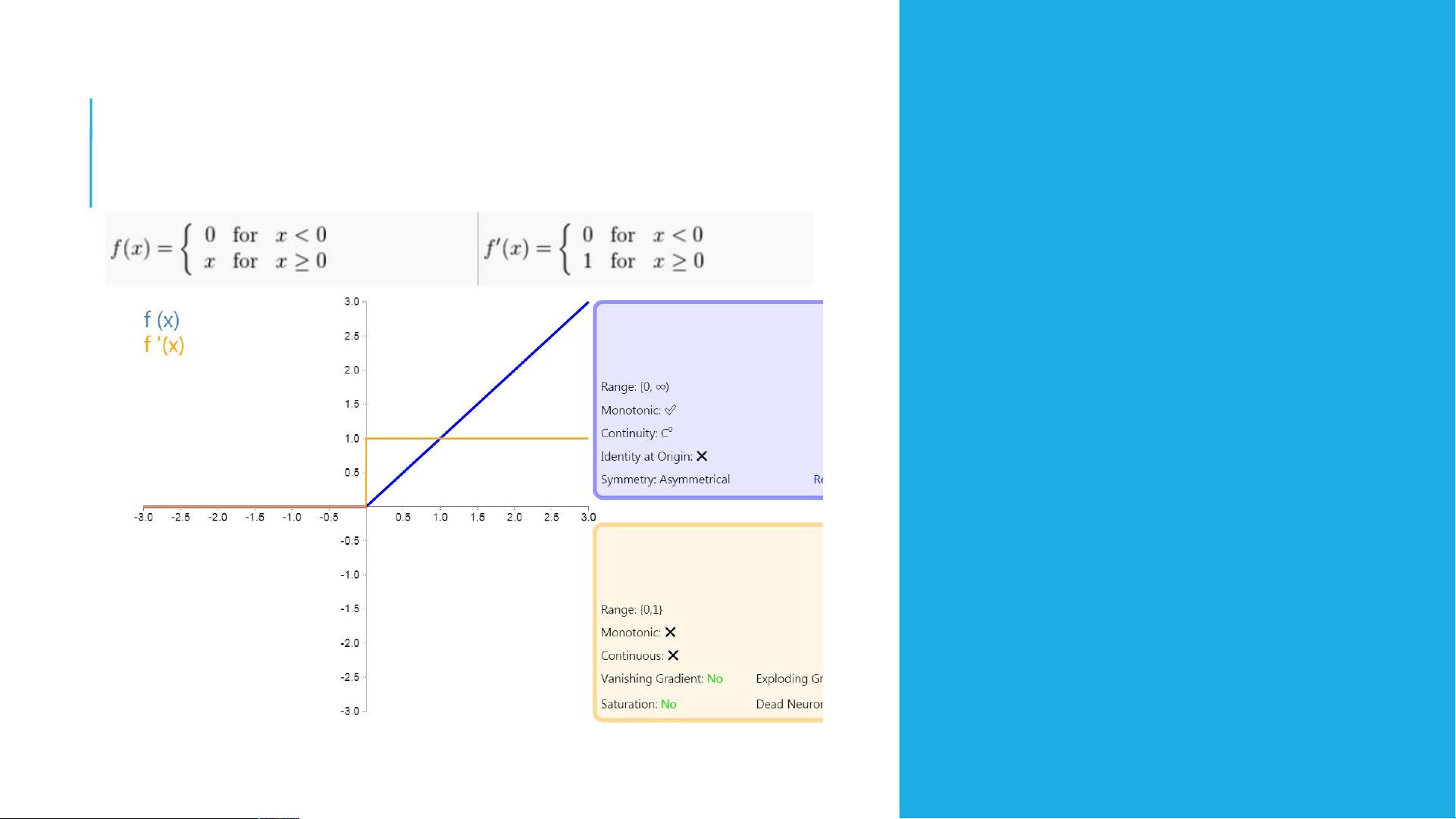

5. **ReLU(线性修正单元)**:分段函数,优点是学习速度快,部分可导,但存在硬饱和现象,即负数输入导致神经元“死亡”;平均输出不为0,可能产生偏移。

6. **Logistic函数系列**:

- **LogLog函数**:饱和更快,零点值大于0.5,有助于缓解梯度消失,但仍存在软饱和问题。

7. **Tanh函数**:输出范围(-1,1),解决了Sigmoid的均值问题,但同样有梯度软饱和和速度慢的缺点。

8. **Leaky ReLU**:修正了ReLU的负数区间问题,使得负数部分有较小的斜率,避免了神经元死亡。

9. **ELU(Exponential Linear Unit)**:在负数区间的斜率不是零,解决了一些ReLU的问题,同时也缓解了梯度消失。

10. **Softmax**:用于多分类任务,将多个神经元的输出转换为概率分布,输出始终为正且总和为1。

11. **HardSigmoid**:Sigmoid的线性近似,加速了运算速度,但牺牲了一定的精确性。

理解这些激活函数的特性和适用场景,对于构建高效、稳定的神经网络模型至关重要。选择正确的激活函数可以帮助网络更好地拟合数据,提高模型性能,并减少训练过程中的问题。实践中,通常会根据具体任务的需求和模型的特性,结合实验对比不同激活函数的效果。