双向学习架构提升点云场景流估计精度

110 浏览量

更新于2024-06-19

收藏 1.15MB PDF 举报

"2022年欧洲计算机视觉会议(ECCV)上提出了一种名为Bi-PointFlowNet的新型点云场景流估计架构,通过引入双向流嵌入层和分层特征提取与变形来提高准确性并减少计算开销。该方法在FlyingThings3D和KITTI基准测试中表现出色,超越了其他现有技术。"

点云场景流估计是计算机视觉领域中的一个重要任务,用于从连续的3D点云帧中捕捉每一点的运动信息。这一技术在自动驾驶、机器人导航等领域有广泛应用,因为它能提供动态环境的基础信息。传统的场景流估计方法主要基于二维RGB图像,但随着LiDAR传感器的发展,点云数据成为了研究的新焦点。

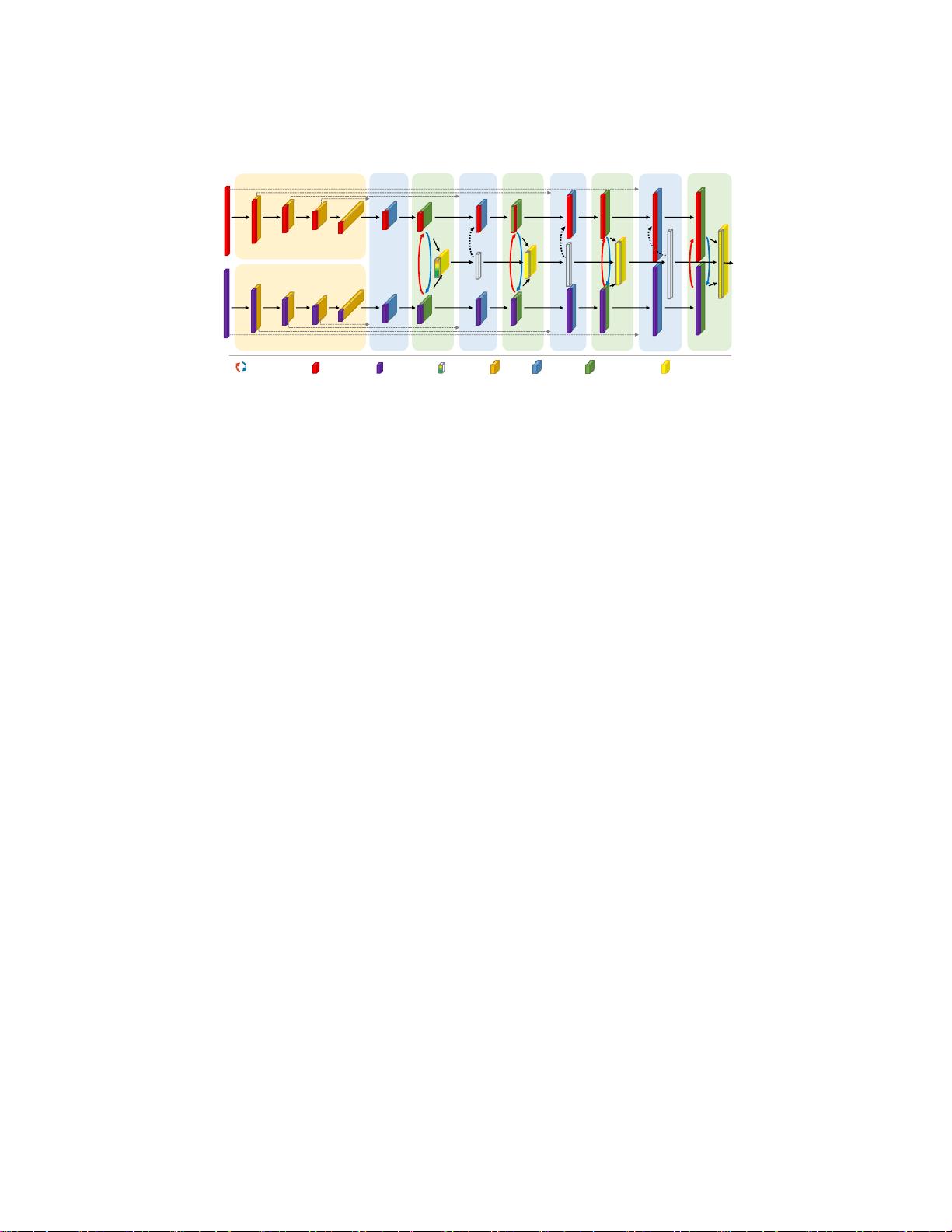

Bi-PointFlowNet是基于点云的场景流估计模型的创新,它弥补了现有方法的不足,即只利用单向特征。该模型采用了双向学习策略,不仅从前向传播中学习,还从后向传播中学习,这样可以捕获更多的上下文信息,从而提高估计的准确性和模型的泛化能力。此外,通过分层特征提取和变形,Bi-PointFlowNet能够更有效地处理不同尺度的运动,并降低计算复杂度。

论文中提到的早期工作,如FlowNet3D,首次将点云数据引入场景流估计,使用PointNet++的分层结构。后来的研究,如多尺度相关传播结构和PointPWC,进一步提升了估计的精度。尽管这些方法在一定程度上解决了问题,但它们仍然局限于单向特征的利用。

Bi-PointFlowNet的独特之处在于其双向设计,这使得模型可以从两个方向获取和融合信息,形成更丰富的特征表示。通过双向传播,估计的场景流可以与源帧一起变形,便于与目标帧进行对比,从而实现更精确的匹配和流估计。这种方法在实际测试中显示了优越的性能,证明了其在点云场景流估计领域的先进性。

关键词:场景流估计,点云,双向学习,特征提取,变形,自动驾驶,机器人导航,LiDAR传感器,FlowNet3D,PointNet++,PointPWC,最佳运输解决模块。

此研究对计算机视觉和自动驾驶领域的进步有着显著的贡献,其提出的双向学习架构为点云处理提供了一个新的视角,有望推动未来相关技术的进一步发展。有兴趣的读者可以通过作者提供的链接获取更多的论文信息以及相关的开源代码,进一步探索和应用这一技术。

2017-03-26 上传

2021-09-28 上传

2022-04-21 上传

2024-09-03 上传

2023-09-27 上传

2023-03-21 上传

2023-07-27 上传

2024-04-12 上传

2023-05-04 上传

cpongm

- 粉丝: 5

- 资源: 2万+

最新资源

- 构建Cadence PSpice仿真模型库教程

- VMware 10.0安装指南:步骤详解与网络、文件共享解决方案

- 中国互联网20周年必读:影响行业的100本经典书籍

- SQL Server 2000 Analysis Services的经典MDX查询示例

- VC6.0 MFC操作Excel教程:亲测Win7下的应用与保存技巧

- 使用Python NetworkX处理网络图

- 科技驱动:计算机控制技术的革新与应用

- MF-1型机器人硬件与robobasic编程详解

- ADC性能指标解析:超越位数、SNR和谐波

- 通用示波器改造为逻辑分析仪:0-1字符显示与电路设计

- C++实现TCP控制台客户端

- SOA架构下ESB在卷烟厂的信息整合与决策支持

- 三维人脸识别:技术进展与应用解析

- 单张人脸图像的眼镜边框自动去除方法

- C语言绘制图形:余弦曲线与正弦函数示例

- Matlab 文件操作入门:fopen、fclose、fprintf、fscanf 等函数使用详解