奇异值分解(SVD):理论与应用探索

需积分: 42 34 浏览量

更新于2024-09-08

收藏 316KB DOCX 举报

"本文主要探讨了奇异值分解与特征值分解的概念,以及它们在机器学习领域的应用,如主成分分析PCA和潜在语义索引LSI。奇异值分解(SVD)是一个具有明显物理意义的矩阵表示方法,可以用于特征提取和数据压缩。尽管本文并未深入讨论奇异值的计算方法,但提到了它的重要性,并指出线性代数基础对于理解这些概念至关重要。"

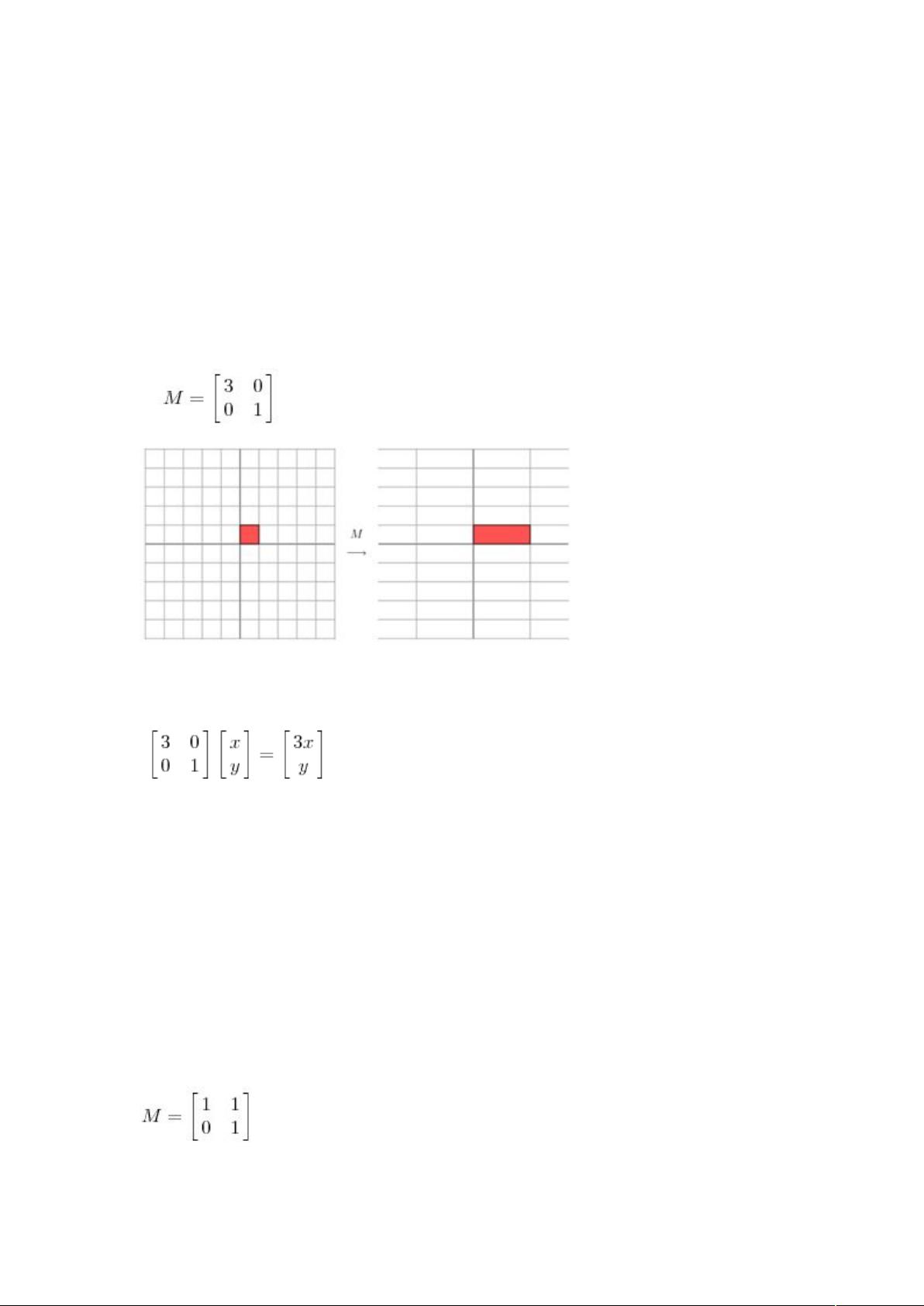

在线性代数中,特征值和奇异值是两个关键的概念,它们对于理解和处理矩阵运算有着重要作用。特征值分解是针对方阵的一种分解方式,当一个矩阵A作用于一个向量a时,如果结果只是a乘以一个常数λ,那么a就是A的特征向量,λ则是对应的特征值。特征值和特征向量揭示了矩阵的固有性质,例如矩阵的对角化可能性和稳定性。

奇异值分解则是对任意大小的矩阵A的一种分解,它将A表示为三个矩阵的乘积:UΣV^T,其中U和V是单位正交矩阵,Σ是对角矩阵,其对角线元素是A的奇异值σi(A)。奇异值是A的变换能力的度量,它们是非负的,并按降序排列。奇异值分解在处理非方阵时特别有用,因为它能够捕获矩阵的主要特性,如秩、条件数和数据压缩。

在机器学习领域,特征值分解常用于执行主成分分析(PCA),这是一种数据降维技术。PCA通过找到数据方差最大的方向来提取最重要的特征,这通常通过计算数据协方差矩阵的特征值和特征向量来实现。而奇异值分解则在PCA的另一种实现中扮演关键角色,因为它可以更高效地完成相同的目标,同时提供额外的性质,如数据的近似重构。

奇异值分解还应用于数据压缩,特别是在图像处理中。通过保留矩阵Σ中较大的几个奇异值并忽略较小的奇异值,可以有效地减少数据的存储空间,同时保持大部分信息。这种方法在图像压缩算法中非常常见,如JPEG。

此外,奇异值分解在信息检索和自然语言处理中有广泛应用,如潜在语义索引(LSI)。LSI利用SVD来挖掘文本语料库中的隐藏语义关系,从而改进搜索引擎的检索效果,使查询能够匹配文档的深层含义,而不仅仅是表面的关键词匹配。

特征值分解和奇异值分解是数据分析和机器学习中不可或缺的工具。虽然本文并未深入探讨计算细节,但它强调了这两个概念的实际应用价值,并鼓励读者通过深入学习线性代数来更好地理解和利用这些工具。在线性代数基础上进一步研究这些理论,将有助于在实际问题中更有效地应用它们。

"探索特征值分解与奇异值分解在信噪比估计算法中的应用,及Matlab在最小目标方程(MDL)求解中的应用方法",不同信号的信噪比估计算法 特征值分解、奇异值分解算法 MDL最小目标方程 Matlab实

2025-02-06 上传

1097 浏览量

129 浏览量

点击了解资源详情

2024-11-06 上传

信噪比估计算法与特征值、奇异值分解技术的融合应用及Matlab实现方法,基于特征值与奇异值分解的信噪比估计算法研究及Matlab实现方法,不同信号的信噪比估计算法 特征值分解、奇异值分解算法 MDL最

2025-02-19 上传

440 浏览量

所罗门的恶魔

- 粉丝: 0

最新资源

- A7Demo.appstudio:探索JavaScript应用开发

- 百度地图范围内的标注点技术实现

- Foobar2000绿色汉化版:全面提升音频播放体验

- Rhythm Core .NET库:字符串与集合扩展方法详解

- 深入了解Tomcat源码及其依赖包结构

- 物流节约里程法的文档整理与实践分享

- NUnit3.vsix:快速安装NUnit三件套到VS2017及以上版本

- JQuery核心函数使用速查手册详解

- 多种风格的Select下拉框美化插件及其js代码下载

- Mac用户必备:SmartSVN版本控制工具介绍

- ELTE IK Web编程与Web开发课程内容详解

- QuartusII环境下的Verilog锁相环实现

- 横版过关游戏完整VC源码及资源包

- MVC后台管理框架2021版:源码与代码生成器详解

- 宗成庆主讲的自然语言理解课程PPT解析

- Memcached与Tomcat会话共享与Kryo序列化配置指南