0公式解析:全连接与卷积神经网络的全貌

版权申诉

165 浏览量

更新于2024-08-04

收藏 428KB PDF 举报

"《不要再纠结卷积的公式啦!0公式深度解析全连接前馈网络与卷积神经网络》是一篇深入浅出的文章,作者是一位专注于深度学习和机器学习的专家,名叫丷小瑶。文章主要针对卷积神经网络(CNN)进行讲解,避免直接从复杂的卷积公式入手,而是从更基础的全连接前馈神经网络开始分析。

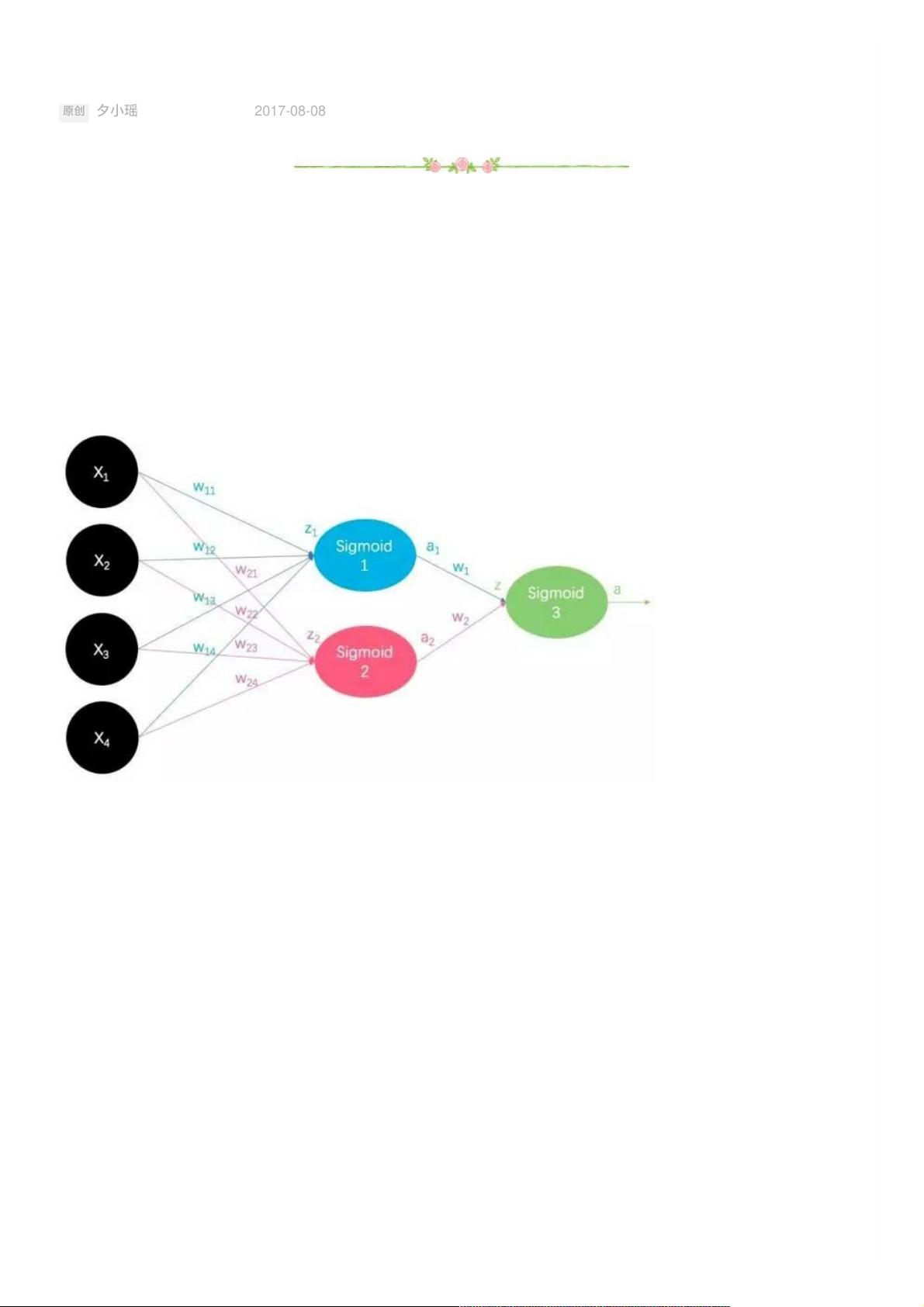

全连接前馈神经网络是一种简单的多层神经网络结构,每个节点(隐单元)直接连接到下一层的所有节点。在处理图像数据时,如果直接将高维的像素值作为输入,可能会导致特征冗余且缺乏针对性。例如,一个100*100像素的图像可能有10000个特征,但这些特征与图像中的对象特征关联度并不高。

为了提高模型的表达能力,作者提出了加入隐含层的概念。通过引入一个隐藏层,模型可以学习到更抽象、更有意义的特征,比如图像局部区域的模式或特征组合。例如,一个隐含层可以学习到像"圆形区域"这样的特征,这样每个像素点的权重不再直接对应于最终类别,而是与更高级别的特征相关联,提高了模型识别图像内容的能力。

卷积神经网络(CNN)在此基础上进一步优化,它利用卷积操作来提取空间特征,而非简单地将所有像素相连。卷积操作通过滑动一个小窗口(滤波器)在输入图像上,只对窗口内的像素进行运算,这样不仅减少了参数数量,降低了过拟合的风险,还能保留空间局部性,使得模型能够捕捉图像中的边缘、纹理等关键特征。

文章旨在帮助读者理解全连接前馈网络与卷积神经网络之间的区别和联系,以及如何通过隐含层的加入,从底层像素逐步构建起对复杂图像数据的高效表示。通过这篇深入的解读,读者可以更好地掌握这两种神经网络模型在实际应用中的优势和应用场景,从而避免对卷积公式死记硬背,而是能理解和运用它们的核心原理。"

2023-10-18 上传

2019-03-17 上传

2020-04-02 上传

2023-05-17 上传

2023-07-09 上传

2024-04-19 上传

2023-05-09 上传

2023-06-12 上传

2023-06-03 上传

地理探险家

- 粉丝: 1215

- 资源: 5523

最新资源

- 十种常见电感线圈电感量计算公式详解

- 军用车辆:CAN总线的集成与优势

- CAN总线在汽车智能换档系统中的作用与实现

- CAN总线数据超载问题及解决策略

- 汽车车身系统CAN总线设计与应用

- SAP企业需求深度剖析:财务会计与供应链的关键流程与改进策略

- CAN总线在发动机电控系统中的通信设计实践

- Spring与iBATIS整合:快速开发与比较分析

- CAN总线驱动的整车管理系统硬件设计详解

- CAN总线通讯智能节点设计与实现

- DSP实现电动汽车CAN总线通讯技术

- CAN协议网关设计:自动位速率检测与互连

- Xcode免证书调试iPad程序开发指南

- 分布式数据库查询优化算法探讨

- Win7安装VC++6.0完全指南:解决兼容性与Office冲突

- MFC实现学生信息管理系统:登录与数据库操作