Python实现回归树详解:CART算法与实战应用

143 浏览量

更新于2024-09-01

收藏 219KB PDF 举报

本文将详细介绍如何在Python中实现回归树模型,特别是基于CART(Classification and Regression Trees)算法的实例。回归树是一种基于树结构的预测模型,常用于解决回归问题,它通过构建决策树对输入特征进行分割,最终每个叶子节点表示一个预测值。与分类树不同,回归树的叶子节点不是类别,而是连续的数值,这个值通常是该节点样本的平均值,误差则是样本的均方差。

CART算法的核心在于每次选择特征时,无论特征是离散还是连续,都进行二分划分。对于回归问题,CART算法不使用Gini指数作为选择特征的标准,因为它与均方差损失函数不兼容。在回归树中,叶子节点的预测值基于样本均值,而非类别众数,这使得回归树的实现相对简单,尤其是在没有类别边界优化需求时。

接下来,我们将使用Python的scikit-learn库中的波士顿房价预测数据集进行实战演示。这个数据集包含13个特征,用于预测房屋的价格。在实际操作中,需要预处理数据,如加载数据、编码特征、处理缺失值等。通过加载`load_boston()`函数获取数据后,我们将展示如何构建回归树模型,包括特征选择、模型拟合以及预测房价的过程。

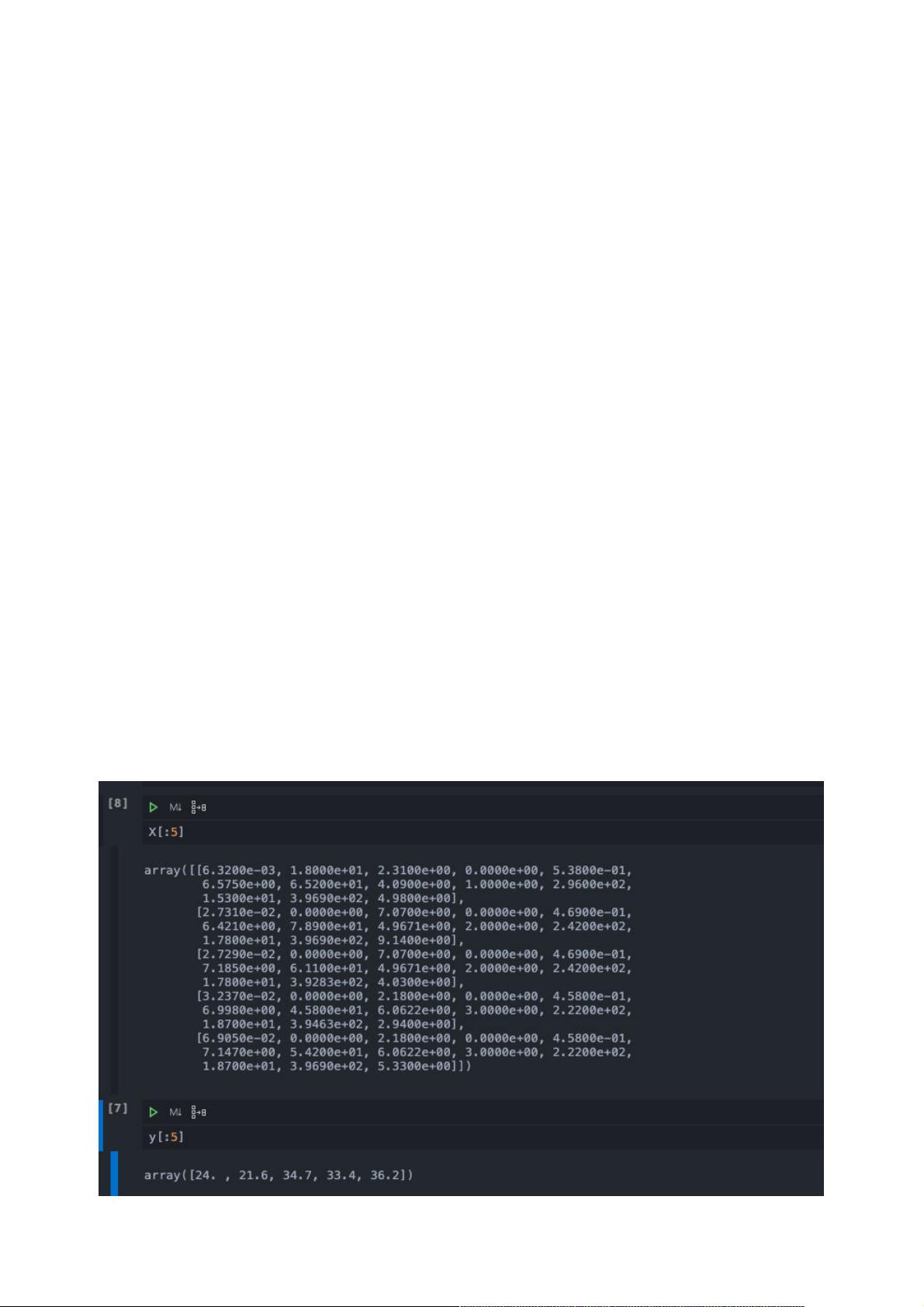

在实践中,首先导入必要的库,如`numpy`、`pandas`和`sklearn`,然后加载波士顿房价数据集。接着,我们将数据分为特征矩阵`X`和目标变量`y`,并可能对数据进行预处理和特征工程。具体步骤可能包括数据标准化、特征缩放,以及根据数据特性选择合适的回归树模型参数(如最大深度、最小样本叶节点大小等)。

通过sklearn的`DecisionTreeRegressor`类,我们可以创建回归树模型并进行训练:

```python

from sklearn.tree import DecisionTreeRegressor

from sklearn.model_selection import train_test_split

# 分割数据集为训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建决策树回归器

regr = DecisionTreeRegressor()

# 拟合模型

regr.fit(X_train, y_train)

# 进行预测

y_pred = regr.predict(X_test)

```

总结,本文通过详细的步骤指导读者如何使用Python和scikit-learn实现回归树模型,包括理论背景、CART算法原理,以及实际应用中的数据加载、模型构建和预测过程。理解并掌握这些内容,将有助于在实际项目中有效地应用回归树进行预测分析。

2020-11-30 上传

2021-07-06 上传

2023-12-27 上传

2023-07-26 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

weixin_38609128

- 粉丝: 7

- 资源: 906

最新资源

- 全国江河水系图层shp文件包下载

- 点云二值化测试数据集的详细解读

- JDiskCat:跨平台开源磁盘目录工具

- 加密FS模块:实现动态文件加密的Node.js包

- 宠物小精灵记忆配对游戏:强化你的命名记忆

- React入门教程:创建React应用与脚本使用指南

- Linux和Unix文件标记解决方案:贝岭的matlab代码

- Unity射击游戏UI套件:支持C#与多种屏幕布局

- MapboxGL Draw自定义模式:高效切割多边形方法

- C语言课程设计:计算机程序编辑语言的应用与优势

- 吴恩达课程手写实现Python优化器和网络模型

- PFT_2019项目:ft_printf测试器的新版测试规范

- MySQL数据库备份Shell脚本使用指南

- Ohbug扩展实现屏幕录像功能

- Ember CLI 插件:ember-cli-i18n-lazy-lookup 实现高效国际化

- Wireshark网络调试工具:中文支持的网口发包与分析