自动混合精度(AMP)训练技术详解

需积分: 9 124 浏览量

更新于2024-07-02

收藏 5.89MB PDF 举报

"AMP-Tutorial.pdf - 自动混合精度(AMP)训练教程"

在深度学习领域,自动混合精度(Automatic Mixed Precision, AMP)训练是一种优化技术,它利用低精度数据类型(如半精度浮点数FP16)来提高计算性能和减少GPU内存占用,同时结合高精度(如单精度浮点数FP32)来确保模型的准确性。这种技术的引入主要是为了应对训练过程中计算量大、GPU内存限制以及大型模型无法在单个GPU上完全运行等问题。

**为什么需要低精度?**

1. **计算密集型**: 训练复杂的神经网络模型通常需要大量的计算资源,这可能导致训练过程耗时数天甚至数周。使用低精度数据类型可以降低算术运算的复杂性,从而显著提高计算速度。

2. **GPU内存限制**: 大型模型,例如BERT-Large,可能无法完全装入单个GPU的内存中。这不仅限制了模型的规模,还导致训练批大小减小,降低了数据并行性的效率。

**低精度的好处**

1. **更低的运算复杂性**: 低精度运算比高精度运算更快,因此可以提高训练的性能。

2. **更少的GPU内存占用**: FP16数据类型只需要FP32一半的存储空间,节省的内存可用于更大的训练批次,进一步提升性能。

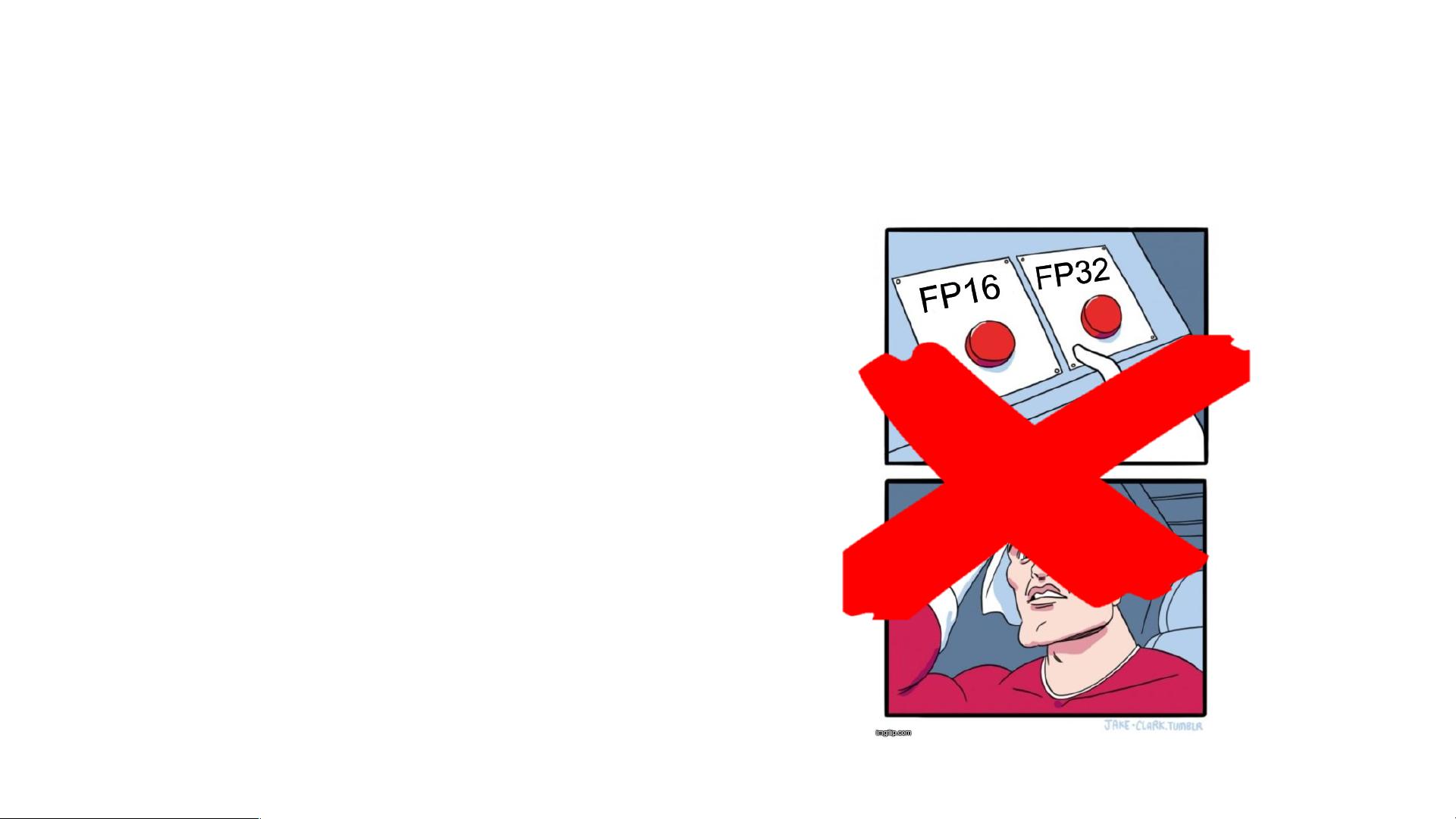

**为什么选择混合精度?**

虽然低精度带来了性能提升和内存节省,但也有其缺点。低精度数据类型的动态范围较小,容易出现数值溢出或下溢,导致模型精度损失甚至训练发散。

**混合精度的解决方案**

混合精度训练策略是将FP16和FP32相结合,利用FP16进行大部分计算以提升速度和降低内存使用,而关键的计算部分(如梯度和模型权重的更新)则保持在FP32精度,以保持数值稳定性。这样既保留了低精度带来的速度和内存优势,又能避免精度损失。

在实践中,自动混合精度库如NVIDIA的APex库和TensorFlow的TF-Agile,提供了实现这一策略的工具和API,使得开发者能够轻松地在训练中启用AMP,无需深入理解底层细节。

总结来说,AMP是一种有效利用现代硬件资源的技术,通过在训练中智能地结合高精度和低精度计算,解决了深度学习中的计算效率和内存限制问题,同时保持模型的准确性。对于那些支持低精度运算的硬件,不使用AMP将意味着未充分利用硬件潜力。

2020-07-28 上传

2020-10-22 上传

2021-05-26 上传

2011-03-24 上传

2019-09-13 上传

2013-07-30 上传

2023-06-11 上传

2023-06-11 上传

2024-11-29 上传

2024-11-29 上传

TracelessLe

- 粉丝: 5w+

- 资源: 466

最新资源

- C语言数组操作:高度检查器编程实践

- 基于Swift开发的嘉定单车LBS iOS应用项目解析

- 钗头凤声乐表演的二度创作分析报告

- 分布式数据库特训营全套教程资料

- JavaScript开发者Robert Bindar的博客平台

- MATLAB投影寻踪代码教程及文件解压缩指南

- HTML5拖放实现的RPSLS游戏教程

- HT://Dig引擎接口,Ampoliros开源模块应用

- 全面探测服务器性能与PHP环境的iprober PHP探针v0.024

- 新版提醒应用v2:基于MongoDB的数据存储

- 《我的世界》东方大陆1.12.2材质包深度体验

- Hypercore Promisifier: JavaScript中的回调转换为Promise包装器

- 探索开源项目Artifice:Slyme脚本与技巧游戏

- Matlab机器人学习代码解析与笔记分享

- 查尔默斯大学计算物理作业HP2解析

- GitHub问题管理新工具:GIRA-crx插件介绍