探索DataWhale学习营:二维卷积神经网络详解与实战

196 浏览量

更新于2024-08-29

收藏 365KB PDF 举报

卷积神经网络基础是深度学习中的一种关键组件,特别是在处理图像和视频数据时,其效率和效果尤为显著。本节重点讨论了二维卷积层,这是卷积神经网络中最常见的结构,专门针对图像数据进行特征提取和表示学习。

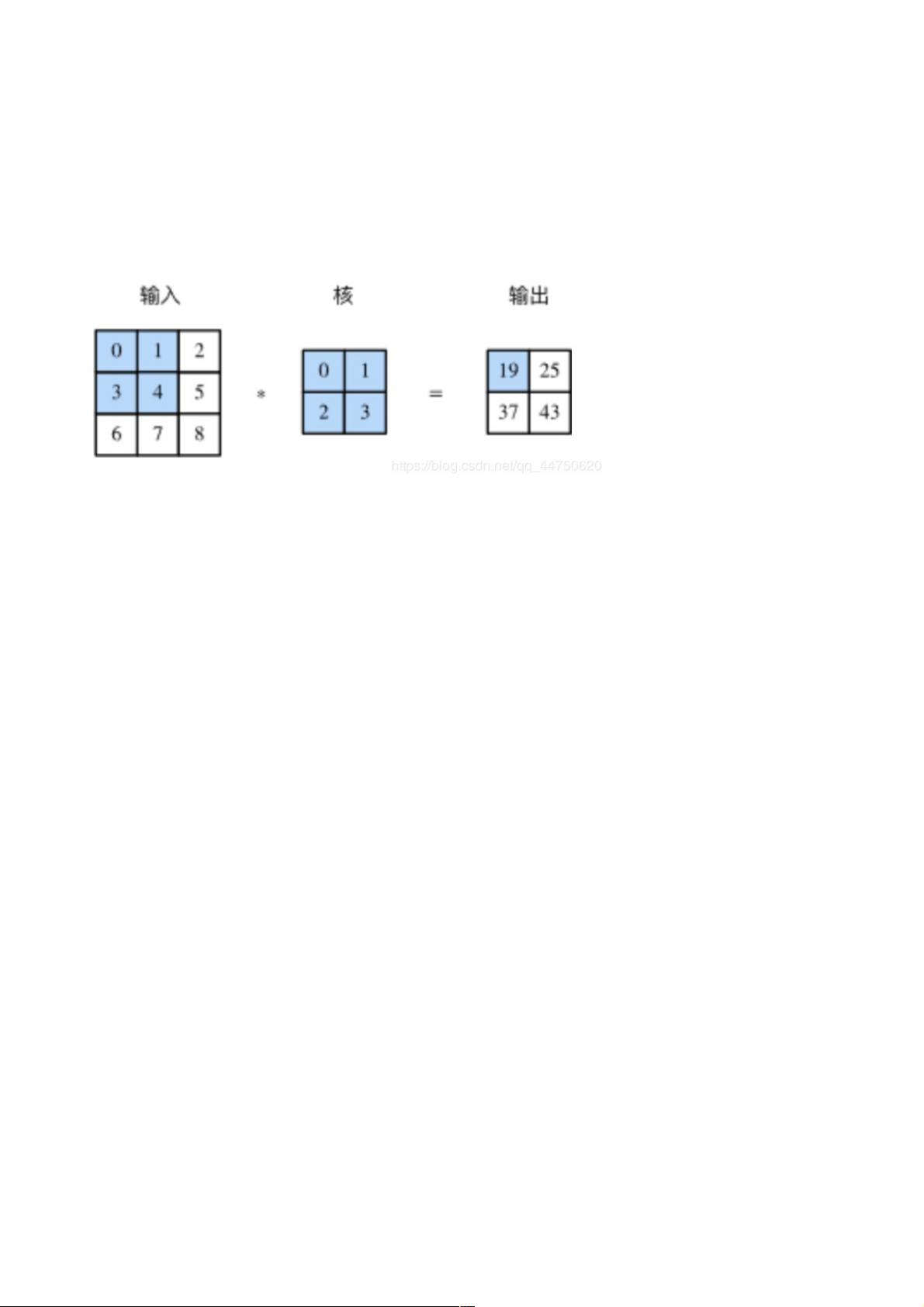

二维卷积层的核心概念是二维互相关运算。这种运算涉及到两个二维数组,一个是输入数组(通常代表图像的像素矩阵),另一个是卷积核(或过滤器)。卷积核是一个较小的矩阵,它在输入数组上进行滑动操作,每次与输入数组中的一部分(称为子数组)进行点乘并求和,从而生成输出数组中对应位置的值。这个过程可以视为对输入数据的局部特征检测,因为卷积核只关注局部区域的信息。

`corr2d`函数演示了如何在PyTorch中实现二维互相关运算。它接受输入数组`X`和卷积核`K`,通过循环遍历计算出每个位置的卷积结果,并将结果填充到输出数组`Y`中。例如,给定输入数组`X`和核数组`K`,经过`corr2d`函数处理后,可以看到输出数组的特定结果。

在实际应用中,二维卷积层作为`nn.Conv2d`类的一个实例,它包含权重(即卷积核)和偏差项。`nn.Conv2d`模块初始化时,会创建随机权重和偏置,这两个参数是模型的可学习参数。在`forward`方法中,输入数据`x`与卷积核进行卷积运算,再加上偏置,最终得到卷积层的输出。

例如,一个`Conv2D`层可能有`kernel_size`参数,如`(3, 3)`,表示卷积核的大小。当我们创建这样的层并传入数据时,它会自动执行卷积操作,为图像处理任务提供了强大的基础结构。通过堆叠多个卷积层,我们可以逐渐提取出更高级别的特征,如边缘、纹理和对象的部分形状,从而为后续的分类、识别等任务提供信息。

总结起来,二维卷积层是卷积神经网络的基础组成部分,它通过二维互相关运算提取图像数据的局部特征,通过学习调整的卷积核参数,实现对输入数据的高效分析和处理。理解这些概念对于深入学习计算机视觉、图像分类和深度学习框架如PyTorch至关重要。

2021-01-20 上传

2023-07-07 上传

2023-07-28 上传

2023-07-07 上传

2023-03-27 上传

2023-08-22 上传

2023-03-29 上传

2023-08-23 上传

2023-05-19 上传

weixin_38696339

- 粉丝: 4

- 资源: 908

最新资源

- C++标准程序库:权威指南

- Java解惑:奇数判断误区与改进方法

- C++编程必读:20种设计模式详解与实战

- LM3S8962微控制器数据手册

- 51单片机C语言实战教程:从入门到精通

- Spring3.0权威指南:JavaEE6实战

- Win32多线程程序设计详解

- Lucene2.9.1开发全攻略:从环境配置到索引创建

- 内存虚拟硬盘技术:提升电脑速度的秘密武器

- Java操作数据库:保存与显示图片到数据库及页面

- ISO14001:2004环境管理体系要求详解

- ShopExV4.8二次开发详解

- 企业形象与产品推广一站式网站建设技术方案揭秘

- Shopex二次开发:触发器与控制器重定向技术详解

- FPGA开发实战指南:创新设计与进阶技巧

- ShopExV4.8二次开发入门:解决升级问题与功能扩展