人工神经网络详解:从原理到实现

93 浏览量

更新于2024-08-31

收藏 162KB PDF 举报

"深入解析神经网络从原理到实现"

本文将深入探讨神经网络的基本原理及其实现方法,旨在帮助读者理解这一强大的机器学习工具。神经网络是受生物神经元网络启发的数学模型,广泛应用于函数估计和数据建模。

首先,神经网络由三个核心组成部分构成:结构、激励函数和学习规则。结构定义了网络中的变量和它们的相互连接,包括神经元的权重和激励值。激励函数则规定了神经元如何根据其他神经元的活动改变自身的状态,通常与权重有关。最后,学习规则描述了权重如何随时间调整,以优化网络的性能,这通常基于神经元的激励值和目标值。

神经网络中的非线性变换是其能力的关键所在。如果仅进行线性变换,多层网络将无法提供更多的表达能力。但是,通过引入非线性激励函数(如sigmoid、tanh或ReLU),神经网络能够模拟任意复杂的函数关系,极大地扩展了其学习和预测的能力。例如,一个简单的四层网络可以通过非线性变换捕获复杂的数据模式。

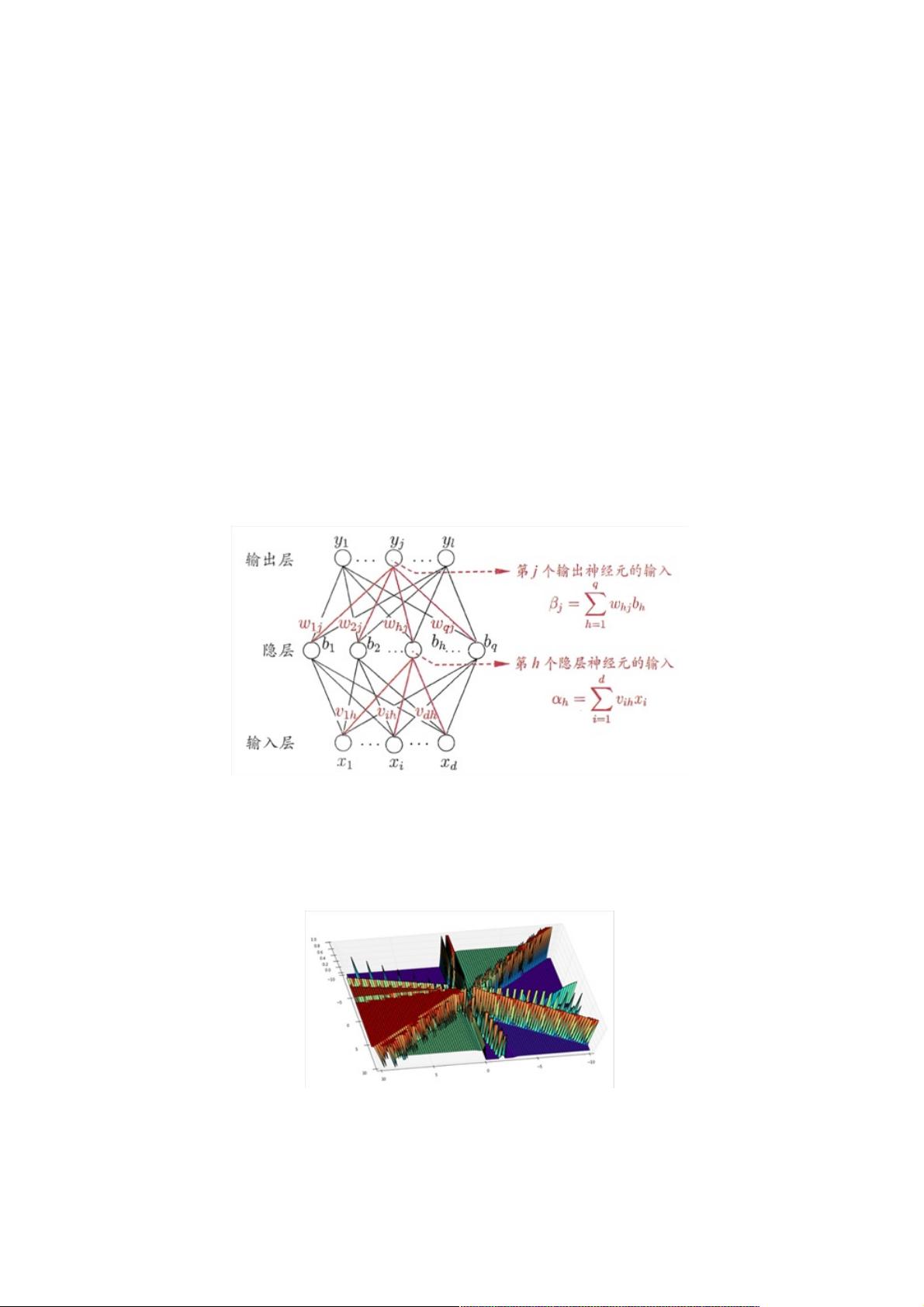

以一个三层神经网络为例,输入层有d个节点,隐藏层有q个节点,输出层有l个节点。每个非输入层的节点都会对其前一层的所有节点进行加权求和,并通过非线性函数处理结果。具体步骤如下:

1. 计算每个神经元的输入z,即z = w * x,其中w是权重,x是前一层的输出。

2. 应用激励函数f,得到新的输出new_x = f(z)。这个函数决定了网络的非线性特性。

通过这样的计算过程,神经网络能够逐步学习和优化权重,以适应给定的任务。学习规则,如梯度下降法或反向传播,用于更新权重,以最小化网络预测与实际结果之间的差异。

总结来说,神经网络是一种强大的工具,通过模拟生物神经元的工作方式,它能够处理复杂的非线性问题。理解其基本原理,包括结构、激励函数和学习规则,对于有效应用和改进神经网络至关重要。深入学习神经网络不仅需要理论知识,还需要实践经验,包括编写代码实现和调试神经网络模型。希望本文能为你的学习之旅提供有价值的参考和启示。

2022-08-03 上传

2024-06-27 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

2023-06-30 上传

2024-01-02 上传

weixin_38500709

- 粉丝: 6

- 资源: 894

最新资源

- C++多态实现机制详解:虚函数与早期绑定

- Java多线程与异常处理详解

- 校园导游系统:无向图实现最短路径探索

- SQL2005彻底删除指南:避免重装失败

- GTD时间管理法:提升效率与组织生活的关键

- Python进制转换全攻略:从10进制到16进制

- 商丘物流业区位优势探究:发展战略与机遇

- C语言实训:简单计算器程序设计

- Oracle SQL命令大全:用户管理、权限操作与查询

- Struts2配置详解与示例

- C#编程规范与最佳实践

- C语言面试常见问题解析

- 超声波测距技术详解:电路与程序设计

- 反激开关电源设计:UC3844与TL431优化稳压

- Cisco路由器配置全攻略

- SQLServer 2005 CTE递归教程:创建员工层级结构