"Spark集群部署与测试实验探究"

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

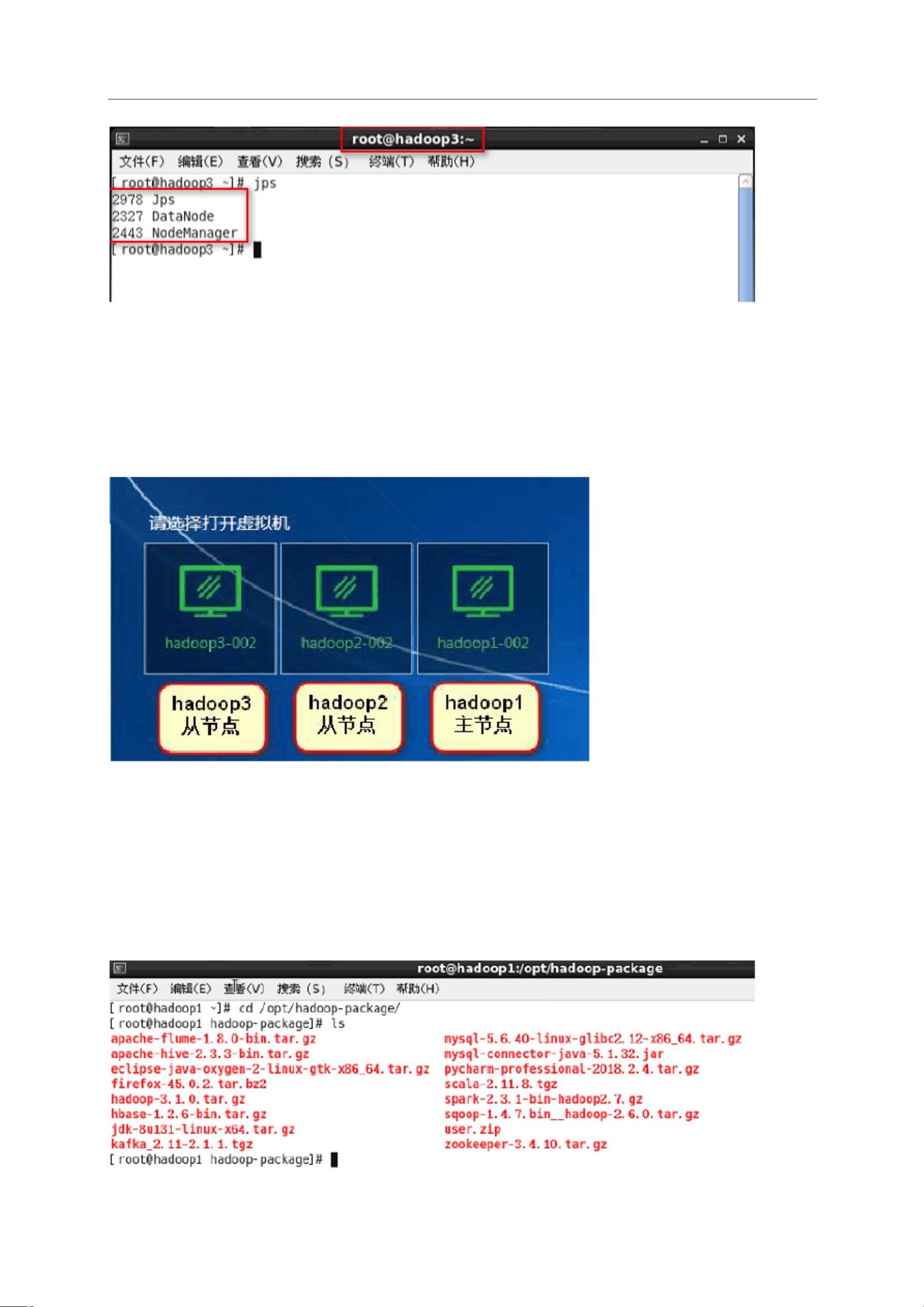

本次实验是关于Spark集群环境部署的实践,旨在帮助学生理解Spark的重要性,了解Spark生态圈,掌握Spark的体系架构和计算模型。通过实验,学生将学会如何部署Spark集群,并启动Spark集群,同时配置Spark集群使用HDFS。实验要求每位学生在实验结束时都能成功构建出Spark集群:在hadoop1上部署主服务Master,在hadoop2和hadoop3上部署从服务Worker,并且启动Spark集群进行测试。 实验的第一步是检查环境,通过在3台hadoop节点上执行jps命令查看hadoop进程。如果hadoop节点都没有启动,则需按照第一课中的分布式集群启动步骤进行操作。如果hadoop尚未安装完成,则需要安装第一课中的相关内容或执行自动部署脚本。在hadoop1、hadoop2和hadoop3节点上依次执行jps命令,确认各节点的运行情况,并截取相应的截图。 接下来是Spark的部署步骤,首先进入hadoop1主节点。在这一步中,学生需要按照实验指导书上的详细步骤进行操作,包括下载Spark安装包、配置Spark环境、设置Master和Worker节点等。在hadoop1节点上完成相应的操作后,将Spark的安装包分发到hadoop2和hadoop3节点上,并按照步骤进行配置,确保Master和Worker节点能够正确连接。 最后,学生需要启动Spark集群并进行测试。通过启动Spark服务,学生可以验证集群的正常工作状态,并进行一些简单的计算任务测试,以确保集群配置正确且可用。在测试过程中,学生需要注意观察集群的运行情况,确保数据能够正确传输和处理。 通过这次实验,学生将深入了解Spark的部署和配置过程,掌握Spark集群环境的搭建方法,进一步提升对大数据处理技术的理解和应用能力。实验的完成将帮助学生在未来的工作中更好地使用Spark进行大规模数据处理和分析,为其职业发展奠定坚实的基础。

剩余14页未读,继续阅读

- 粉丝: 8439

- 资源: 2万+

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 最优条件下三次B样条小波边缘检测算子研究

- 深入解析:wav文件格式结构

- JIRA系统配置指南:代理与SSL设置

- 入门必备:电阻电容识别全解析

- U盘制作启动盘:详细教程解决无光驱装系统难题

- Eclipse快捷键大全:提升开发效率的必备秘籍

- C++ Primer Plus中文版:深入学习C++编程必备

- Eclipse常用快捷键汇总与操作指南

- JavaScript作用域解析与面向对象基础

- 软通动力Java笔试题解析

- 自定义标签配置与使用指南

- Android Intent深度解析:组件通信与广播机制

- 增强MyEclipse代码提示功能设置教程

- x86下VMware环境中Openwrt编译与LuCI集成指南

- S3C2440A嵌入式终端电源管理系统设计探讨

- Intel DTCP-IP技术在数字家庭中的内容保护

信息提交成功

信息提交成功