"卷积神经网络(CNN)是机器学习领域中的一个重要模型,尤其在图像处理和计算机视觉任务中表现出色。这份PPT详细讲解了CNN的基础知识,包括激活函数、反向传播算法以及CNN的核心概念,如卷积、池化和全连接层。通过丰富的演示动画,帮助初学者更好地理解这一复杂的神经网络结构。"

CNN的核心概念:

1. 卷积:卷积是CNN的基础运算,它通过一个小型的可学习滤波器(或称为卷积核)在输入图像上滑动并进行乘加操作,从而提取出图像的特征。卷积过程可以捕获局部的像素关系,减少了计算量和参数数量。

2. 激活函数:CNN通常使用非线性激活函数,如Sigmoid、ReLU及其变种Leaky ReLU,来增加模型的表达能力。Sigmoid函数在中间层可能导致梯度消失,而ReLU及其变体能缓解这一问题,提高模型训练效率。

3. 反向传播算法:反向传播是优化神经网络权重的关键算法,它利用梯度下降法沿着损失函数的负梯度方向更新权重,以最小化目标函数。BP算法避免了链式法则计算时的冗余,有效地计算深层网络的梯度。

4. 局部连接和权值共享:CNN的特点之一是局部连接,即每个神经元只与输入的一小部分区域相连,这对应于图像的局部特征。同时,同一位置的卷积核权重共享,减少了模型参数,提高了计算效率。

5. 填充和步长:在卷积过程中,填充(padding)用于保持输出尺寸与输入一致,步长(stride)控制卷积核移动的步距。这两者可以灵活调整,影响模型的性能和输出尺寸。

6. 池化层:池化层通常位于卷积层之后,用于降低数据维度,减少计算量,并引入平移不变性。常见的池化操作有最大池化和平均池化,前者保留最重要特征,后者则更注重整体信息。

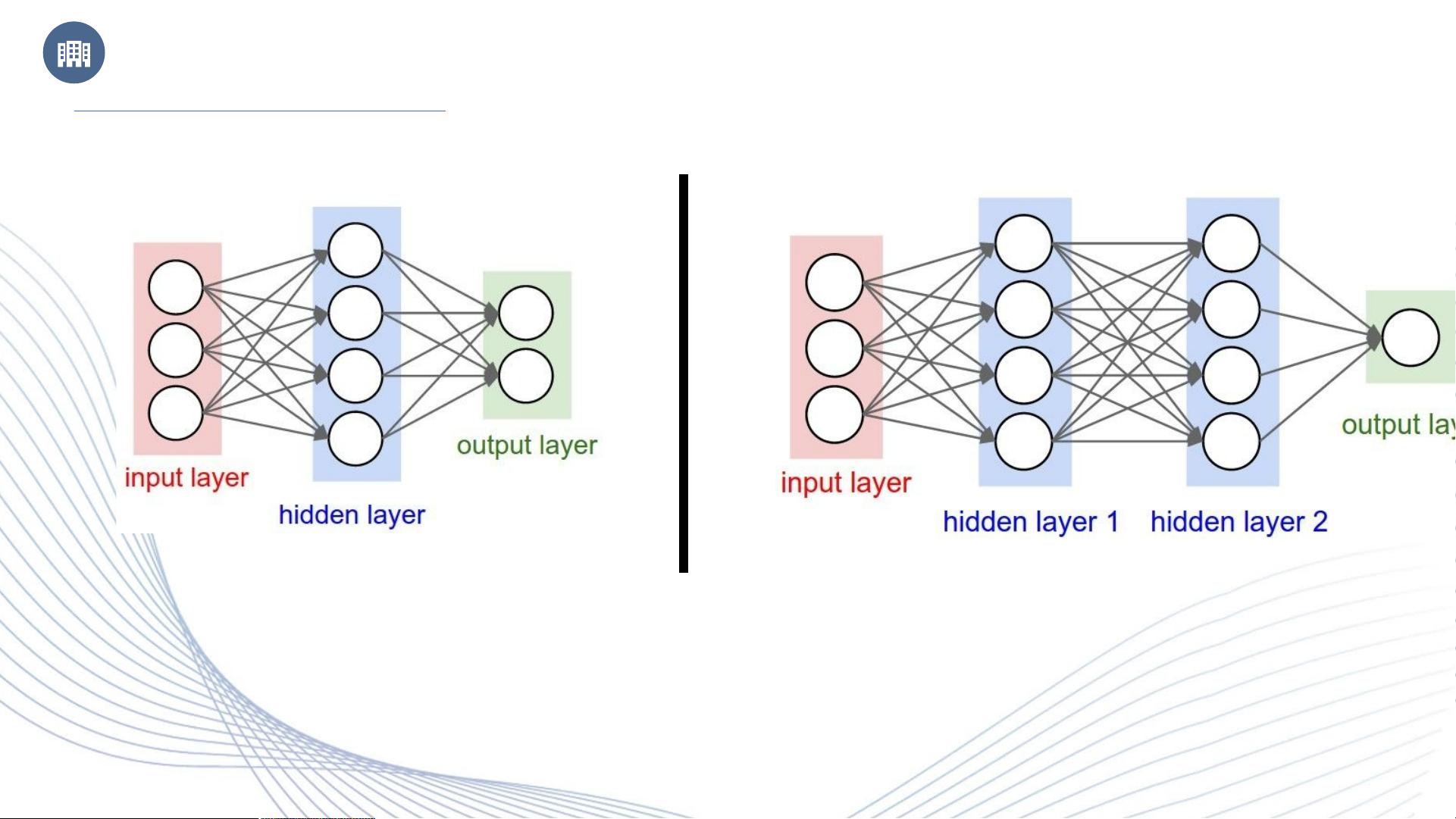

7. 全连接层:在卷积和池化层提取出高级特征后,全连接层将这些特征作为输入,通过多层感知器进行分类。输出层通常使用softmax函数,将输出转化为概率分布,表示各个类别的可能性。

8. 防止过拟合策略:除了池化,还可以通过数据增强、dropout、正则化等手段防止过拟合,确保模型在未见过的数据上表现良好。

9. 应用领域:CNN广泛应用于图像识别、物体检测、图像分割、自然语言处理等领域,它的强大特征提取能力使其成为解决复杂问题的有效工具。

卷积神经网络通过其独特的结构和机制,能够自动学习和识别图像中的特征,从而在许多视觉任务中展现出卓越的性能。这份PPT深入浅出地介绍了CNN的各个方面,对于初学者来说是一份宝贵的参考资料。