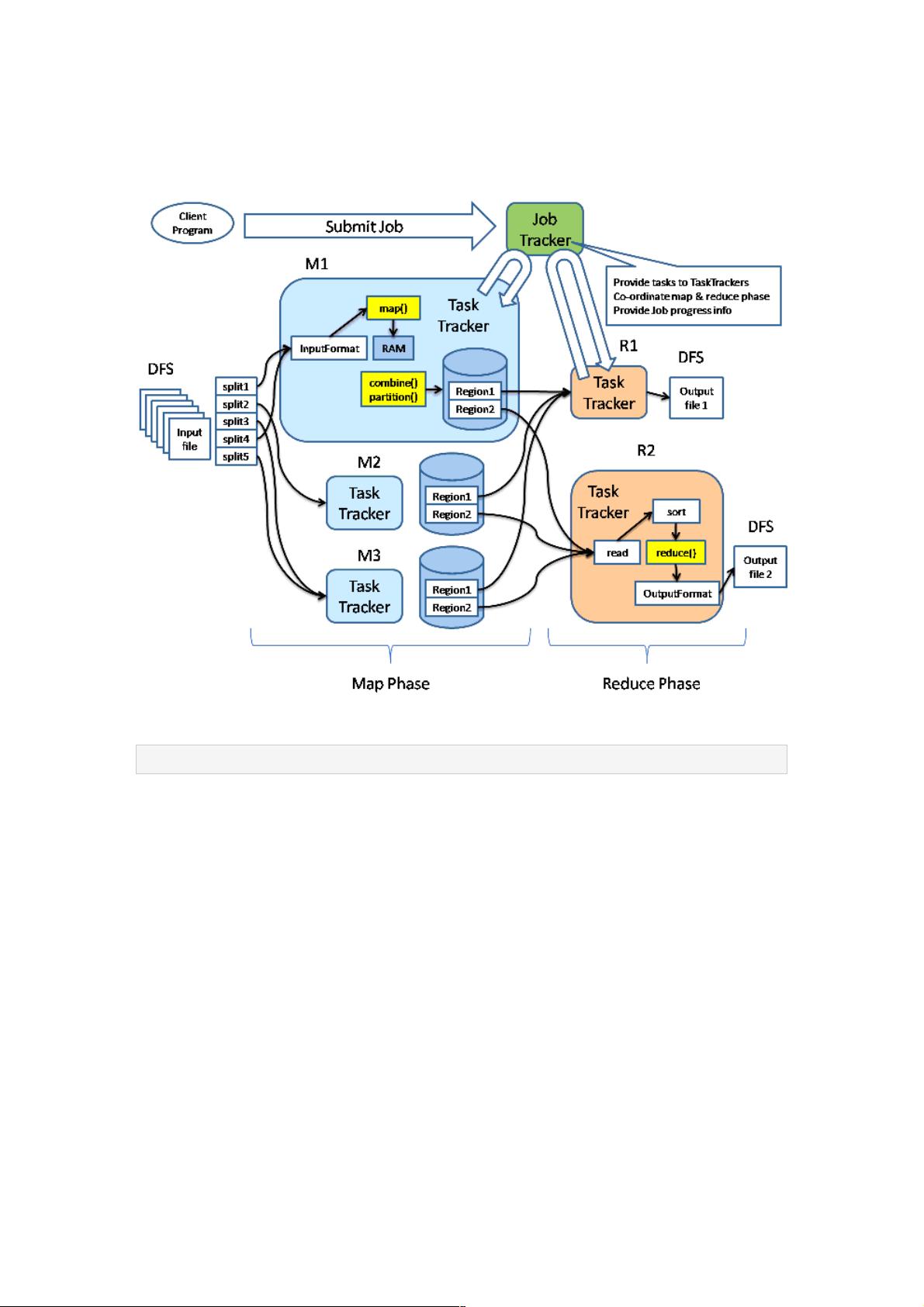

"这篇内容主要讨论的是Hadoop的二次开发,特别是关于MapReduce的理解与应用。文章以Hadoop自带的wordcount程序为例,深入解析MapReduce的工作流程,包括Map阶段和Reduce阶段,以及相关的组件和接口,如InputFormat、RecordReader、OutputCollector、Partitioner和Combiner等。" MapReduce是Hadoop生态系统中的核心组件,主要用于处理大规模数据的并行计算。在Map阶段,数据被InputFormat接口描述,并通过InputSplit接口进行划分,RecordReader则将数据转化为<k,v>对。例如,wordcount程序中,RecordReader可能将每行文本作为一个k-v对,其中k可能是单词,v可能是1。 Map函数接收到这些<k,v>对后,对数据进行处理,通常是对键值对进行某种转换,如统计单词出现次数。处理后的结果通过OutputCollector收集,并由Partitioner决定哪些键值对应该发送到哪个Reducer。这里,Combiner可以在Map阶段本地进行数据预聚合,减少网络传输的数据量,提高效率。 Reduce阶段则负责整合Map阶段的结果。首先,数据会经过混洗(Shuffle)和排序(Sort)步骤,确保相同key的值被放在一起。接着,Reduce函数接收这些分组后的键值对,进行进一步的处理,如计算每个单词的总出现次数。在这个阶段,Reducer是处理全局信息的关键,它可以将局部计算的结果汇总成最终结果。 Hadoop的二次开发涉及到对这些基本组件的定制,比如自定义InputFormat适应不同的数据源,实现特定的Partitioner策略以优化数据分布,或者设计高效的Combiner减少数据传输。理解MapReduce的工作原理对于开发者来说至关重要,因为这能帮助他们更好地优化程序性能,解决特定的数据处理问题。 在实际开发中,Hadoop的二次开发不仅仅是理解MapReduce,还包括对HDFS的优化,JobTracker和TaskTracker的管理,以及YARN(Yet Another Resource Negotiator)的使用等。YARN是Hadoop 2.x版本引入的资源管理系统,它分离了JobTracker的资源管理和作业调度功能,提高了系统的可扩展性和容错性。 Hadoop二次开发要求开发者深入理解分布式计算的原理,熟悉Hadoop生态系统的各个组件,以及如何根据业务需求进行定制化开发。这不仅需要扎实的编程基础,还需要对大数据处理的深刻洞察。通过不断实践和学习,开发者可以充分利用Hadoop的强大能力,解决各种大规模数据处理的问题。

下载后可阅读完整内容,剩余7页未读,立即下载

- 粉丝: 5

- 资源: 909

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 十种常见电感线圈电感量计算公式详解

- 军用车辆:CAN总线的集成与优势

- CAN总线在汽车智能换档系统中的作用与实现

- CAN总线数据超载问题及解决策略

- 汽车车身系统CAN总线设计与应用

- SAP企业需求深度剖析:财务会计与供应链的关键流程与改进策略

- CAN总线在发动机电控系统中的通信设计实践

- Spring与iBATIS整合:快速开发与比较分析

- CAN总线驱动的整车管理系统硬件设计详解

- CAN总线通讯智能节点设计与实现

- DSP实现电动汽车CAN总线通讯技术

- CAN协议网关设计:自动位速率检测与互连

- Xcode免证书调试iPad程序开发指南

- 分布式数据库查询优化算法探讨

- Win7安装VC++6.0完全指南:解决兼容性与Office冲突

- MFC实现学生信息管理系统:登录与数据库操作

信息提交成功

信息提交成功