"Spark生态和安装部署是DATAGURU专业数据分析社区提供的一门关于Apache Spark的大数据平台入门课程,由马军辉讲师主讲。Spark是本次课程的核心内容,它是一个开源的分布式计算框架,最初由Yahoo! Labs开发,现由Apache软件基金会维护。Spark的设计初衷是为了解决MapReduce在大规模数据处理中的性能瓶颈,它以其高效、交互性和内存计算的优势而闻名。

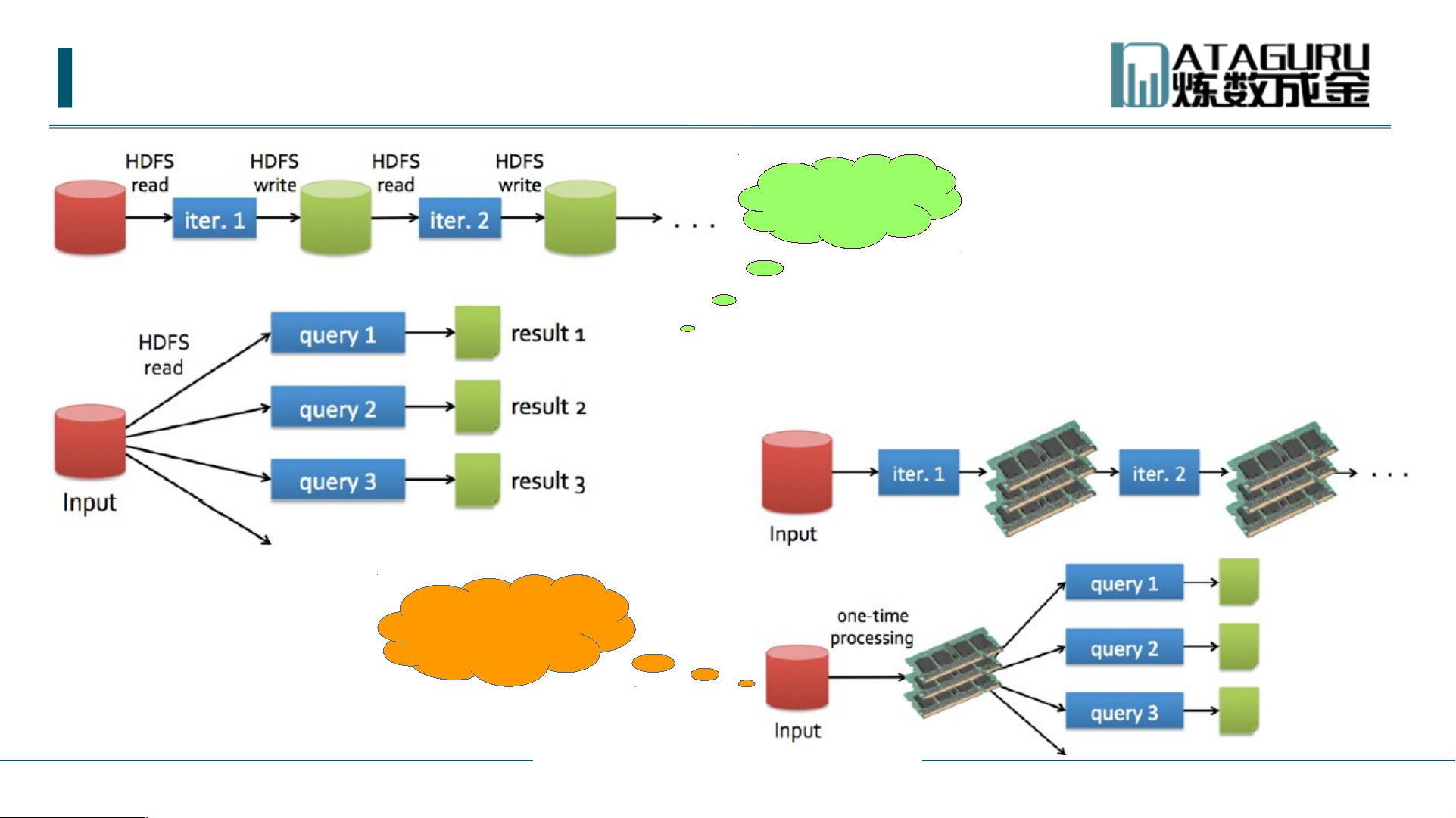

课程开始时,首先介绍了Spark的基本概念,包括它是如何在大数据处理中扮演关键角色的。Spark的主要特性包括基于内存的计算模型(RDD,弹性分布式数据集),这使得它可以实现近乎实时的数据处理。此外,课程还涵盖了Spark的生态系统,包括其核心组件如Spark SQL(用于SQL查询)、Spark Streaming(实时流处理)、MLlib(机器学习库)以及GraphX(图计算框架)等,这些都是构建现代数据处理应用不可或缺的部分。

部署Spark的过程也是讲解的重点,学员可以了解到如何在本地、集群或云环境中进行安装和配置,包括Hadoop YARN、Mesos、Kubernetes等资源管理器的集成。课程还介绍了Spark的可扩展性,如何通过增加资源来提高处理能力,并且强调了集群管理和故障恢复的重要性。

实用工具部分,课程可能会介绍Spark Shell(命令行工具)和PySpark(Python接口)等,帮助用户更方便地与Spark交互并编写分布式程序。此外,还会探讨如何利用Spark的历史记录系统(History Server)进行任务跟踪和调试。

值得注意的是,课程内容严格遵守法律声明,所有的视频和幻灯片仅限于炼数成金网络课程内部使用,未经授权不得传播,否则将可能面临法律和经济责任。对于想要深入了解Spark并应用于实际数据分析项目的学员来说,这是一门非常有价值的入门课程,提供了从理论到实践的全面指导。

要获取更多课程详情和参与学习,可以访问DATAGURU的专业培训网站<http://edu.dataguru.cn>。"

这门课程旨在帮助数据分析师快速掌握Spark技术,提升大数据处理效率,以便在实际工作中发挥其价值。通过深入理解Spark的原理和使用方法,学员能够更好地应对复杂的数据分析挑战。