计算机研究与发展2014,51(3)

数,并将TD误差引入到求解最优策略参数的目标

函数中,在行动者部分利用所构造的目标函数求解

最优策略参数,提高策略参数估计的精确性.利用最

小二乘方法求解参数可以有效消除初始值对最终收

敛结果的影响,提高样本数据的利用率,同时避免梯

度算法中调整学习参数的问题.最后,将本文提出的

算法用于解决具有连续动作空间的小车平衡杆问题

和mountain

car问题,并与Cacla和eNAC(叩isodic

natural

actor—critic)…朝这2种解决连续动作空间

的经典算法进行比较和分析.实验结果表明,本文的

算法能有效地解决连续动作空间问题,具有较优的

执行性能.

1

基础理论

1.1

Markov决策过程

Markov决策过程(Markov

decision

process,

MDP)常被用来对强化学习问题进行建模¨j.通常

一个MDP可以用一个五元组表示,M一(X,U,厂,

p,y),其中,X是状态空间,U是动作空间,厂是状态

转移函数,厂:X×U×X一[o,1],即/’(T,“,T

7)表示

在状态z∈X下采用动作“∈U转移到后续状态

z

7∈X的概率;』D是奖赏函数,10:X×U—i,即』0(T,

“)表示在状态z下采用动作“所获得的立即奖赏,

而通常为了简化,用“表示在任意时刻是当前状态

动作对的立即奖赏值,即“一|0(z。,“。);y∈(o,1)是

折扣因子.

强化学习算法可以用于求解一个不会随着时间

的变化而改变的策略,即稳定策略,并可以利用该策

略进行决策.在强化学习中,策略矗可以表示为^:

X×U一[o,1].^(z,“)是指在状态z下采取动作“

的概率.如果策略^是一个确定性策略,则在任意状

态z下,根据策略^只能获得一个确定的动作,而

不是动作选择的概率,由此,确定的稳定策略可以表

示为:^:X—U,因此,在状态T下采取的动作可以

表示为:“一^(z).在后续文中如果没有特别说明,

策略^都是指确定性策略.

为了评估用于某个MDP的策略^的优劣,通

常利用值函数进行评估,具体可以分为状态值函数

V“和动作值函数Q6,其中V‘(z)是在当前状态T

下根据策略^所能获得的累计期望奖赏,Q,7(z,“)

是在当前状态动作对(z,“)下根据策略^所能获得

的累计期望奖赏.V6(z)和d2(工,“)都可以认为是

对应的一组Bellman公式的不动点解,可以表示为

驴(z)一∑^(z,“)l

lD(工,“)+

“∈U

L-

),∑厂(zmz

7)驴(z圳,

(1)

r’∈X

—

Q^(工,“)一lD(z,“)+),∑厂(z,“,z7)

J’∈X

y矗(z7,“7)甜(z

7,“7).

(2)

篇7

强化学习的最终目的是能够求得一个最优策略

^’,对应的值函数V’(z)和Q+(z,“)可以描述为

V+(z)一H曼簪{』D(z,扰)+y∑/(z,蹦,z7)y’(z7)),

“t“

T’∈X

(3)

Q+(z,“)一10(z,“)+y∑,(z,“,z

7)

J’∈X

{maxQ+(z

7,“7)},

(4)

“4∈U

式(3)和式(4)也被称作是最优Bellman公式.

以下给出有界MDP的定义.在本文所讨论的

MDP都是有界的.

定义1.有界MDP.假设X和U都是一个有限

集合;奖赏值函数|0有界,即对于任意(z,“)∈X×

U,R…≤p(z,“)≤R…,其中R…和R。。。是常数;设

口一1/(1一y),其中y∈(o,1)为折扣因子,则在任意

策略^下,对于Vz∈X及V(T,“)∈x×U,都有

雕…≤V6(z)≤胆。。。和艘。。。≤甜(z,“)≤胆。。。

成立.

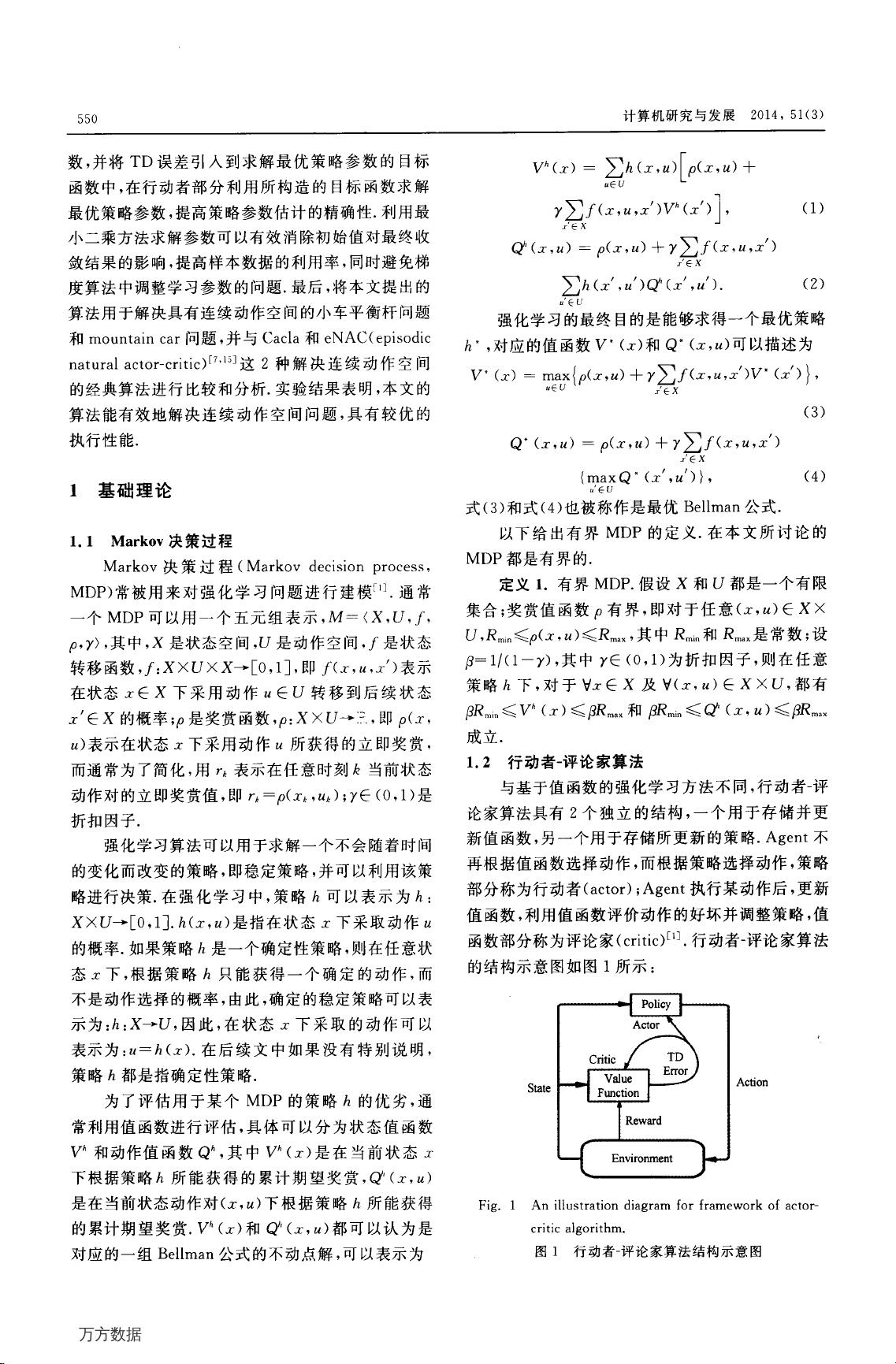

1.2行动者一评论家算法

与基于值函数的强化学习方法不同,行动者一评

论家算法具有2个独立的结构,一个用于存储并更

新值函数,另一个用于存储所更新的策略.Agent不

再根据值函数选择动作,而根据策略选择动作,策略

部分称为行动者(actor);Agent执行某动作后,更新

值函数,利用值函数评价动作的好坏并调整策略,值

函数部分称为评论家(critic)[1].行动者一评论家算法

的结构示意图如图1所示:

Fig.

1

An

illustration

diagram

for

framework

of

actor—

critic

algorithm.

图1

行动者一评论家算法结构示意图

万方数据