多层前馈网络与反向传播算法

版权申诉

186 浏览量

更新于2024-07-07

收藏 1.12MB PPT 举报

"《前向网络》PPT课件详细介绍了前馈神经网络,特别是BP网络及其反向传播算法在解决复杂非线性问题中的应用。"

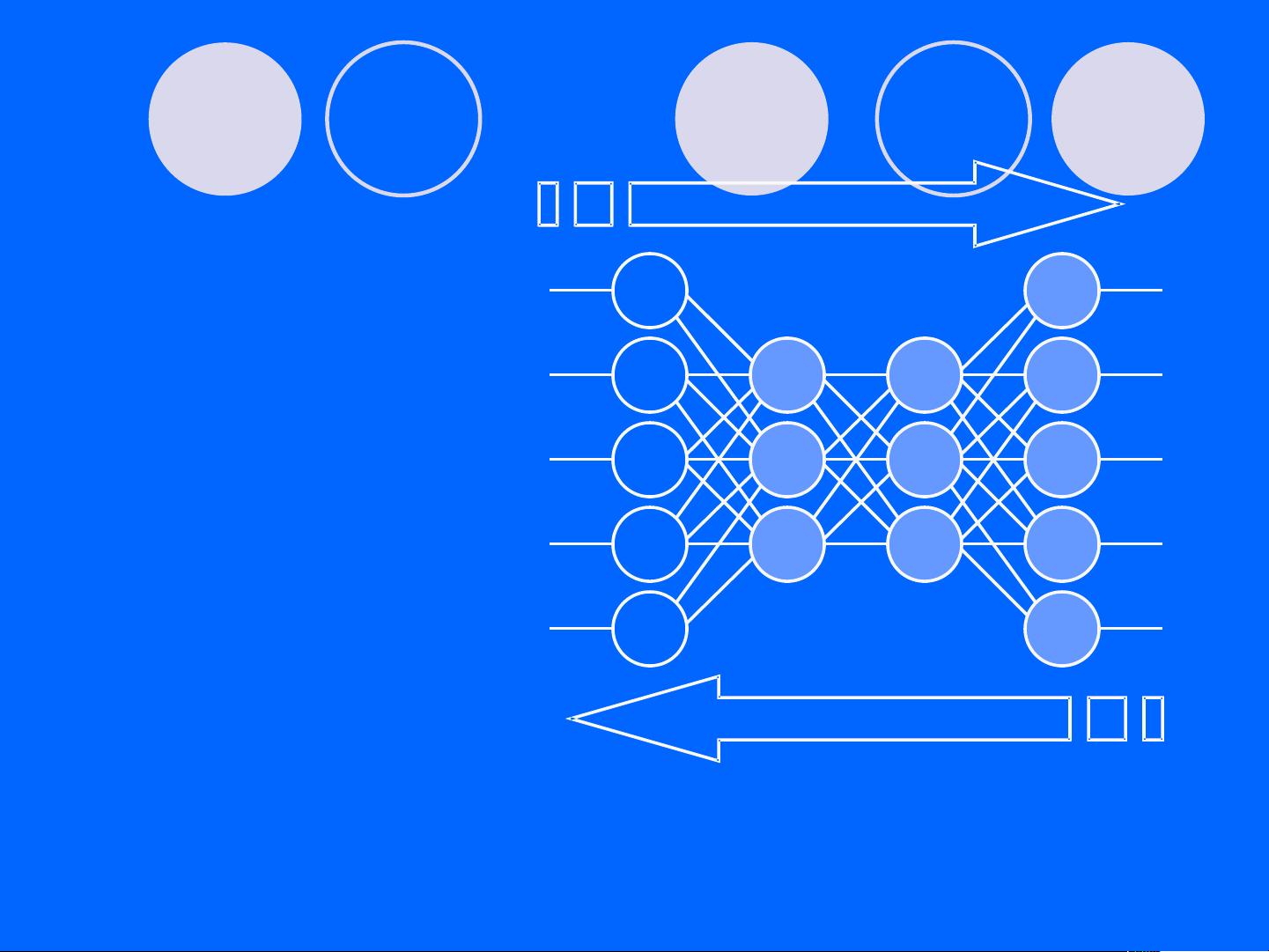

前馈神经网络是一种重要的机器学习模型,它由多层神经元构成,每一层神经元只与下一层神经元有连接,形成了自输入到输出的单向信息流。在第二讲中,主要讨论了前馈神经网络的两种基础形式:感知器网络和基于线性激活函数的网络,以及它们的局限性。

感知器网络利用硬限幅函数作为激活函数,适用于简单的线性可分问题。然而,硬限幅函数的非连续性和不可微性使得在网络层数增加时,权值更新变得困难,限制了其解决复杂非线性问题的能力。而线性激活函数的多层网络虽然可以扩展结构,但由于其线性特性,仍无法有效处理非线性问题,往往只能等效为一个单层线性网络。

为克服这些局限性,BP网络应运而生。BP网络采用了多层结构,并引入了可微分的非线性激活函数,比如S型函数或双曲正切函数,这使得网络能够更好地拟合复杂的非线性数据分布。BP算法是BP网络的核心,它是一种反向传播的学习策略,通过计算误差在网络中的反向传播来更新权重,从而逐步优化网络性能。

BP算法基于梯度下降法,能够处理非线性可微函数的权重训练。由于S型函数和其他可微函数的使用,BP网络可以在不使用二值阈值函数的情况下实现平滑的权重调整。通常,输出层会使用线性函数,以允许输出值在一定范围内自由变化。

1986年,Rumelhart等人提出的BP算法因其高效性和广泛应用性而成为神经网络学习的主流方法,常见于函数拟合、逼近问题和自动控制等领域。Hornik等人的研究表明,即使只有一个隐藏层的前馈网络也能近似任何复杂的函数,这进一步突显了BP网络的灵活性和强大能力。

BP算法的工作原理主要包括以下步骤:

1. 前向传播:输入信号通过网络逐层传递,每个神经元根据当前权重计算其输出。

2. 计算误差:比较网络的实际输出与期望输出,计算误差。

3. 反向传播误差:误差从输出层反向传播到输入层,每层神经元根据其对总误差的贡献调整权重。

4. 权重更新:使用梯度下降法更新权重,最小化网络的损失函数。

5. 重复以上步骤直到网络收敛或达到预设的迭代次数。

BP网络通过结合多层结构和可微分的非线性激活函数,以及反向传播算法,提供了一种有效的解决复杂非线性问题的工具,广泛应用于各种领域。理解并掌握BP算法的原理和执行步骤对于深入研究神经网络和机器学习至关重要。

2022-06-10 上传

2022-04-14 上传

2024-10-28 上传

2024-10-28 上传

2024-10-30 上传

2024-10-30 上传

2024-10-25 上传

2024-10-29 上传

xiangyuhua2021

- 粉丝: 0

- 资源: 5万+

最新资源

- Raspberry Pi OpenCL驱动程序安装与QEMU仿真指南

- Apache RocketMQ Go客户端:全面支持与消息处理功能

- WStage平台:无线传感器网络阶段数据交互技术

- 基于Java SpringBoot和微信小程序的ssm智能仓储系统开发

- CorrectMe项目:自动更正与建议API的开发与应用

- IdeaBiz请求处理程序JAVA:自动化API调用与令牌管理

- 墨西哥面包店研讨会:介绍关键业绩指标(KPI)与评估标准

- 2014年Android音乐播放器源码学习分享

- CleverRecyclerView扩展库:滑动效果与特性增强

- 利用Python和SURF特征识别斑点猫图像

- Wurpr开源PHP MySQL包装器:安全易用且高效

- Scratch少儿编程:Kanon妹系闹钟音效素材包

- 食品分享社交应用的开发教程与功能介绍

- Cookies by lfj.io: 浏览数据智能管理与同步工具

- 掌握SSH框架与SpringMVC Hibernate集成教程

- C语言实现FFT算法及互相关性能优化指南