深度学习驱动的语音分离技术解析

版权申诉

"该文档是关于端到端语音分离技术及其应用的综述,由HuiSong于2020.07.25撰写。文章涵盖了深度学习在语音分离领域的最新进展,包括单声道语音分离、基于阵列的语音分离,以及编码器-分离器-解码器的架构,并探讨了频率域与时间域的方法,同时提到了基于分离和基于波束形成的分离方法。"

端到端语音分离技术是现代语音处理领域的一个重要研究方向,尤其在多说话人环境下的语音识别、对话系统和音频理解中起到关键作用。这一技术的目标是从混合信号中分离出各个独立的语音源,以便后续的分析和处理。

1. **定义与形式化**:

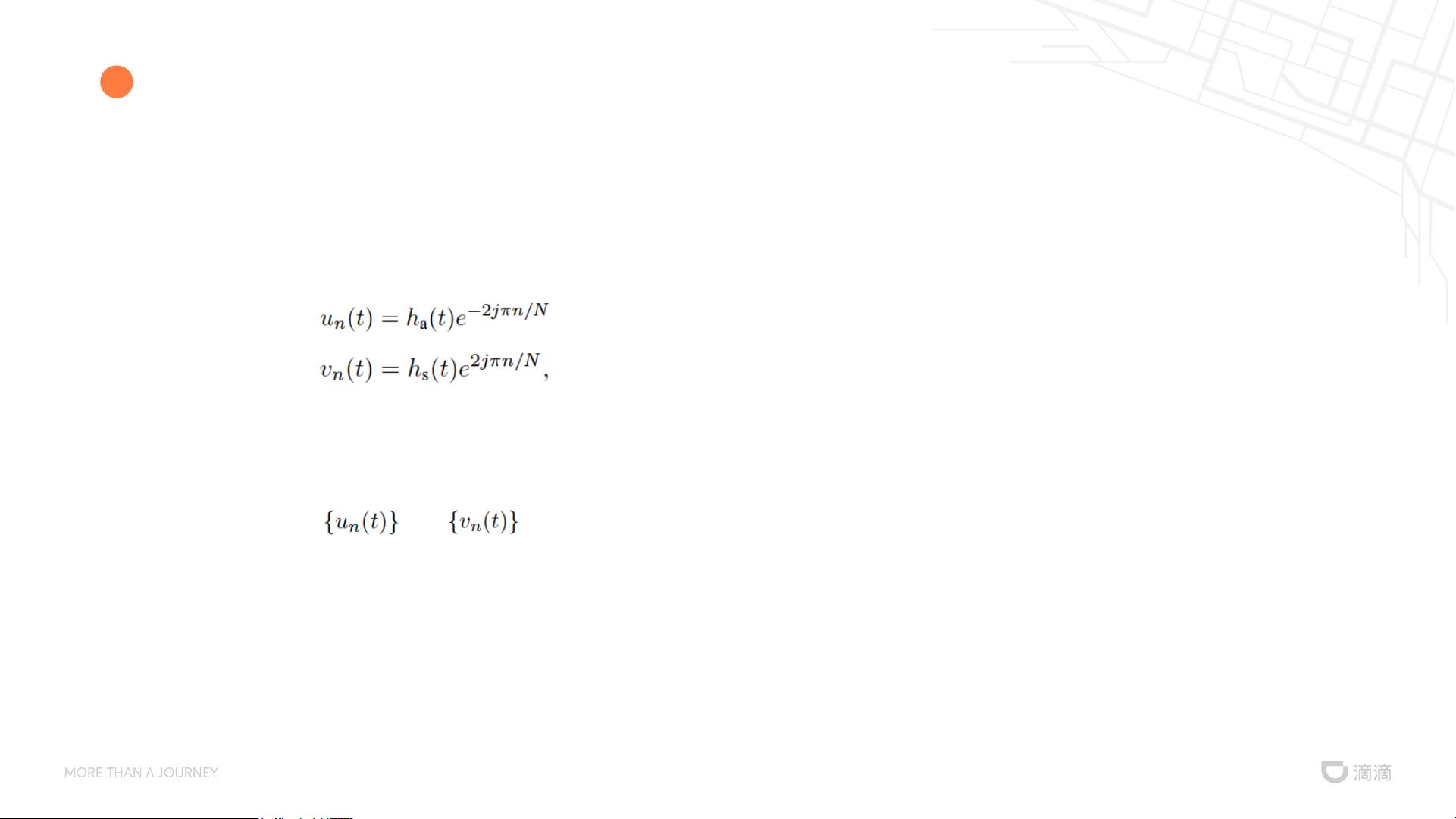

端到端语音分离通常采用一个包含编码器、分离器(或提取器)和解码器的框架。编码器将输入的时域信号转换为适合源分离的潜在空间;分离器通过估计每个源的掩模来分离潜在空间中的信号,并通过掩模乘法输出源的估计;解码器再将提取的源信号转换回时域。

2. **状态-of-the-art 技术**:

当前的研究重点在于利用深度学习模型,如神经网络,进行语音分离。这些模型可以学习复杂的非线性关系,从而有效处理混响、噪声和重叠语音。

3. **频率域与时间域方法**:

- **频率域方法**:如基于深度学习的频谱掩模估计,通过估计功率谱密度矩阵的掩模来分离源信号,然后通过逆快速傅里叶变换(IFFT)还原到时域。

- **时间域方法**:如时间-频率门控网络,直接在时域上操作,避免了频域和时域之间的转换损失,可能更适合实时应用。

4. **分离方法**:

- **基于分离的方法**:如深度学习模型直接估计源信号,不依赖于物理声学模型。

- **基于波束形成的方法**:利用麦克风阵列的信息,通过空间滤波实现声源定位和分离,常用于远场语音处理。

5. **未来挑战与结论**:

未来的研究可能聚焦于提高分离性能,尤其是在噪声和多说话人环境中的鲁棒性,减少计算复杂度以适应实时应用,以及增强模型的泛化能力。

端到端语音分离技术结合深度学习的威力,为语音处理带来了新的可能性,但同时也面临着挑战,如模型优化、实时处理和真实世界环境的适应性。随着技术的不断进步,我们可以期待这一领域会有更多创新的应用出现。

点击了解资源详情

145 浏览量

点击了解资源详情

2021-08-10 上传

2021-08-31 上传

2021-08-31 上传

169 浏览量

2022-04-23 上传

2021-09-04 上传

智慧化智能化数字化方案

- 粉丝: 2321

最新资源

- 小学水墨风学校网站模板设计

- 深入理解线程池的实现原理与应用

- MSP430编程代码集锦:实用例程源码分享

- 绿色大图幻灯商务响应式企业网站开发源码包

- 深入理解CSS与Web标准的专业解决方案

- Qt/C++集成Google拼音输入法演示Demo

- Apache Hive 0.13.1 版本安装包详解

- 百度地图范围标注技术及应用

- 打造个性化的Windows 8锁屏体验

- Atlantis移动应用开发深度解析

- ASP.NET实验教程:源代码详细解析与实践

- 2012年工业观察杂志完整版

- 全国综合缴费营业厅系统11.5:一站式缴费与运营管理解决方案

- JAVA原生实现HTTP请求的简易指南

- 便携PDF浏览器:随时随地快速查看文档

- VTF格式图片编辑工具:深入起源引擎贴图修改