"2023之江实验室生成式大模型安全与隐私白皮书"

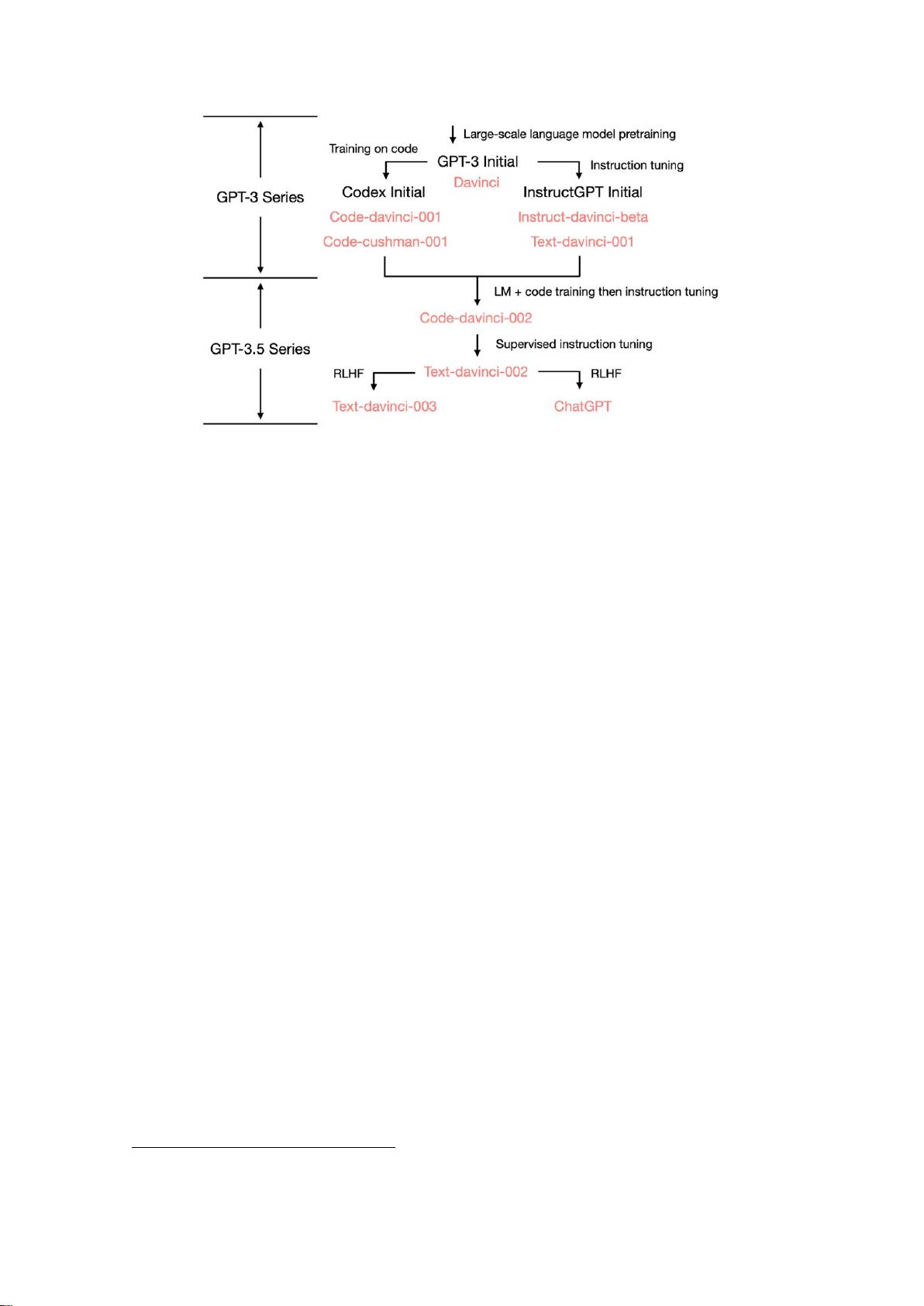

自2023年以来,之江实验室的人工智能与安全团队一直在积极研究生成式大模型的安全与隐私问题,并于同年6月6日发布了《之江实验室:2023生成式大模型安全与隐私白皮书》。该白皮书由徐晓刚,吴慧雯,刘竹森,李想,涂文轩,梁伟轩,张毅和刘哲等人共同撰写,旨在深入探讨大型生成式人工智能模型的安全性和隐私保护措施。 生成式人工智能模型,尤其是大型语言模型(LLM)如ChatGPT系列,在学术和工业界都备受关注。ChatGPT和GPT-4等模型的成功展示了发展通用人工智能(AGI)的未来方向。然而,大型生成式模型也面临着数据和模型安全性以及隐私保护的问题。因此,之江实验室的研究团队着重关注大型生成式模型的安全与隐私挑战,并提出了一系列解决方案。 白皮书首先指出了大型生成式模型所面临的安全和隐私挑战,包括数据泄露、模型攻击和恶意滥用等方面。针对这些挑战,之江实验室提出了一系列技术与政策上的建议和解决方案。首先是在技术方面,他们提出了数据加密和隐私保护技术,以及模型鲁棒性和安全训练方法,以增强大型生成式模型的安全性。其次是在政策层面,他们呼吁建立更加严格的数据使用和共享规范,加强数据和模型安全管理。 此外,之江实验室的研究团队还提出了对未来研究方向的展望,包括跨领域的合作与交流、多方参与的隐私框架设计和全球范围内的数据治理等方面。他们希望通过白皮书的发布,引起学术界和工业界对大型生成式模型安全与隐私问题的更多关注,并促进相关领域的持续研究和合作。 总的来说,《之江实验室:2023生成式大模型安全与隐私白皮书》深入剖析了当前大型生成式人工智能模型所面临的安全与隐私挑战,并提出了一系列切实可行的解决方案。这不仅对于当前大型生成式模型的安全性和隐私保护具有重要意义,也为未来人工智能技术的发展指明了方向。之江实验室的研究团队在这一领域的不懈努力和深入思考,必将为人工智能行业的发展贡献更多宝贵的经验和成果。

剩余59页未读,继续阅读

信息提交成功

信息提交成功