卷积神经网络(CNN)详解:图像识别的利器

32 浏览量

更新于2024-08-27

收藏 699KB PDF 举报

"AI学习笔记——卷积神经网络(CNN)"

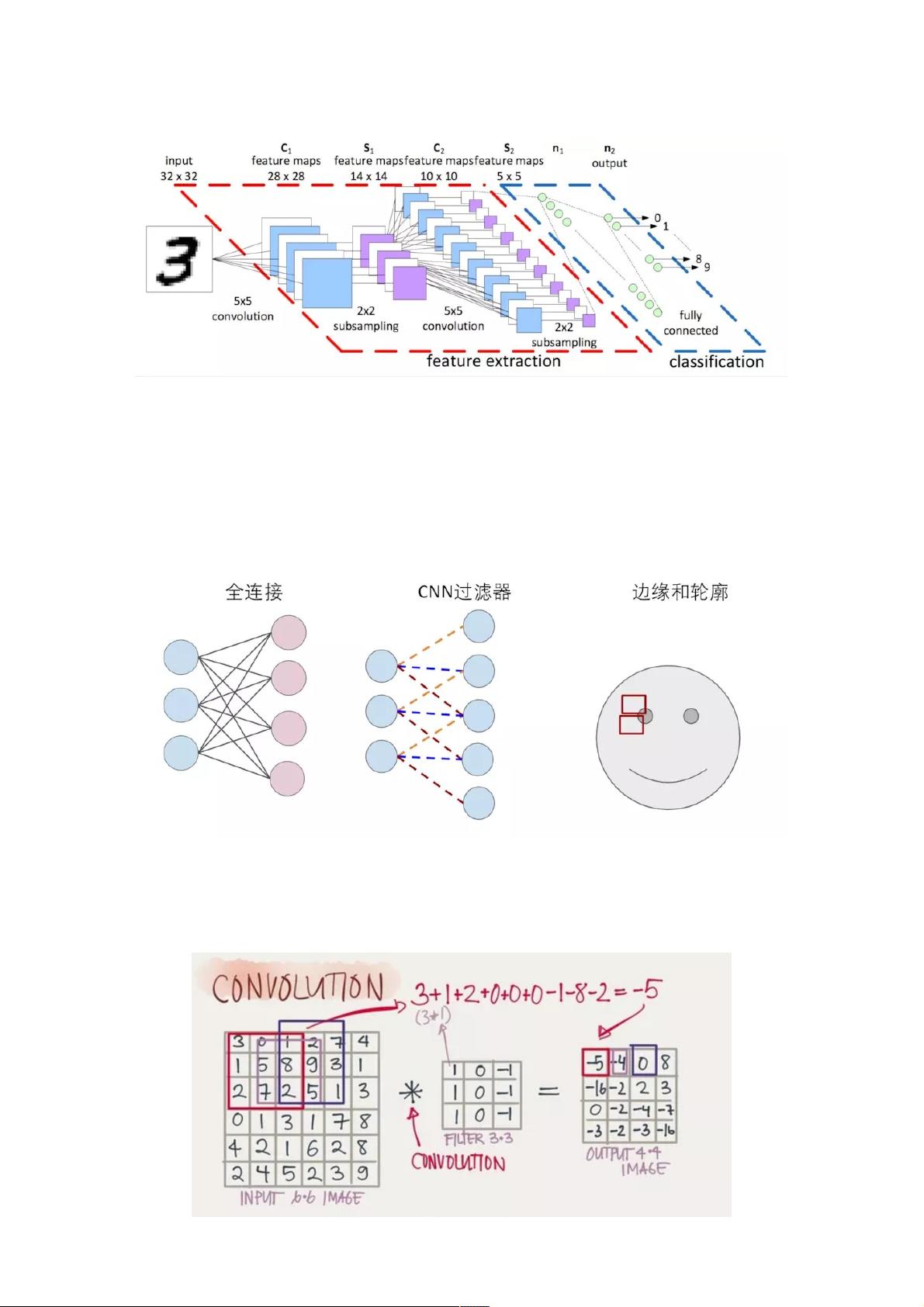

卷积神经网络(CNN)是一种专门用于处理具有网格结构数据,如图像、声音或文本的深度学习模型。相较于传统的全连接神经网络,CNN在图像识别任务中表现出了显著的优势。在全连接层中,每个神经元都会连接到前一层的所有神经元,这在处理图像时可能导致大量的参数和计算量,尤其对于高分辨率的图像。而CNN则引入了卷积层,有效地减少了参数数量并捕获了图像的局部特征。

卷积(Convolution)是CNN的核心操作。滤波器(Filter)或称核(Kernel)在图像上滑动,执行卷积运算,提取图像的特征。以一个6x6的图像和3x3的滤波器为例,滤波器在图像上按步长(Stride)滑动,一般步长为1,每次覆盖3x3的区域,进行卷积运算后得到新的特征值,最后输出一个较小尺寸的特征图(Feature Map)。

填充(Padding)是为了保持输出特征图的尺寸与输入图像接近或相同。在原始图像边缘添加额外的像素(通常是0),可以防止特征信息的丢失,并确保输出尺寸不变。

步长(Stride)决定了滤波器在图像上移动的步距。增大步长可以减少计算量,但可能会损失一些细节信息;减小步长则能捕捉更多细节,但会增加计算复杂性。

深度(Depth)是指特征图的通道数,对应于输入图像的颜色通道。例如,RGB图像有3个通道,滤波器也需要3个深度来处理每个通道。因此,一个3x3x3的滤波器应用于6x6x3的图像,会生成一个4x4x1的特征图,其中1表示输出特征图的深度。

除了卷积层,CNN还包括池化层(Pooling Layer)用于进一步减小尺寸,保持重要的特征,以及全连接层(Fully Connected Layer)用于分类或回归等任务。激活函数如ReLU(Rectified Linear Unit)用于引入非线性,使网络能够学习更复杂的模式。此外,批归一化(Batch Normalization)和dropout技术常用于加速训练过程和提高模型稳定性。

总而言之,卷积神经网络通过卷积、池化、全连接等操作,以及各种优化技术,高效地处理图像数据,广泛应用于图像识别、物体检测、图像分割等多个领域。

2022-11-26 上传

2023-02-27 上传

点击了解资源详情

点击了解资源详情

2018-04-12 上传

2021-09-30 上传

2019-12-26 上传

105 浏览量

2018-10-23 上传

weixin_38688890

- 粉丝: 6

- 资源: 964

最新资源

- JavaScript实现的高效pomodoro时钟教程

- CMake 3.25.3版本发布:程序员必备构建工具

- 直流无刷电机控制技术项目源码集合

- Ak Kamal电子安全客户端加载器-CRX插件介绍

- 揭露流氓软件:月息背后的秘密

- 京东自动抢购茅台脚本指南:如何设置eid与fp参数

- 动态格式化Matlab轴刻度标签 - ticklabelformat实用教程

- DSTUHack2021后端接口与Go语言实现解析

- CMake 3.25.2版本Linux软件包发布

- Node.js网络数据抓取技术深入解析

- QRSorteios-crx扩展:优化税务文件扫描流程

- 掌握JavaScript中的算法技巧

- Rails+React打造MF员工租房解决方案

- Utsanjan:自学成才的UI/UX设计师与技术博客作者

- CMake 3.25.2版本发布,支持Windows x86_64架构

- AR_RENTAL平台:HTML技术在增强现实领域的应用