线性回归与随机梯度下降:矩阵导数、最小二乘应用

需积分: 0 113 浏览量

更新于2024-08-05

收藏 26.23MB PDF 举报

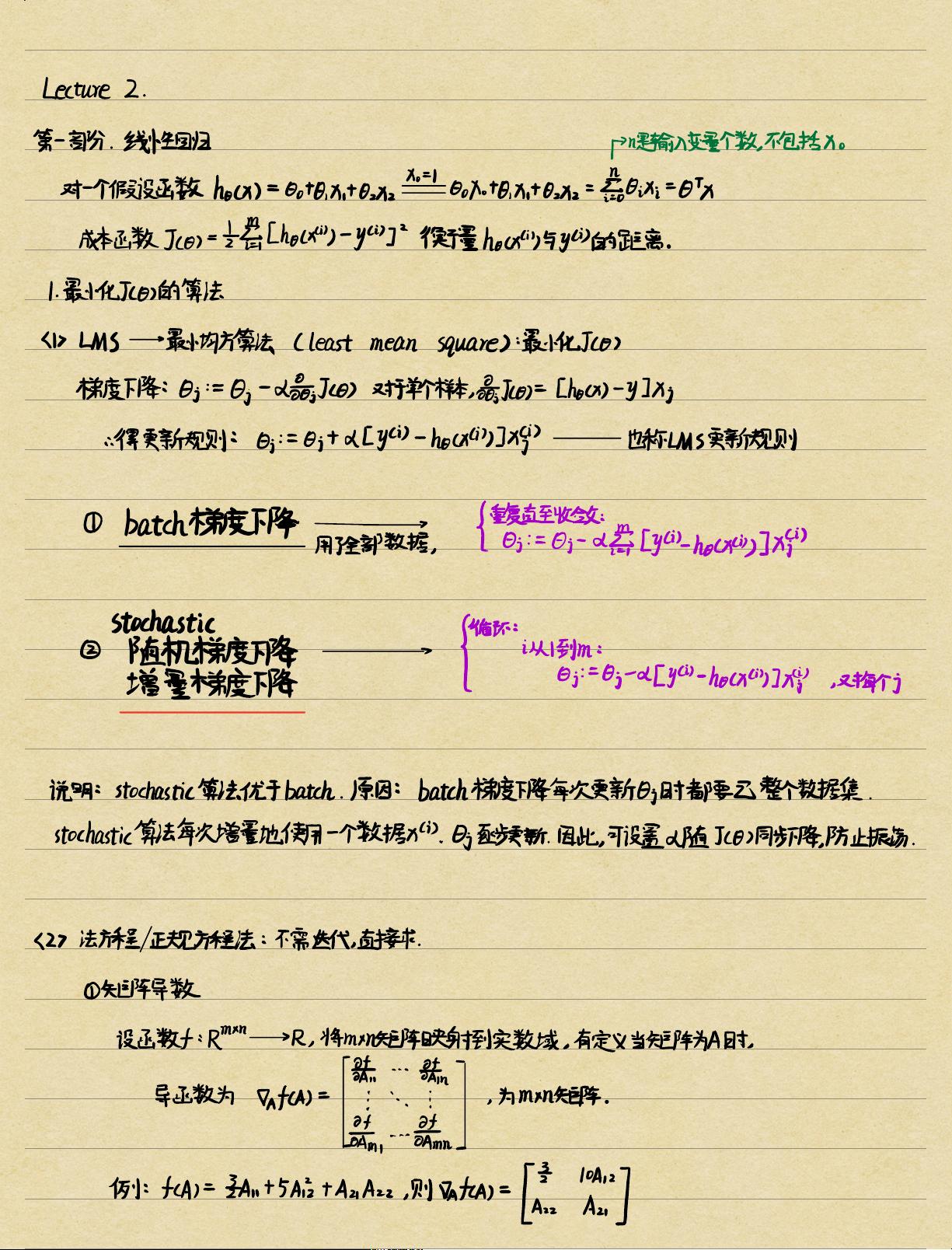

本资源主要聚焦在【线性回归模型】和相关的数学概念上,包括梯度下降算法、矩阵导数和最小二乘法。以下是关键知识点的详细解析:

1. **线性回归模型**:这是一个统计学方法,用于预测一个连续变量(因变量)如何依赖于一个或多个其他变量(自变量)。目标是找到一个线性函数,即y = wx + b,其中y是预测值,w是权重向量,x是输入特征,b是偏置项。

2. **随机梯度下降**:这是一种迭代优化算法,用于最小化成本函数。在线性回归中,它通过逐个处理训练样本,计算梯度并更新模型参数来逐步逼近全局最优解。相比于批量梯度下降,随机梯度下降在大数据集上更为高效,因为它避免了每次都计算所有样本的梯度。

3. **矩阵导数**:在机器学习中,矩阵导数用于计算成本函数关于模型参数的梯度。例如,对于mxn矩阵A,矩阵导数可以帮助我们理解函数对A的变化率,这对于梯度更新至关重要。矩阵导数的应用可以简化计算过程,如在最小二乘法中找到最佳权重。

4. **最小二乘法**:这是解决线性回归问题的经典方法,通过最小化残差平方和(RSS),即(实际值-y预测值)²的总和来找到最佳拟合直线。在矩阵形式下,通过正规方程或直接求解成本函数的梯度等于零,得出最佳权重向量和偏置。

5. **正规方程法**:这是一种直接求解最小二乘问题的数学工具,无需迭代。它利用矩阵运算求解最佳权重,适用于数据量较小的情况,避免了梯度下降的计算复杂性。

6. **梯度下降的更新规则**:无论是批量梯度下降还是随机梯度下降,核心都是沿着成本函数梯度的负方向更新参数,以降低函数值。具体规则如批量梯度下降的公式和随机梯度下降的增量方式。

本资源详细介绍了线性回归模型中的基本概念和技术,包括梯度下降的两种形式及其在优化过程中的应用,以及矩阵导数和最小二乘法在模型参数估计中的作用。这些知识对于理解和实施线性回归模型至关重要。

2022-07-14 上传

2023-06-09 上传

2024-05-27 上传

2021-01-07 上传

2022-09-24 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

柏傅美

- 粉丝: 32

- 资源: 325

最新资源

- 一种径向基函数神经网络在线训练算法及其在

- Microsoft+Visual+C#+2008+Step+by+Step

- Internet Routing Architechtures 2nd.pdf

- Ruby语言入门教程(中文)

- 机器人硬件分析很好的

- WAS安装手册WEBSPHERE.pdf

- 学生信息管理系统论文

- Audio Signal Processing and Coding

- 《Ubuntu图书大全》

- PPT批量转DOC的代码

- Windows 7加快系统速度的八大方法 (有图)

- 电力变压器铁心柱截面的优化设计

- 串行DataFlash存储器及其与单片机的接口

- 福布斯电脑革命史.pdf

- hibernate教程

- 软件工程设计总体设计说明书