深度学习无监督课程:生成式对抗网络全面解析

需积分: 50 147 浏览量

更新于2024-07-16

1

收藏 30.43MB PDF 举报

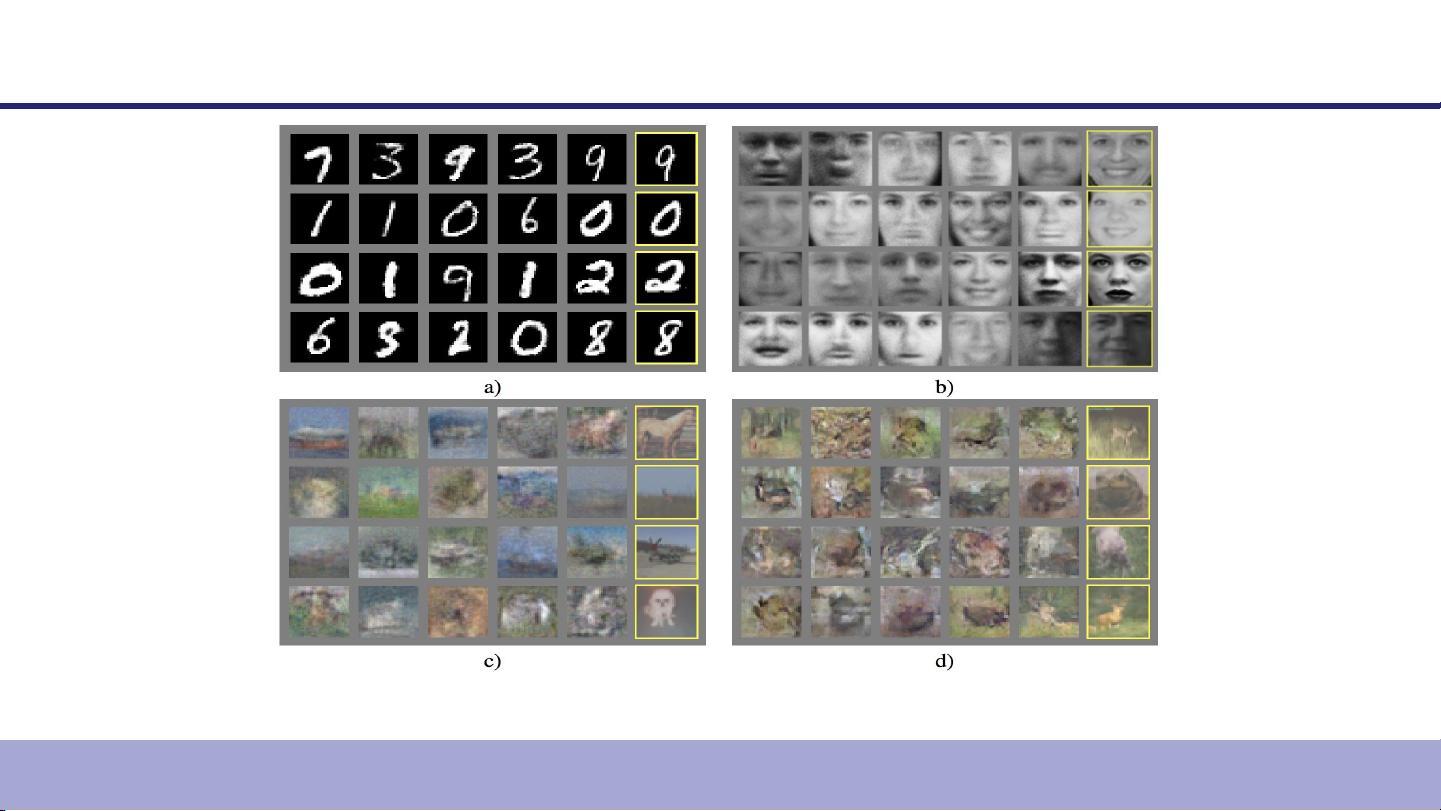

"这份资源是关于《生成式对抗网络》的详细技术综述,包含257页的PPT,涵盖了从基础的GAN到各种改进版本的深入探讨,如DC GAN、Improved GAN、WGAN、WGAN-GP、Progr. GAN、SN-GAN、SAGAN、BigGAN(-Deep)、StyleGAN v1和v2以及VIB-GAN。资料来自UC Berkeley的CS294-158 Deep Unsupervised Learning课程,由Pieter Abbeel等人主讲。内容包括了隐式模型的动机和定义、原始GAN的介绍、评估方法、理论分析、GAN的演进历程以及对抗性损失在其他领域的应用等。"

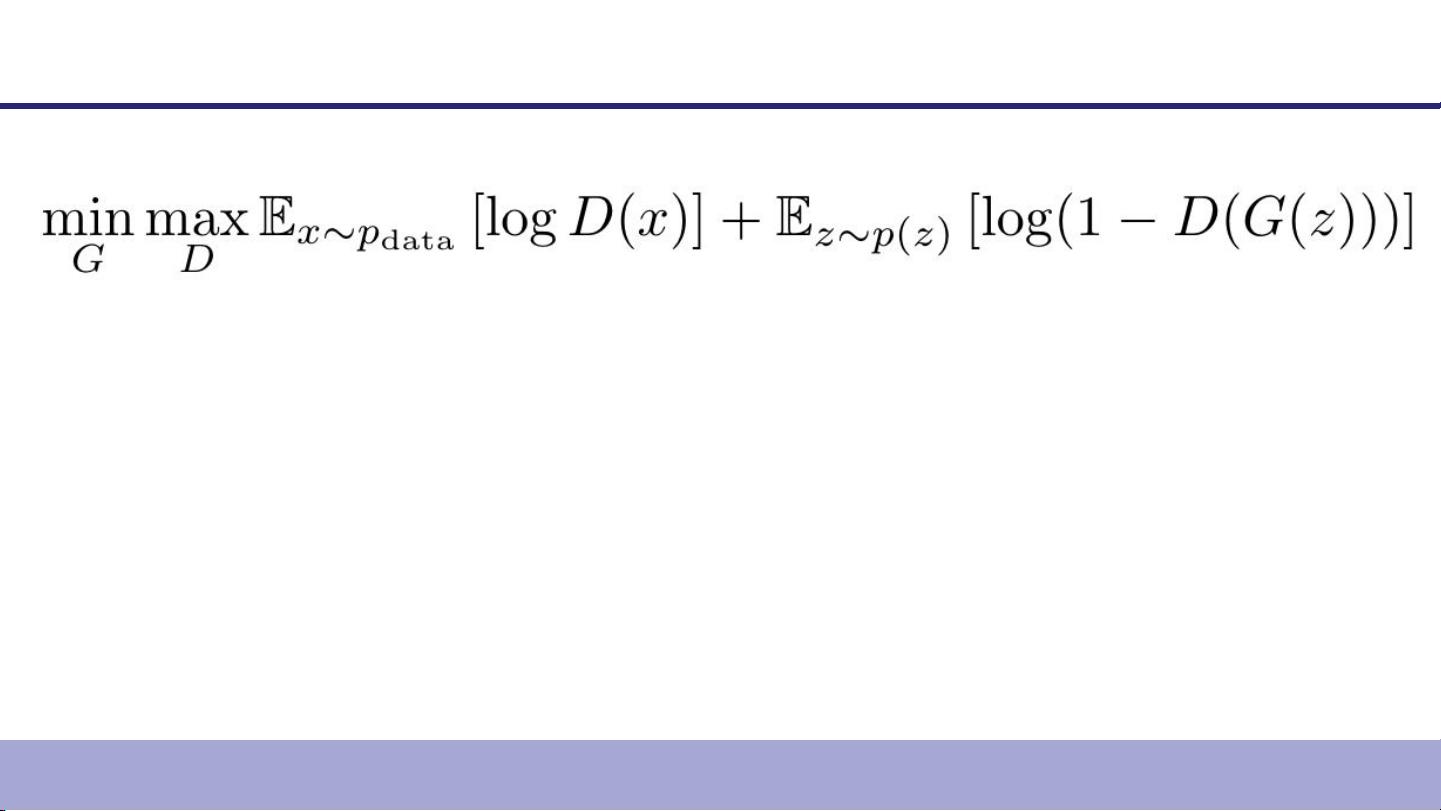

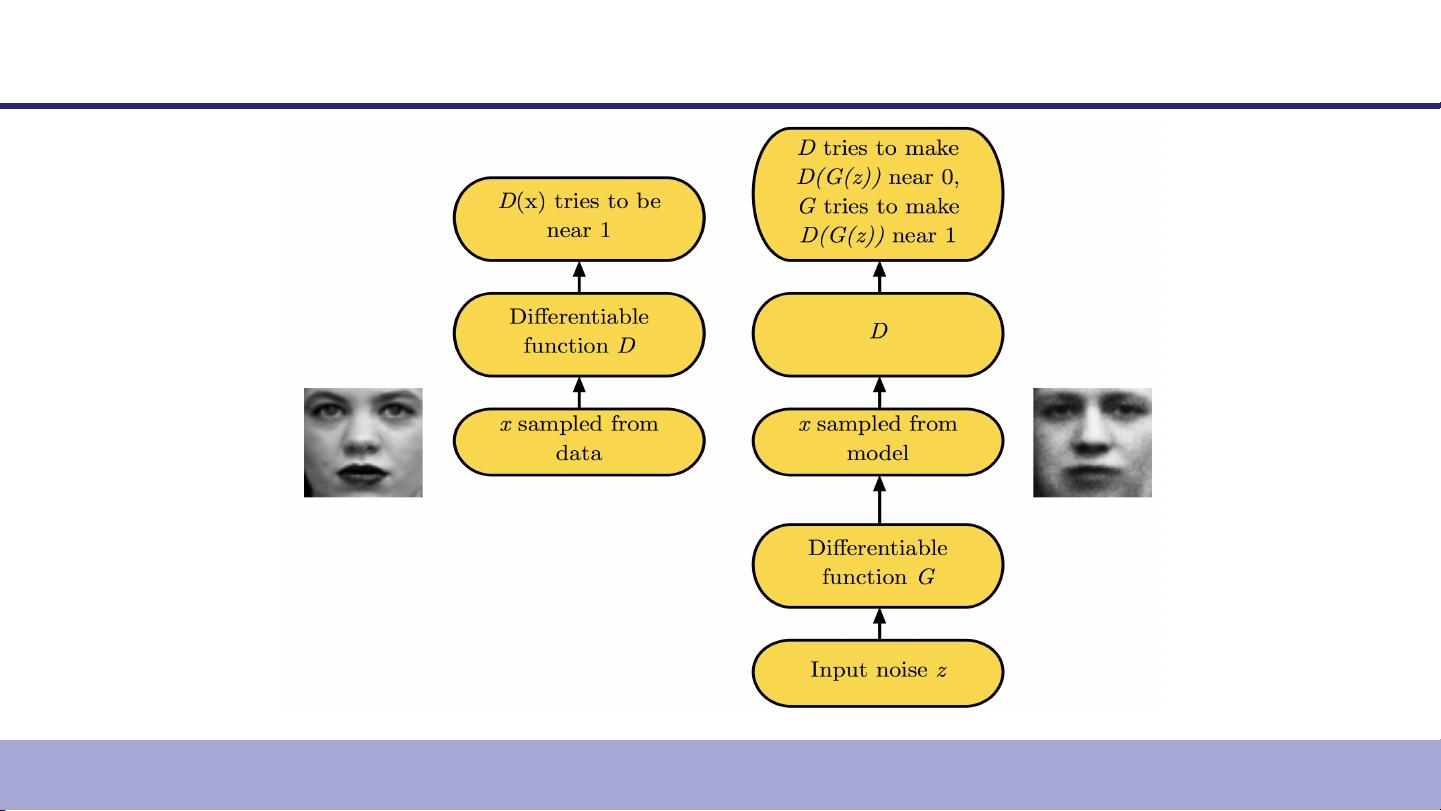

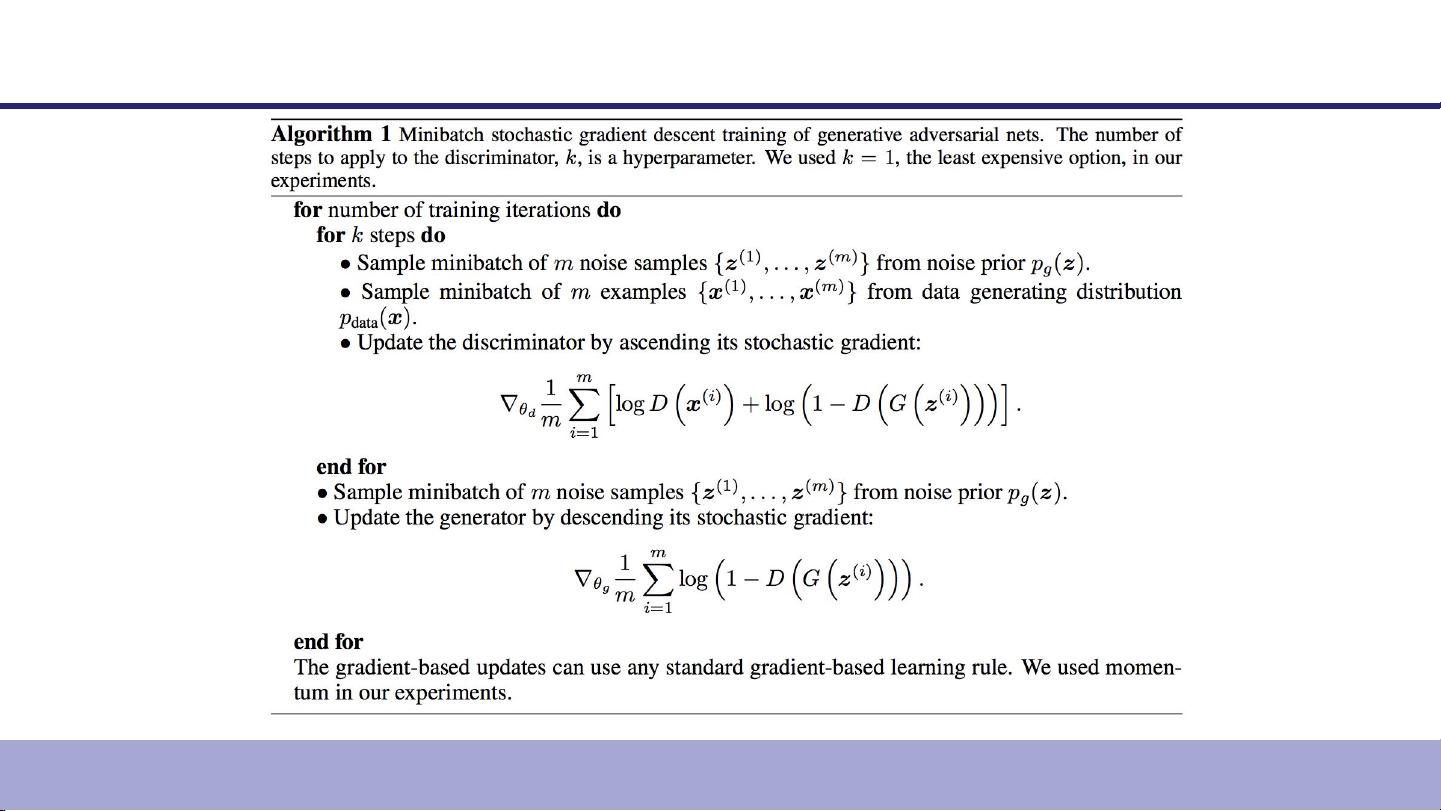

生成式对抗网络(Generative Adversarial Networks,GANs)是一种深度学习框架,由两个神经网络模型——生成器(Generator)和判别器(Discriminator)构成。它们之间进行对抗性训练,生成器试图创造与训练数据相似的样本,而判别器则尝试区分真实样本和生成器产生的假样本。

原始GAN由Goodfellow等人在2014年提出,其核心思想是通过最小化生成器使判别器无法区分真假样本的概率,来逐步提升生成器的生成能力。DCGAN(Deep Convolutional Generative Adversarial Networks)是GAN的一个变体,引入了卷积神经网络,使得在图像生成任务上更加有效。

评价GANs的方法有多种,如Parzen窗估计、Inception Score和Frechet Inception Distance(FID)。Parzen窗可以估计生成分布,Inception Score衡量生成图像的多样性与质量,FID则是通过比较生成样本与真实样本的高维特征分布距离来评估性能。

理论分析方面,讨论了Bayes最优判别器、Jensen-Shannon散度(JS散度)以及模式塌陷和饱和问题。Bayes最优判别器指出了理想情况下判别器应达到的性能,JS散度则用于衡量两个概率分布的相似性,模式塌陷是指生成器可能只学会生成部分训练数据的模式,而非全部。

GAN的演进历程中,WGAN( Wasserstein GAN)和WGAN-GP(Wasserstein GAN with Gradient Penalty)解决了原始GAN训练不稳定的问题,引入了Wasserstein距离来度量生成器和真实数据分布的差距。Progressive GAN逐步增加生成器的分辨率,SN-GAN(Spectral Normalization GAN)通过谱归一化稳定训练过程,SAGAN(Self-Attention GAN)引入自注意力机制以提高生成质量。

BigGAN系列是GAN在大规模图像生成上的突破,尤其是BigGAN-Deep,它在ImageNet数据集上表现优异。StyleGAN系列引入了风格分离的概念,使得生成的人脸等图像具有更精细的控制和更高的逼真度。VIB-GAN将变分自编码器(VAE)的观念与GAN相结合,以实现更好的样本质量和多样性。

除了图像生成,GANs也被应用于创造创意条件化的图像,比如绘画风格转换。此外,GANs在表示学习、能量模型、最优传输理论、隐式似然模型和矩匹配等领域都有研究。对抗性损失也被用于迁移学习、公平性问题以及模仿学习中,展示出其在多方面的应用潜力。

点击了解资源详情

426 浏览量

119 浏览量

426 浏览量

1108 浏览量

2022-08-04 上传

125 浏览量

489 浏览量

1135 浏览量

syp_net

- 粉丝: 158

最新资源

- 久度免费文件代存系统 v1.0:全技术领域源码分享

- 深入解析caseyjpaul.github.io的HTML结构

- HTML5视频播放器的实现与应用

- SSD7练习9完整答案解析

- 迅捷PDF完美转PPT技术:深度识别PDF内容

- 批量截取子网页工具:Python源码分享与使用指南

- Kotlin4You: 探索设计模式与架构概念

- 古典风格茶园茶叶酿制企业网站模板

- 多功能轻量级jquery tab选项卡插件使用教程

- 实现快速增量更新的jar包解决方案

- RabbitMQ消息队列安装及应用实战教程

- 简化操作:一键脚本调用截图工具使用指南

- XSJ流量积算仪控制与数显功能介绍

- Android平台下的AES加密与解密技术应用研究

- Место-响应式单页网站的项目实践

- Android完整聊天客户端演示与实践