流形学习增强GAN性能:稳定训练与模式多样性

PDF格式 | 1.07MB |

更新于2024-06-20

| 4 浏览量 | 举报

"这篇论文探讨了流形学习在生成对抗网络(GAN)中的应用,旨在改进GAN的表现。通过将流形学习与鉴别器的层相结合,作者们提出了局部约束的线性和非线性流形方法,以引导中间特征向量更接近流形。这种方法有助于解决GAN训练中的不稳定性、模式崩溃和过拟合问题。实验结果显示,局部约束的非线性流形优于线性流形,因为它能更好地处理非均匀密度和保持光滑性。"

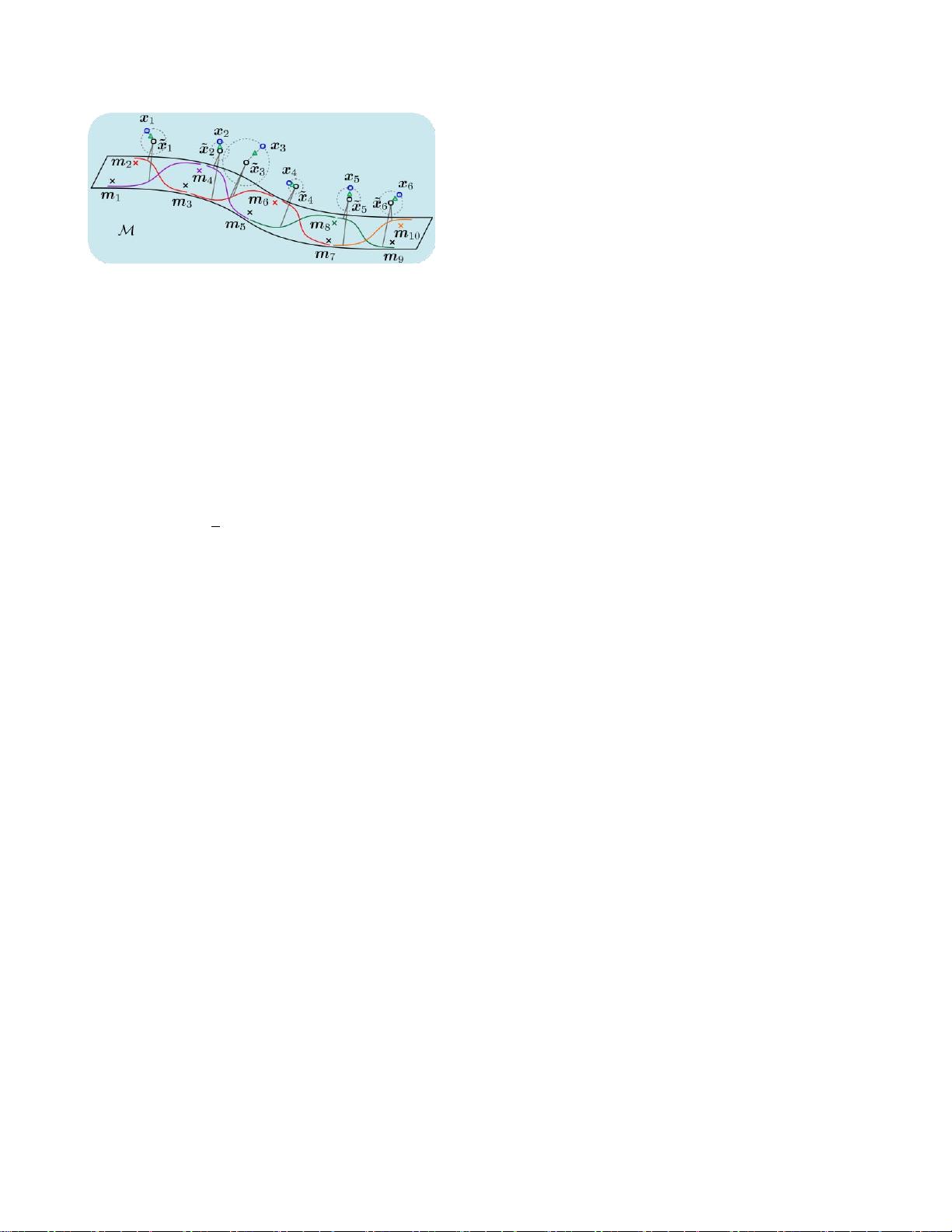

在生成对抗网络(GAN)中,流形学习引入了一个新的视角,即通过学习数据的内在结构来优化生成过程。流形学习是一种数据分析技术,用于揭示高维数据集中的低维结构。在GAN中,这个概念被用来约束生成器的输出,使其更符合实际数据的分布。论文指出,将流形学习与鉴别器的层次结构结合,可以逐步引导中间特征向量向流形靠拢,从而提高生成质量。

原始的GAN模型由一个生成器(G)和一个鉴别器(D)组成,它们通过一个最小-最大博弈进行训练。生成器尝试从随机噪声生成逼真的样本,而鉴别器则试图区分真实数据和生成数据。然而,这种训练过程可能会遭遇不稳定、模式崩溃和过拟合等问题。

为了解决这些问题,论文提出了局部约束的线性流形和非线性流形方法。线性流形假设数据分布近似于一个低维线性空间,而非线性流形则考虑了数据可能具有的复杂非线性结构。这两种方法都在鉴别器的层次中应用,通过自适应地调整特征表示与流形视图的差异,达到在流形上进行去噪和细化的目的。

实验结果表明,非线性流形方法在处理非均匀密度的数据时表现更优,因为它们能够更好地捕捉数据的局部特性。这有助于避免模式崩溃,即生成器过度简化数据分布,导致生成的样本过于单一。此外,非线性流形还能够保持流形的光滑性,有助于生成更加连贯和多样化的样本。

将流形学习融入GAN框架提供了一种新的优化策略,有助于提升生成模型的稳定性和生成样本的质量。通过这种方式,GAN不仅能够更好地学习数据的内在结构,还可以降低训练的难度,减少常见的训练问题,从而在图像生成、声音合成等领域实现更优的表现。

相关推荐

cpongm

- 粉丝: 6

最新资源

- Verilog实现的Xilinx序列检测器设计教程

- 九度智能SEO优化软件新版发布,提升搜索引擎排名

- EssentialPIM Pro v11.0 便携修改版:全面个人信息管理与同步

- C#源代码的恶作剧外表答题器程序教程

- Weblogic集群配置与优化及常见问题解决方案

- Harvard Dataverse数据的Python Flask API教程

- DNS域名批量解析工具v1.31:功能提升与日志更新

- JavaScript前台表单验证技巧与实例解析

- FLAC二次开发实用论文资料汇总

- JavaScript项目开发实践:Front-Projeto-Final-PS-2019.2解析

- 76云保姆:迅雷云点播免费自动升级体验

- Android SQLite数据库增删改查操作详解

- HTML/CSS/JS基础模板:经典篮球学习项目

- 粒子群算法优化GARVER-6直流配网规划

- Windows版jemalloc内存分配器发布

- 实用强大QQ机器人,你值得拥有