深度学习新篇章:卷积神经网络在图像识别中的全面综述

需积分: 50 98 浏览量

更新于2024-07-19

1

收藏 3.14MB PDF 举报

"深度卷积神经网络在图像分类任务中的应用与综合回顾"

深度卷积神经网络(Deep Convolutional Neural Networks,简称CNN)自20世纪80年代末期开始应用于视觉任务,但真正迎来爆发式发展是在21世纪初,这主要得益于计算能力的提升、大量标注数据的出现以及优化算法的进步。CNN如今已成为神经网络复兴的领头羊,尤其在图像分类领域取得了显著成果。

1. CNN的历史与先驱:CNN的前身可以追溯到早期的滤波器模型和局部连接神经网络。这些早期工作奠定了CNN的基础,例如Hubel和Wiesel的工作揭示了大脑皮层中视觉处理的局部和方向敏感特性,为CNN的设计提供了灵感。

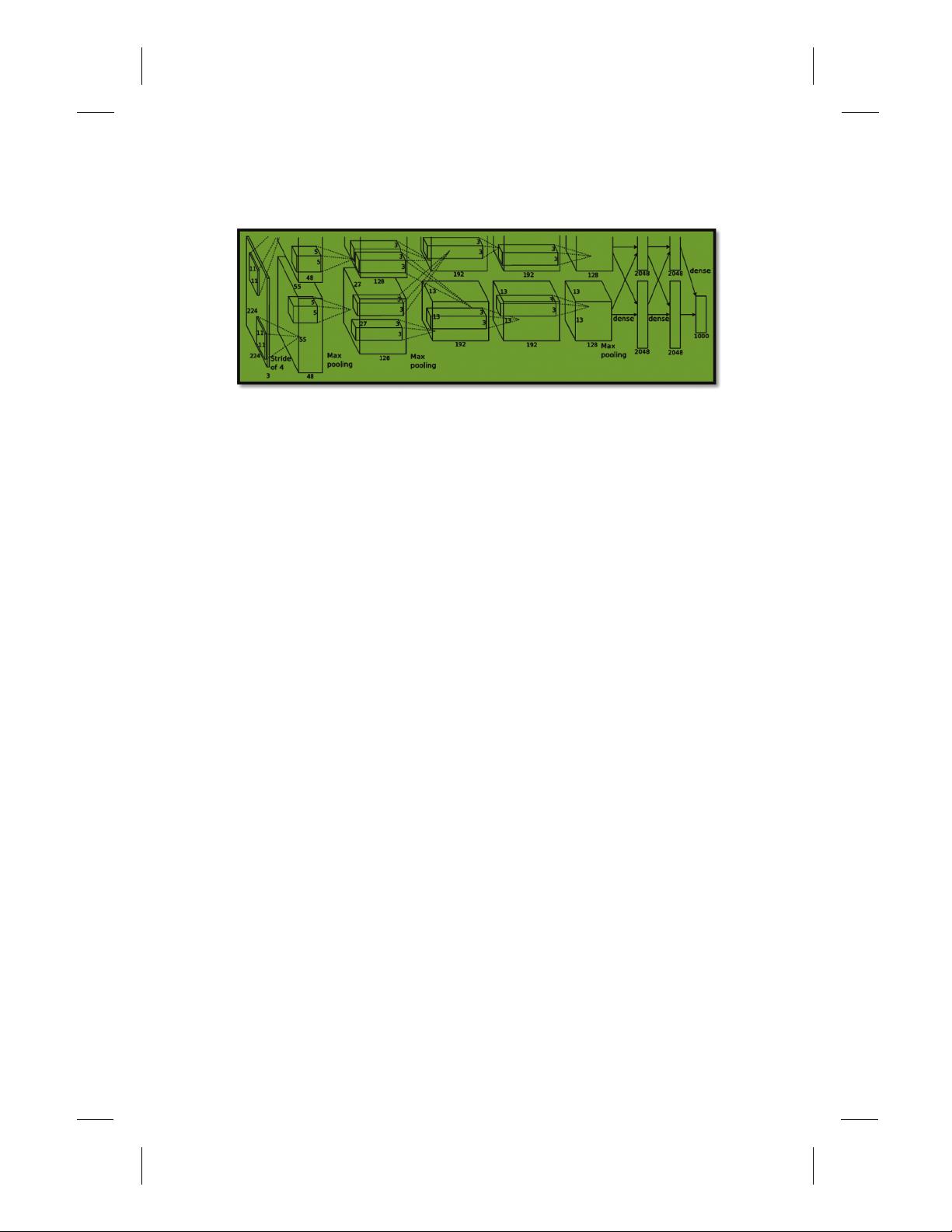

2. CNN的复兴:2000年代中期,随着GPU计算能力的增强,以及如ImageNet这样的大型标注图像数据库的出现,CNN开始受到广泛关注。2012年,AlexNet在ImageNet图像识别挑战赛上的突破性表现,标志着深度学习时代的开启,CNN在此过程中起到了关键作用。

3. CNN的结构与原理:CNN的核心特点是卷积层、池化层和全连接层。卷积层通过可学习的滤波器对输入图像进行特征提取,池化层则用于降低数据维度,保持计算效率。全连接层将提取的特征映射到预定义的类别上。此外,ReLU激活函数、批量归一化和dropout等技术也对提升CNN性能至关重要。

4. CNN在图像分类的应用:CNN已经成为处理图像分类任务的标准工具,广泛应用于物体识别、人脸识别、医学图像分析、自动驾驶等多个领域。其强大的特征学习能力和对图像局部结构的捕获能力,使得CNN在处理复杂视觉问题时表现出色。

5. 近期的进展与挑战:近年来,研究者不断提出新的架构,如ResNet(残差网络)、DenseNet(稠密连接网络)和Inception系列,以解决深度网络中的梯度消失和过拟合问题。同时,模型的迁移学习和微调策略也使得CNN能在有限的训练数据下取得良好效果。然而,CNN仍面临计算效率、模型解释性和泛化能力等方面的挑战。

6. 展望未来:未来的研究可能会集中在开发更高效、可解释的CNN变体,利用无监督学习或自我监督学习来减少对标注数据的依赖,以及探索如何结合其他机器学习方法(如强化学习和生成对抗网络)以提升整体性能。

深度卷积神经网络在图像分类领域的应用和研究已经取得了显著的成就,但这个领域仍有大量的探索空间,未来有望继续推动计算机视觉和人工智能的发展。

2019-07-21 上传

2021-01-07 上传

2022-07-15 上传

2021-12-15 上传

2023-05-03 上传

2024-01-16 上传

2023-03-30 上传

2023-06-08 上传

RoaringKitty

- 粉丝: 6w+

- 资源: 26

最新资源

- Java毕业设计项目:校园二手交易网站开发指南

- Blaseball Plus插件开发与构建教程

- Deno Express:模仿Node.js Express的Deno Web服务器解决方案

- coc-snippets: 强化coc.nvim代码片段体验

- Java面向对象编程语言特性解析与学生信息管理系统开发

- 掌握Java实现硬盘链接技术:LinkDisks深度解析

- 基于Springboot和Vue的Java网盘系统开发

- jMonkeyEngine3 SDK:Netbeans集成的3D应用开发利器

- Python家庭作业指南与实践技巧

- Java企业级Web项目实践指南

- Eureka注册中心与Go客户端使用指南

- TsinghuaNet客户端:跨平台校园网联网解决方案

- 掌握lazycsv:C++中高效解析CSV文件的单头库

- FSDAF遥感影像时空融合python实现教程

- Envato Markets分析工具扩展:监控销售与评论

- Kotlin实现NumPy绑定:提升数组数据处理性能