大规模图神经网络:挑战与优化策略

需积分: 0 114 浏览量

更新于2024-06-18

收藏 1.06MB PDF 举报

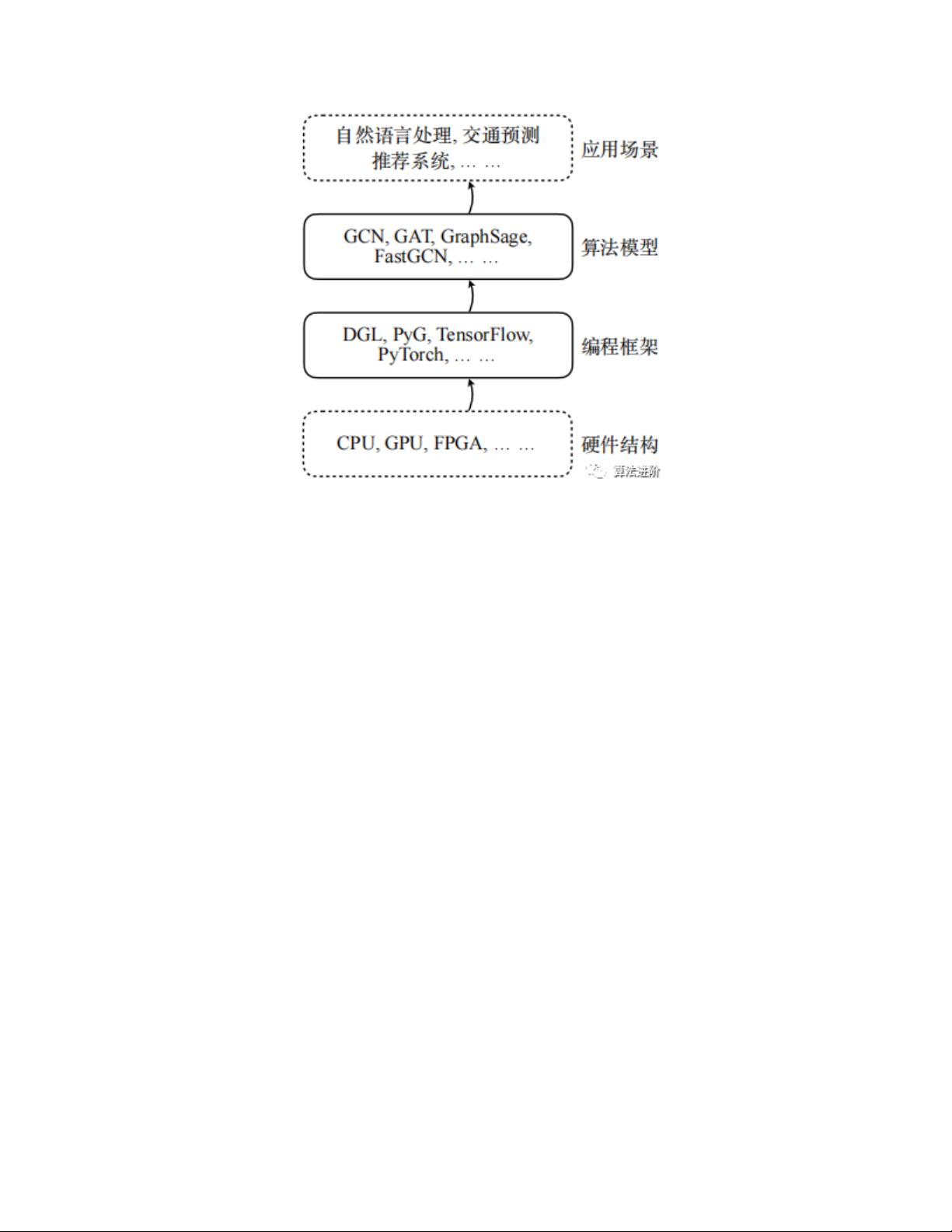

"本文主要探讨了图神经网络(GNN)在大规模数据处理中的挑战与应对策略,包括图数据结构的特性、GNN模型的问题、数据规模的影响以及硬件平台的限制,并介绍了相关的优化方法和编程框架进展。"

图神经网络(GNN)是一种将传统神经网络扩展到非欧几里得数据结构上的模型,特别适合处理具有复杂关系的数据,如社交网络、知识图谱等。其核心机制是消息传递,通过节点之间的交互来更新每个节点的特征表示。

在大规模图数据中,GNN面临着多方面的挑战。首先,图数据结构的不规则性、稀疏性和动态性使得数据访问和处理变得复杂,尤其是在节点邻居数量分布幂律的情况下,这给高效内存管理和分布式计算带来了难题。其次,GNN模型通常需要处理高维节点表示,虽然提高了模型表达力,但也导致了计算和内存消耗的增加,尤其是当网络深度增加时,邻居节点的爆炸性增长会加剧这一问题。再者,全图训练受限于内存,而分批训练则会引入更多的分割和更新问题。最后,现有的硬件平台,如CPU和GPU,往往不能兼顾不规则数据读取和密集计算的需求,进一步加大了大规模GNN模型的加速难度。

为了解决这些挑战,研究者们已经提出了多种策略。一种常见方法是采用采样技术,如基于节点、边或子图的采样,来减少需要处理的节点和边的数量,从而降低计算和内存负担。此外,针对特定硬件平台优化的编程框架,如图计算库,也在加速GNN计算方面发挥了重要作用,它们提供了针对不规则数据的优化访问和并行计算支持。

例如,针对图数据结构的特性,可以设计有效的采样策略,如GraphSAGE、FastGCN等,以减少计算复杂度。对于GNN模型,可以探索轻量级的模型结构或者利用层次化结构来缓解节点邻居爆炸问题。在数据规模方面,分片和分布式训练技术可以帮助处理大型图数据集。硬件优化方面,FPGA和TPU等专用硬件可能提供更好的性能,或者通过混合CPU-GPU计算来平衡不同任务的需求。

GNN在处理大规模图数据时面临诸多挑战,但通过模型创新、数据处理策略和硬件优化,研究者们正在不断推动GNN在各种应用中的性能提升和可扩展性。未来,随着计算资源和算法技术的进步,我们可以期待GNN在更广泛的领域发挥更大的作用。

2020-03-31 上传

论文

论文

论文

论文

论文

2023-05-02 上传

白话机器学习

- 粉丝: 1w+

- 资源: 7693

最新资源

- Hadoop生态系统与MapReduce详解

- MDS系列三相整流桥模块技术规格与特性

- MFC编程:指针与句柄获取全面解析

- LM06:多模4G高速数据模块,支持GSM至TD-LTE

- 使用Gradle与Nexus构建私有仓库

- JAVA编程规范指南:命名规则与文件样式

- EMC VNX5500 存储系统日常维护指南

- 大数据驱动的互联网用户体验深度管理策略

- 改进型Booth算法:32位浮点阵列乘法器的高速设计与算法比较

- H3CNE网络认证重点知识整理

- Linux环境下MongoDB的详细安装教程

- 压缩文法的等价变换与多余规则删除

- BRMS入门指南:JBOSS安装与基础操作详解

- Win7环境下Android开发环境配置全攻略

- SHT10 C语言程序与LCD1602显示实例及精度校准

- 反垃圾邮件技术:现状与前景