基于语义的图像生成[56,75]和文本引导的图像操作模

型[48,66]。尽管注意力模型已经使图像生成任务受

益,但我们相信可以通过使用注意力模块[103]中的最

新成就为最先进的图像合成模型[43](不涉及注意力)

供电来进一步改善结果此外,我们为鉴别器设计了一

种新的参考注意力架构,并在有限规模的数据集上显

示出进一步的提升。

3.

方法

我们对GANs的改进包括一种新的双重对比损失和注

意力机制的变体。对于每一个改进,我们组织的背景

下,在方法制定和实验研究之间的在验证我们的最佳

配置后,我们将其与第4节中的最新配置进行比较。

3.1.

双重对比损失

对抗性训练依赖于鉴别器假分类与其他分类任务一

样,当数据集

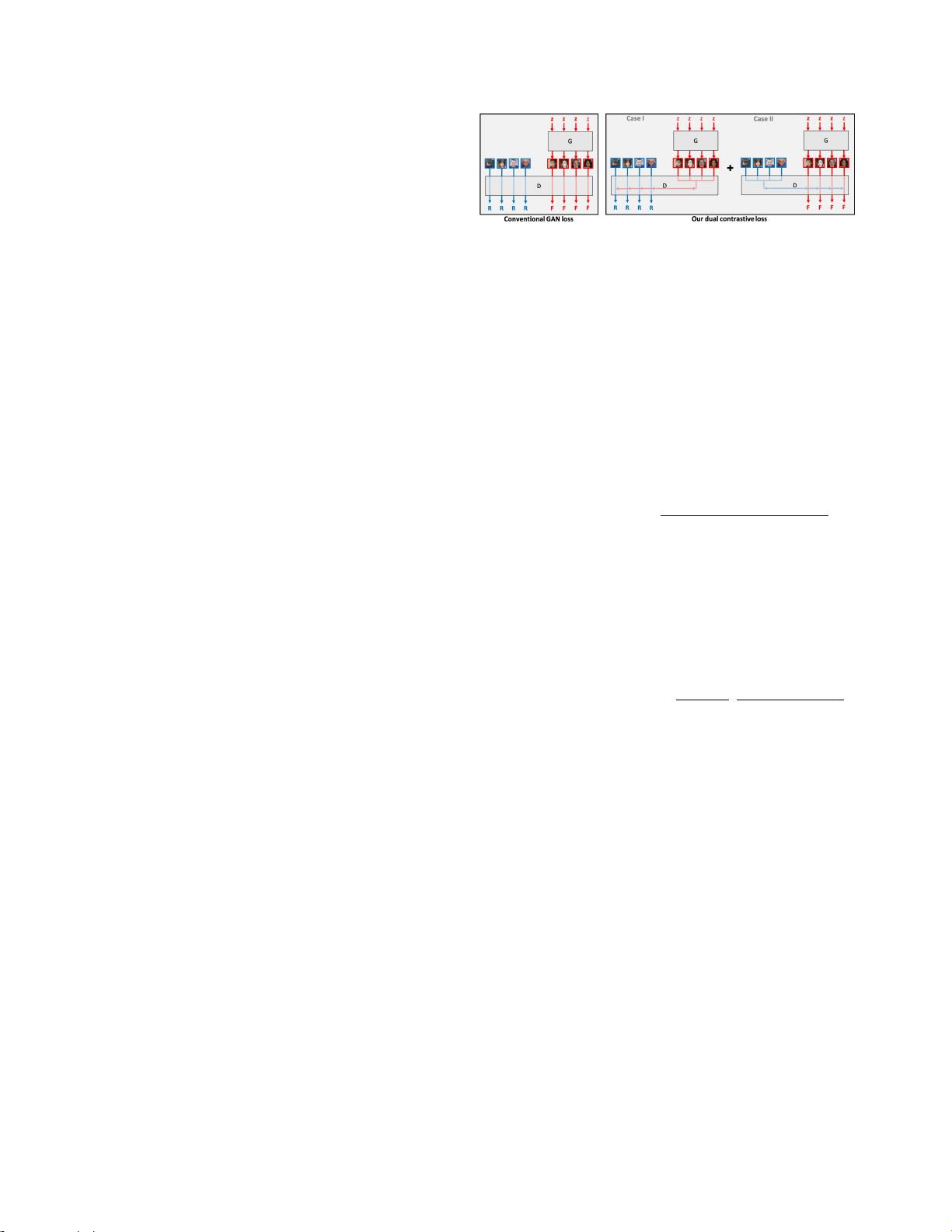

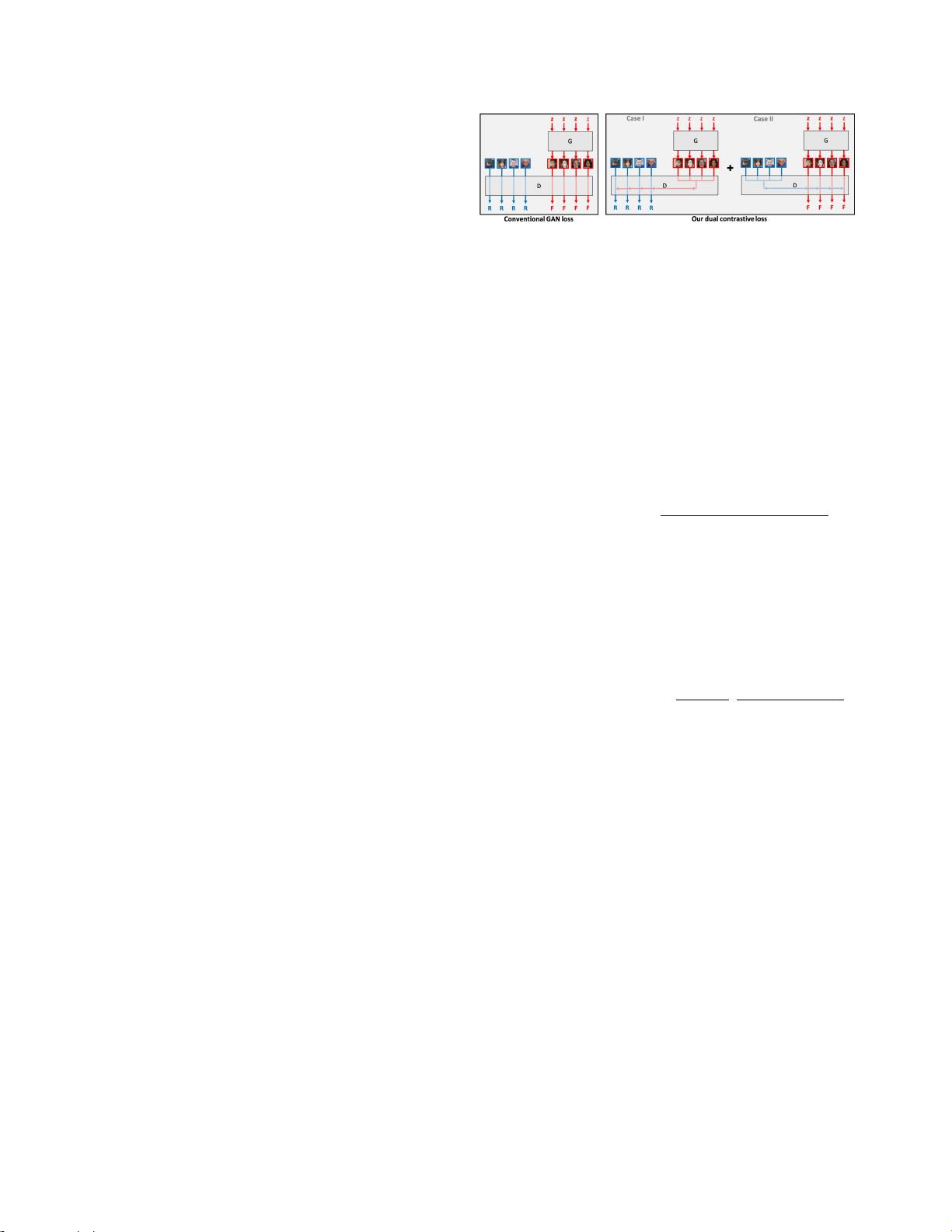

图

2.

传统

GAN

损耗图与我们的双对比损耗图的比较我们在案

例

I

中的对比损失旨在教导鉴别器将单个真实图像(

R

)与一

批生成的图像(

F

)分离在案例

II

中,鉴别器学习将单个生成

的图像与一批真实图像分离。

过时的图像在案例II中,鉴别器学习将单个生成的图像

与一批真实图像分离。生成器逆向学习以最小化这种

双重对比。在数学上,我们通过将[24,43]中使用的二

进制分类扩展到噪声对比估计框架[61]来推导这个损失

函数,这是softmax交叉熵公式中的一个对一个批次分

类新配方如下:

在情况I中:

尺寸有限[2]。另一方面,在更大的数据集上,没有研

究表明disciminator过拟合,但我们

假设对抗性训练仍然可以受益于新的损失函数,该损

失函数鼓励区分性

鉴别器表示的功率对于它们的实数与假分类任务。

我们把另一个镜头上的表征能力的鉴别器,通过对

比学习激励一代。对比学习将数据点和

他们的积极的例子和分离的其他点

在数据集中,这些被称为负例。它最近被各种无监督

学习作品[26,61,76,8,9]和生成作品[63,40,106]

重新普及

在这些研究中,对比学习被作为辅助任务使用例如,

在图像到图像转换任务中,

翻译器学习通过对抗损失输出给定马图像的斑马图

像,并且此外学习通过对比损失函数对齐输入的马图

像和生成的斑马图像[63]。对比损失在那工作被利用

使得给定的示出输出斑马的腿的块应该与输入马的对

应腿强关联,比从马图像随机提取的其它块更强关联

在这项工作中,与以前的不同,我们不使用对比学

习作为辅助任务,而是通过一种新的损失函数公式直

接将其耦合到主要的对抗训练中。据我们所知,对于

第一次训练一个无条件GAN

比较Eq.在图1和图2中,通过切换真实/虚假采样的

顺序同时保持其他计算不变来制定对偶性与逻辑损失

[24,43]相比,对比损失丰富了softplus公式。

lationlog(1

+

e

D

(

·

)

)与一批内部项,并使用鉴别器logit

对比真实和假样本。最后,我们的对抗目标是:

min max

L

contr

(

G

,

D

)+

L

contr

(

G

,

D

)

(

3

)

对比损失函数的目的是教导鉴别器将单个真实图像与

一批通用图像分离。

损耗设计研究。我们广泛验证了双对比损失的有效

性相比,其他