NVIDIA GPU深度学习服务器配置全攻略

需积分: 48 12 浏览量

更新于2024-07-18

2

收藏 2.4MB PDF 举报

"GPU人工智能服务器配置指南"

在构建一个用于深度学习的人工智能服务器时,GPU的选择和配置至关重要。本指南将提供关于GPU的不同型号选择、软件安装以及系统配置的建议。

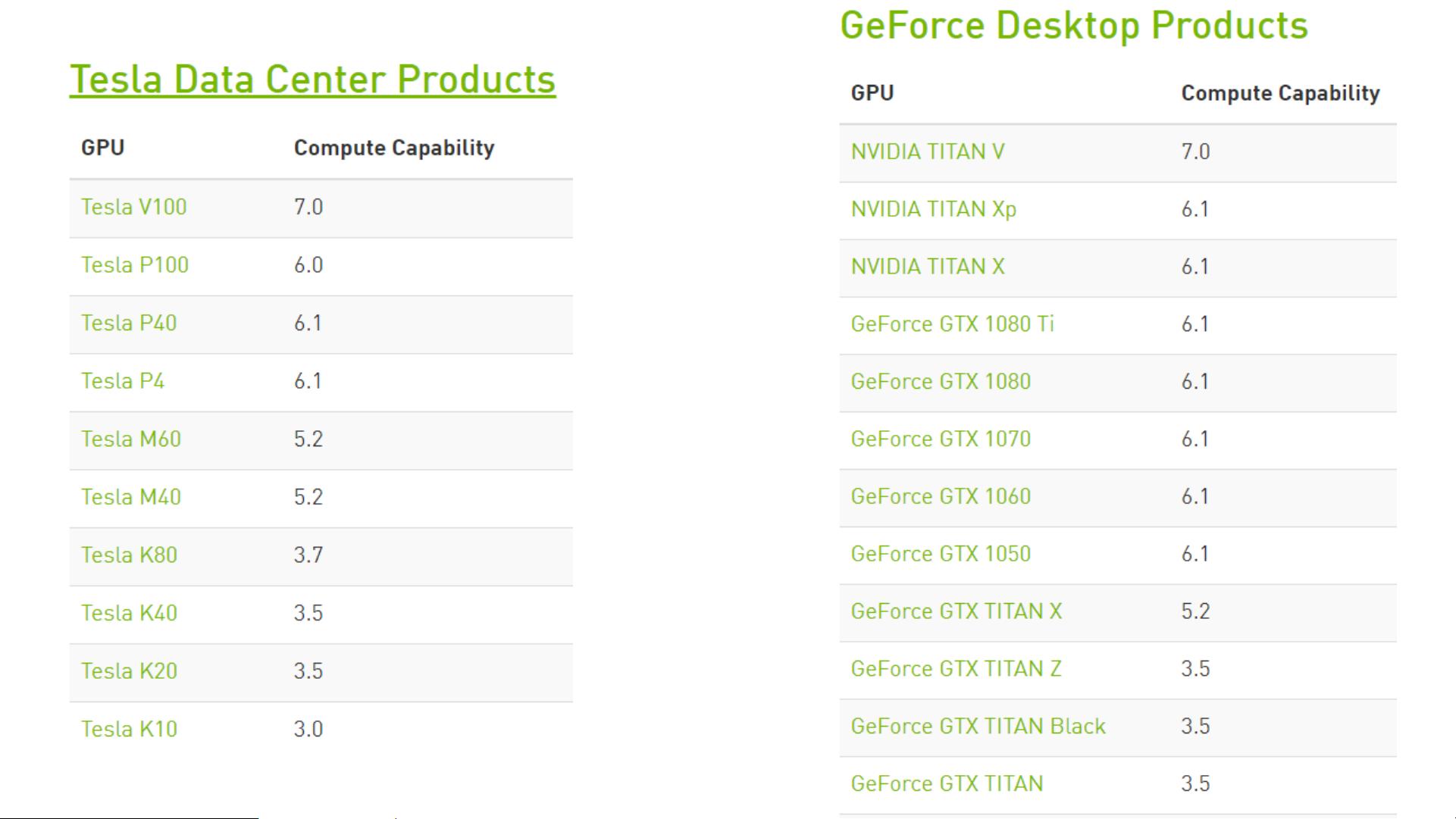

首先,GPU在深度学习中扮演着核心角色,因为它们能加速神经网络的训练过程。NVIDIA的GPU是当前最常用的硬件平台,尤其是对于大规模的深度学习任务。在选择GPU时,需要考虑的因素包括计算能力、内存大小、功耗和价格。例如,NVIDIA的Tesla系列、Quadro系列或GeForce RTX系列都是针对不同需求的优秀选择。

在【描述】中提到,深度学习模型的训练、训练样本的管理和训练模型的部署是服务器的主要工作内容。这需要一个稳定且高效的软件环境来支持。推荐的操作系统是Ubuntu 16.04或18.04以及CentOS或Redhat,因为这些Linux发行版对NVIDIA驱动和深度学习框架有良好的兼容性和支持。

软件配置方面,确保驱动版本不低于384.81,CUDA版本大于9.0。CUDA(Compute Unified Device Architecture)是NVIDIA提供的编程工具包,用于利用GPU进行并行计算。对于深度学习,CUDA是必不可少的,因为它提供了与GPU交互的底层接口。

CuDNN(CUDA Deep Neural Network)是NVIDIA的深度学习库,用于加速深度神经网络的训练和推理。版本7.04、7.05或7.12是推荐的。TensorRT是一个高性能的推理优化器,可以将训练好的模型转换为高效的运行时引擎,适合4.0 GA版本。cuDNN和TensorRT共同作用,能够最大化GPU的性能。

此外,深度学习框架如Caffe、TensorFlow(1.7、1.8或1.9版本)、PyTorch和MxNet也是必要的。这些框架简化了模型构建、训练和部署的过程。例如,TensorFlow是一个强大的开源库,支持多种深度学习模型,并提供了丰富的社区资源和工具。

对于深度学习系统的管理,可以使用NVIDIA的DIGITS(Deep Learning GPU Training System),它是一个直观的Web界面,便于数据预处理、模型训练和可视化。

在安装CUDA的过程中,按照给出的步骤操作:下载deb安装包,使用dpkg命令安装,更新apt源,然后安装CUDA。安装完成后,需编辑.bashrc文件,添加CUDA的路径到系统路径和库路径中。

构建一个GPU人工智能服务器涉及多方面的技术和工具,包括正确选择和配置GPU,安装和设置软件环境,以及选择合适的深度学习框架。这个过程需要对计算机硬件、操作系统、编程语言和深度学习有深入的理解。遵循上述指南,你可以创建一个高效运行深度学习任务的服务器。

2024-07-20 上传

2024-07-24 上传

2024-07-23 上传

2021-12-20 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

2024-11-05 上传

点击了解资源详情

898009427

- 粉丝: 2

- 资源: 3

最新资源

- 基于Python和Opencv的车牌识别系统实现

- 我的代码小部件库:统计、MySQL操作与树结构功能

- React初学者入门指南:快速构建并部署你的第一个应用

- Oddish:夜潜CSGO皮肤,智能爬虫技术解析

- 利用REST HaProxy实现haproxy.cfg配置的HTTP接口化

- LeetCode用例构造实践:CMake和GoogleTest的应用

- 快速搭建vulhub靶场:简化docker-compose与vulhub-master下载

- 天秤座术语表:glossariolibras项目安装与使用指南

- 从Vercel到Firebase的全栈Amazon克隆项目指南

- ANU PK大楼Studio 1的3D声效和Ambisonic技术体验

- C#实现的鼠标事件功能演示

- 掌握DP-10:LeetCode超级掉蛋与爆破气球

- C与SDL开发的游戏如何编译至WebAssembly平台

- CastorDOC开源应用程序:文档管理功能与Alfresco集成

- LeetCode用例构造与计算机科学基础:数据结构与设计模式

- 通过travis-nightly-builder实现自动化API与Rake任务构建