图

1.

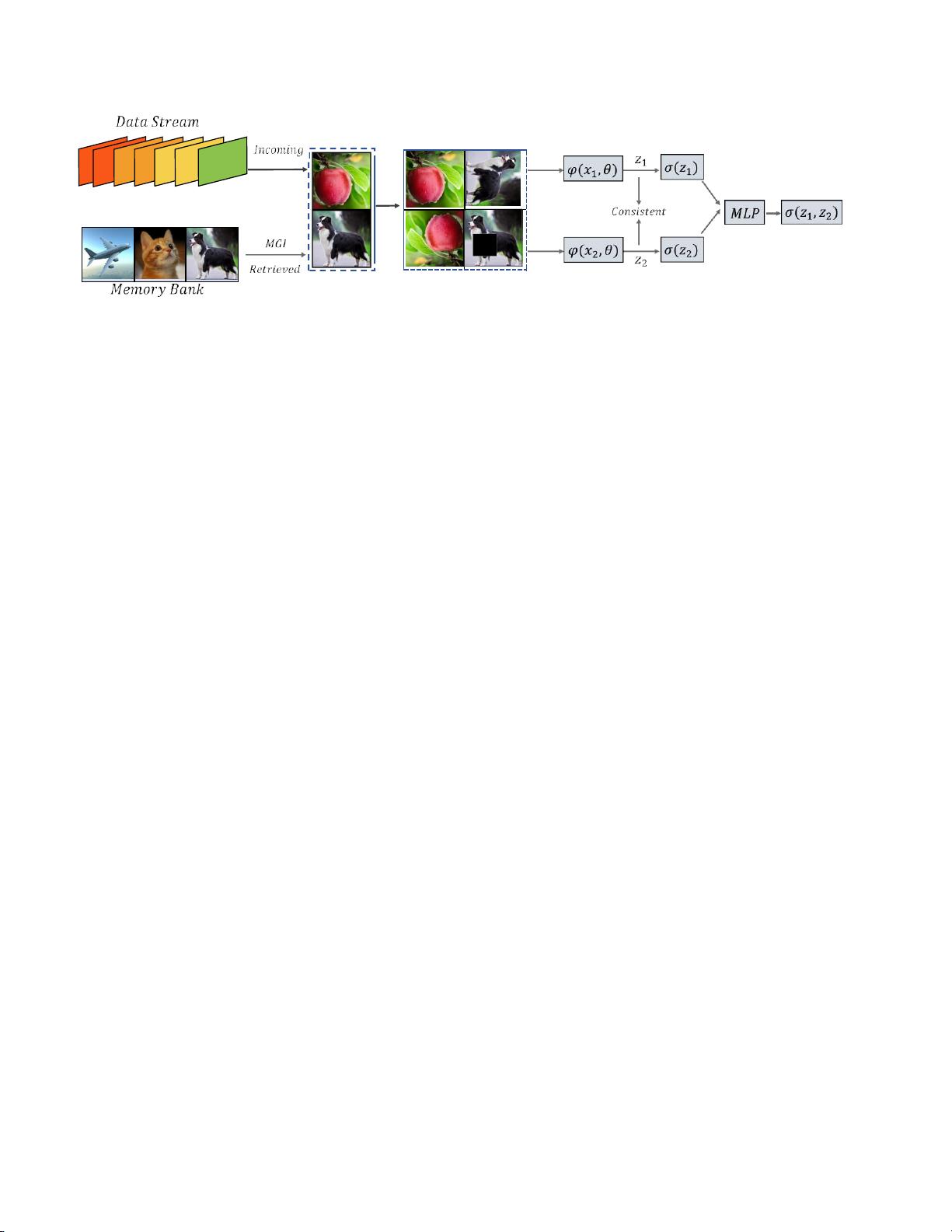

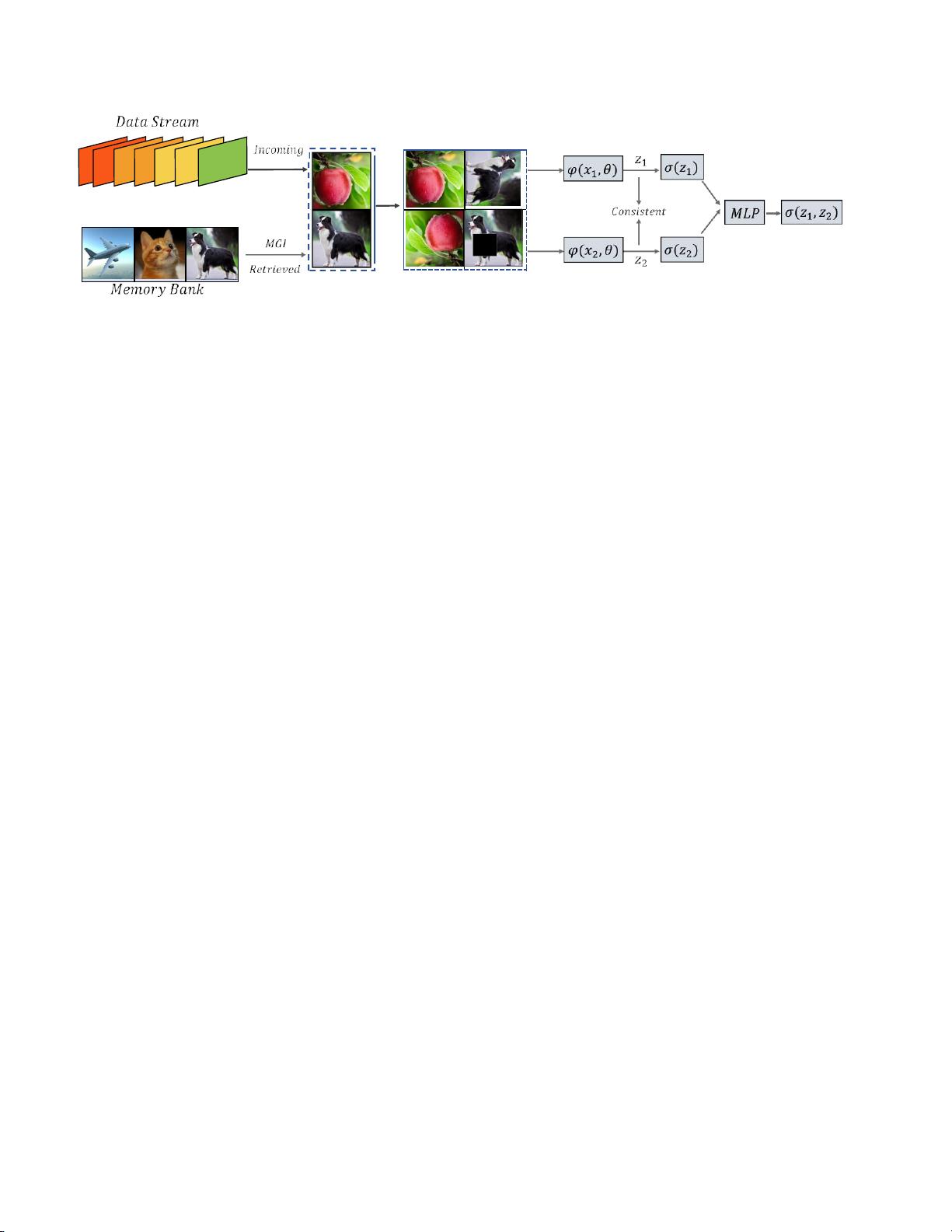

这就是我们方法的流程。在时间t,模型接收来自数据流的一批传入图像。 然后使用

MGI

检索策略从存储体中选择一些样

本进行重放。传入和检索的图像被组合以形成训练批次。最后,将训练批次的图像转换为具有不同视图的图像对,并发送到同

一个

网络,以最大限度地提高其表示的一致性。<$(x

1

,

θ)和<$(x

2

,

θ)共享相同的参数θ。

各种领域并显示出有希望的结果,包括计算机视觉

[10,20],自然语言处理[15,18],

图[22,40]和多模态数据[6,46]。一些关键因素有助

于对比学习在学习有用表示方面的成功,包括适当的

数据扩充、表示之间的可学习非线性变换、对比损失

和负样本的大批量。

与传统的需要大量负样本的对比学习方法不同,该

方法只需要双视角图像对(正样本)。因此,我们的

方法可以很好地工作的情况下,批量是小的,而传统

的对比学习方法的性能可能会受到影响。

3.

该方法

在这一节中,我们首先介绍了在线类增量持续学习

的问题定义,然后详细介绍了基于所提出的MGI的样

本选择策略。最后,我们提出的推导和计算过程中提

出的DVC策略。

3.1.

问题定义

根据最近的持续学习文献[2,4,5,35,45],我们

考虑了有监督的在线类增量持续学习设置,其中模型

需要从在线数据流中不断学习新类(数据流中的样本

只能看到一次)。 考虑一个数据

流

D

=

{

D

,

D

,

. -

是的

-

是的 ,

D

}

在

X

×

Y

上

。

X

表示

此外,我们采用单头评估设置

[11]

,其中任务标

识在

训练和测试阶段都不可用。因此,分类器必须

在

所有标签中进行选择。任务

t

的目标是训练可以对属

于

D

t

的类进行分类的模型

,同时仍然具有对属于

D

i

,

i

<

t

的类

进行分类的能力

。

3.2.

最大梯度干扰检索

在在线类增量持续学习中,基于重放的方法通过将

来自过去任务的样本的子集存储在记忆库中来减轻灾

难性遗忘。对于每一批传入的图像,基于重放的方法

从存储体中检索另一小批图像。然后,这些方法使用

传入和检索到的图像来更新模型。特别是,传入的一

批图像只能用于训练模型一次,这意味着检索旧类图

像的次数是有限的。因此,从存储器组检索样本的每

个机会对于维持旧类的性能是重要在本文中,我们选

择了存储的样本,其在网络中产生的梯度最受新传入

样本的干扰。我们相信这样的样本对于基于反向梯度

传播来更新神经网络是有益的

在训练过程中,模型在时间t接收大小

为

n的小批量

B

t

。 我们使用B

t

的样本x

t

来执行当前模型

F

(

θ

),虚拟更新模型表示为

F

v

(

θ

v

)。

θ

v

=

θ

−

α

<$L

(

F

(

x

t

)

,

y

t

),其中

α

表示学习

1 2

N

其中,Y表示X的标签,N

表示

X

的

标签。

总任务数请注意,任务之间的类没有重叠,这意味

着

{

D

i

} {

D

j

}=

0

率然后,我们随机选择

S

个候选样本

x

r

,

存储器组,并计算分别由F和F

v

中的x

r

引起的梯度向量

的大小

对于

i

=

j

。

D

t

表示任务

t

的数据集。 在

在训练阶段,数据流只能被看到一次,这意味着数据

D

t

可以用于在任务t中训练网络一个epoch。

G

(

x

r

;

θ

)

=

||

θ

L

(

y

t

,

F

(

x

r

,

θ

))

||

第

1

(

1

)

条

G

(

x

r

;

θ

v

)

=

||

θ

v

L

(

y

t

,

F

v

(

xr

,

θ

v

))

||

1

、

然后我们计算梯度的变化,