本资源主要介绍了UCAS模式识别课程中的神经网络理论,特别是第6章第2讲的内容。这一部分详细讲解了人工神经网络的发展历史、网络结构以及两种基本模型和扩展模型。

1. **发展历史**:

神经网络起源于20世纪40年代的生物灵感,随着计算机科学的进步,特别是20世纪80年代,由于反向传播算法的引入,多层感知器(Multilayer Perceptron, MLP)的出现极大地推动了其发展。这一阶段,单层感知器、多层感知器和Radial Basis Function (RBF) 网络成为基础模型。

2. **基本模型**:

- **单层感知器**:是最简单的神经网络模型,只有一层输入和输出,用于进行线性分类。

- **多层感知器**:具有至少一个隐藏层,可以处理非线性问题,通过前馈和反向传播学习权重。

- **RBF网络**:基于径向基函数,用于解决函数逼近和分类问题,特别适合处理非线性映射。

3. **扩展模型**:

- **Hopfield网络**:一种无监督学习的自组织网络,用于解决联想记忆和模式识别问题。

- **Restricted Boltzmann Machine (RBM)**:深度学习中的基础模型,是一种概率图模型,常用于特征学习和深度神经网络的预训练。

- **Deep Neural Networks (DNN)**:深度学习的核心组成部分,包含多个隐藏层,能够解决复杂的问题,如图像分类和自然语言处理。

- **Convolutional Neural Networks (CNN)**:专为图像处理设计,通过卷积层捕捉空间局部特征,广泛应用于视觉识别任务。

- **Autoencoder**:无监督学习模型,用于数据降维和特征学习。

- **Recurrent Neural Networks (RNN)** 和 Long Short-Term Memory (LSTM)**:序列模型,适用于处理时间序列数据,尤其是语言建模和机器翻译。

4. **多层感知器详解**:

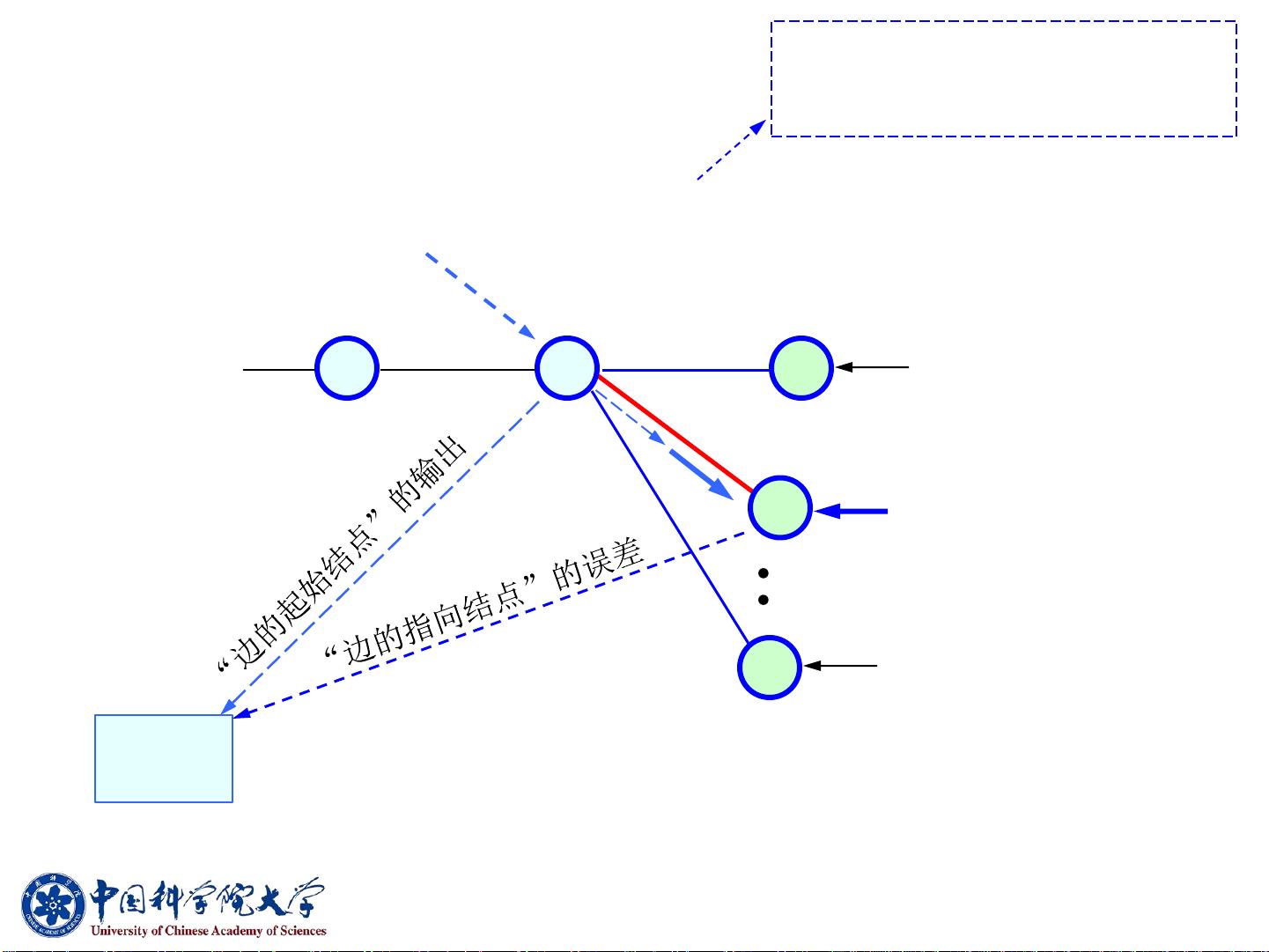

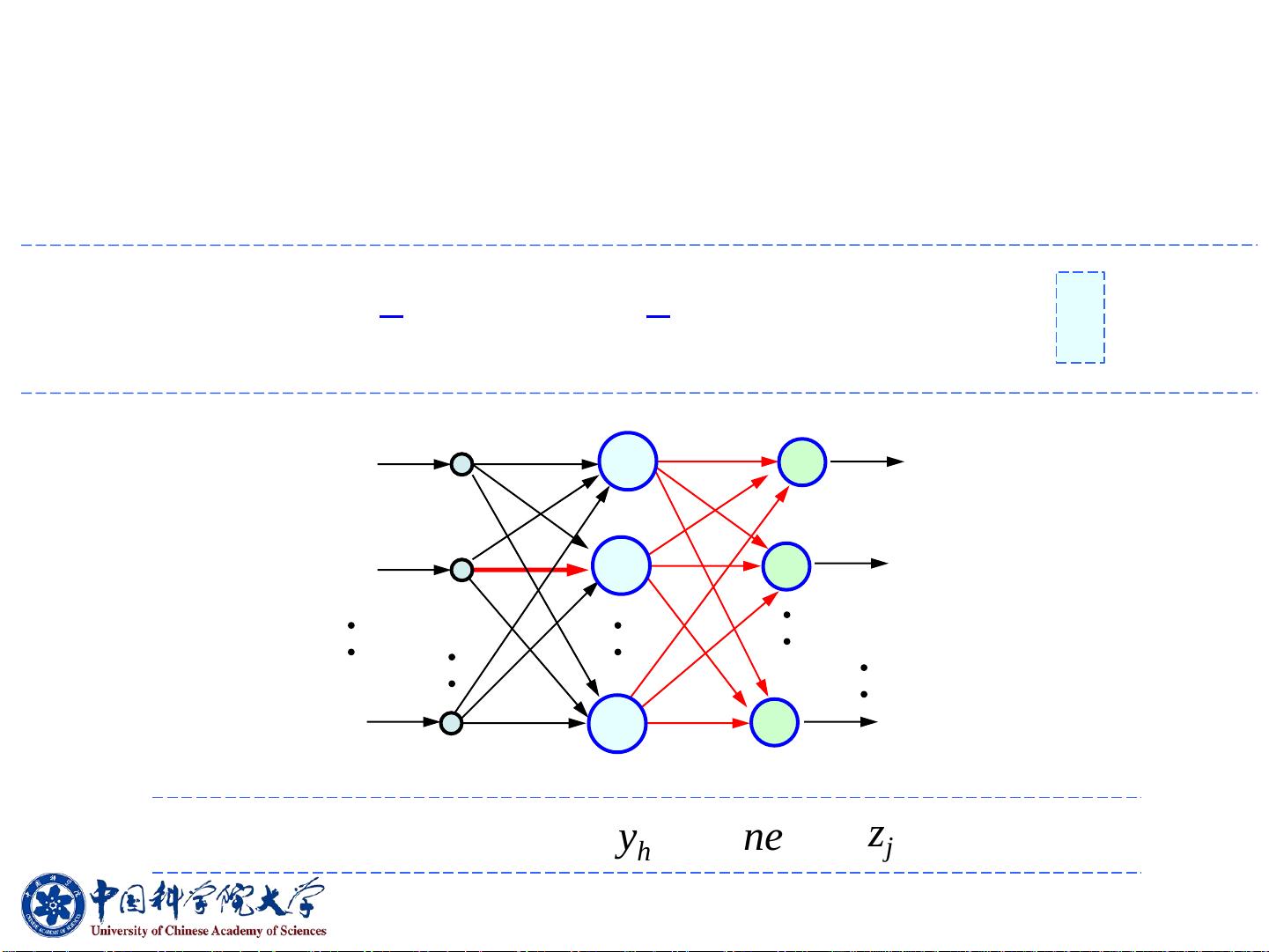

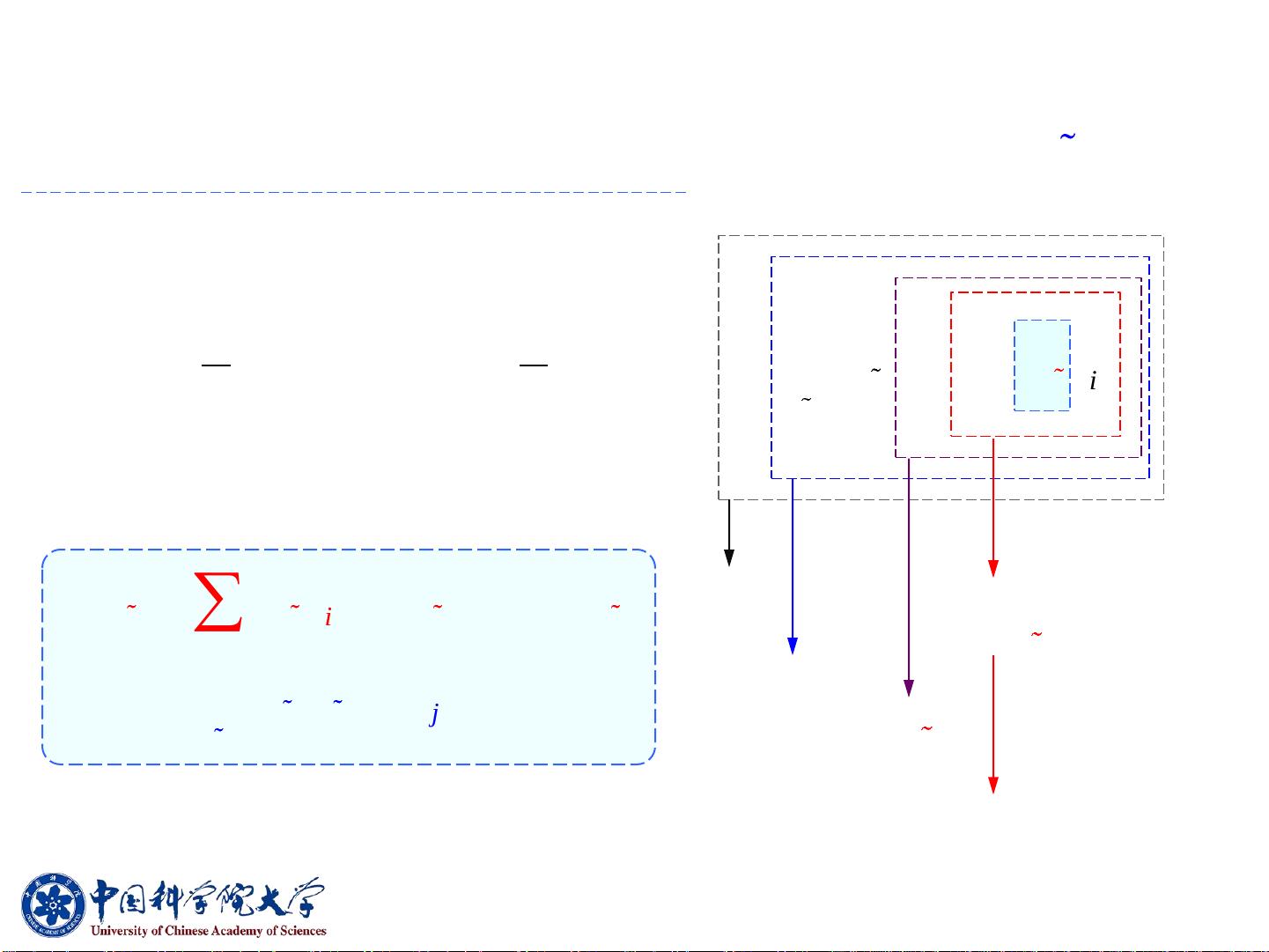

该节详细阐述了三层网络的结构,包括输入层、隐藏层和输出层。权重连接是关键,包括输入到隐藏层的权重wij和隐藏层到输出层的权重wjk。学习目标是使网络的输出zj接近于训练样本的目标值tj。网络通过输入信号xi与权重交互,经过激励函数计算节点的输出,最终输出层产生对输入的响应。

通过这些内容,学生能够深入理解神经网络的工作原理,并掌握不同类型网络在模式识别任务中的应用。这对于理解和开发现代人工智能系统至关重要。