Doherty功率放大器的逆向建模:贝叶斯正则化神经网络方法

需积分: 9 156 浏览量

更新于2024-08-26

收藏 526KB PDF 举报

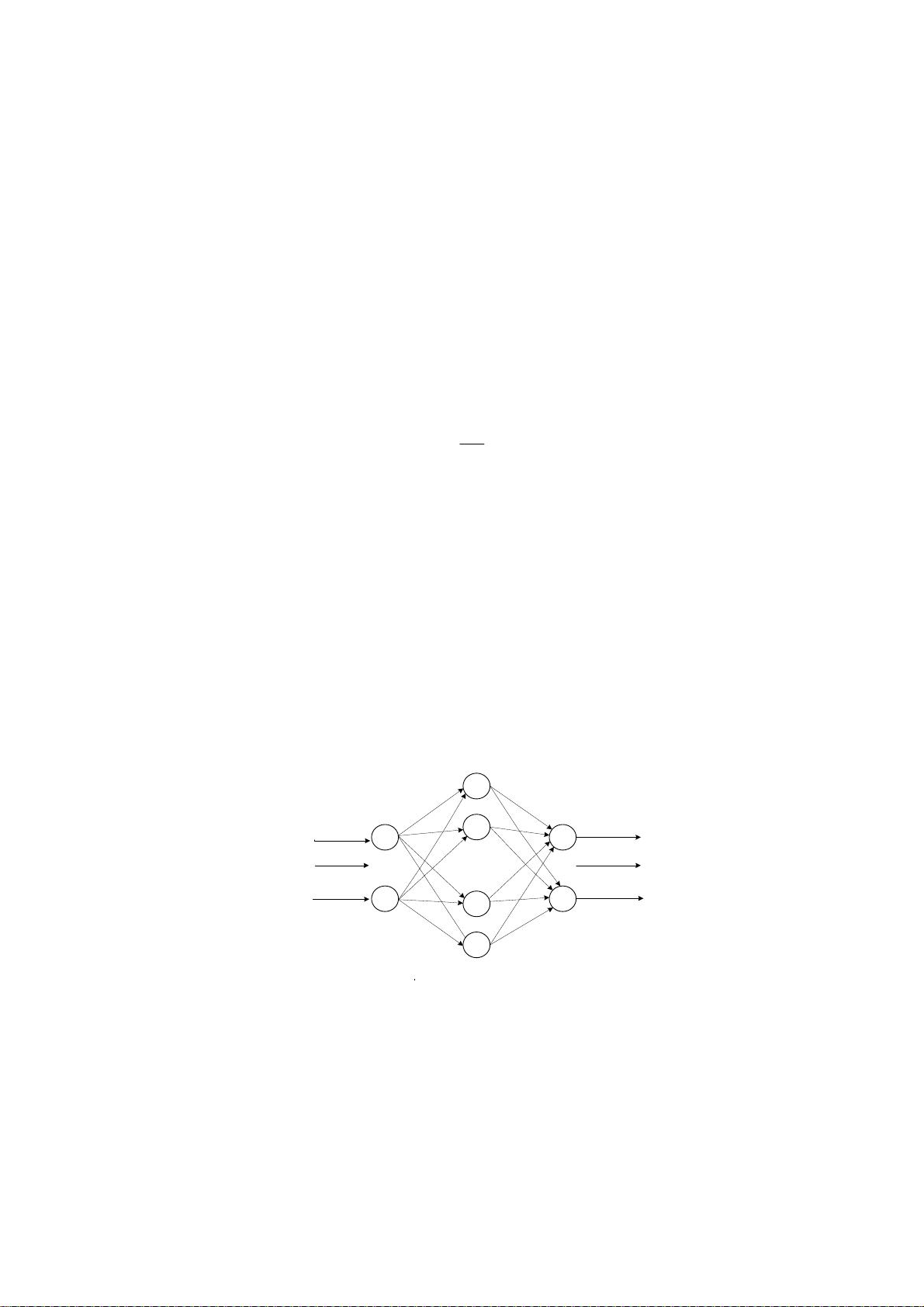

"该研究主要探讨了一种基于L1/2范数的贝叶斯正则化神经网络逆向建模方法在Doherty功率放大器设计中的应用,旨在解决传统逆向建模方法的精度和稳定性问题。通过L1/2正则化,神经网络结构变得更加稀疏,有助于减少网络规模,加速训练进程。同时,贝叶斯正则化能提升网络输出的平滑性,增强网络的稳定性和泛化性能。在已知Doherty主功放效率和输出匹配参数S11、S21的情况下,该模型能有效预测输出功率和频率f,简化设计流程。实验结果显示,相比于直接逆向建模,该方法在输出功率、与S11相关的f、与S21相关的f的均方误差上分别降低了8.83%、9.30%和9.00%,运行时间显著减少,解决了多解问题,对于射频微波器件设计具有实际应用价值。"

本文主要关注的是在Doherty功率放大器设计中的逆向建模技术。Doherty功率放大器是一种高效的功率放大器,广泛应用于射频和微波通信系统中,尤其在需要高效率和宽动态范围时。传统的逆向建模方法在预测放大器性能时可能存在精度低、稳定性差的问题,这限制了其在复杂设计中的应用。

为了解决这些问题,作者提出了一种新的逆向建模策略,即采用L1/2范数作为规则化函数的贝叶斯正则化神经网络。L1/2范数正则化引入了稀疏性,这意味着网络的权重可以被驱动至接近零,从而减小网络的复杂度,加快训练速度。此外,贝叶斯正则化通过对输出的平滑处理,提高了网络的稳定性和泛化能力,避免过拟合,使模型更适应未见过的数据。

在Doherty功率放大器的具体应用中,该模型能够在已知关键参数(如主功放效率、S参数)的情况下,准确预测出输出功率和频率f,简化了设计流程。实验对比显示,与传统的逆向建模方法相比,新方法在预测精度上有显著提升,均方误差下降,同时运行时间大幅缩短,这意味着设计效率得到了显著提高。更重要的是,该模型能够有效地解决多解问题,这是射频微波器件设计中的一个常见挑战。

该研究通过结合L1/2范数的正则化和贝叶斯方法,为Doherty功率放大器的逆向建模提供了一个高效且精确的工具,为射频微波器件的设计提供了新的思路和方法。这项工作不仅提升了逆向建模的性能,也为未来相关领域的研究奠定了基础。

2021-09-26 上传

2012-09-27 上传

2019-08-22 上传

2021-04-03 上传

2021-10-21 上传

2021-05-05 上传

weixin_38610815

- 粉丝: 4

- 资源: 870

最新资源

- 探索数据转换实验平台在设备装置中的应用

- 使用git-log-to-tikz.py将Git日志转换为TIKZ图形

- 小栗子源码2.9.3版本发布

- 使用Tinder-Hack-Client实现Tinder API交互

- Android Studio新模板:个性化Material Design导航抽屉

- React API分页模块:数据获取与页面管理

- C语言实现顺序表的动态分配方法

- 光催化分解水产氢固溶体催化剂制备技术揭秘

- VS2013环境下tinyxml库的32位与64位编译指南

- 网易云歌词情感分析系统实现与架构

- React应用展示GitHub用户详细信息及项目分析

- LayUI2.1.6帮助文档API功能详解

- 全栈开发实现的chatgpt应用可打包小程序/H5/App

- C++实现顺序表的动态内存分配技术

- Java制作水果格斗游戏:策略与随机性的结合

- 基于若依框架的后台管理系统开发实例解析