"Hadoop是一个开源的分布式计算框架,由HDFS和MapReduce组成,最初为了解决Nutch的海量数据问题。它模仿了Google的GFS、MapReduce和BigTable系统,并逐步发展成为一个广泛应用于大数据处理的生态系统。"

Hadoop是大数据处理领域的核心工具之一,它的设计目标是处理和存储海量数据,具有高容错性和可扩展性。Hadoop的名称来源于其创始人Doug Cutting的儿子的黄色大象玩具。该项目始于2005年,作为Apache Lucene的子项目Nutch的一部分,现在已经成为Apache软件基金会的重要项目。

Hadoop主要由两部分组成:

1. HDFS(Hadoop Distributed File System):分布式文件系统,它将大型数据集分布在多台机器上,提供高可用性和容错性。HDFS遵循“一次写入,多次读取”的原则,数据被复制到多个节点以确保可靠性。HDFS的设计使得即使部分节点故障,系统仍能正常运行。

2. MapReduce:这是一种编程模型,用于大规模数据集的并行处理。它将大型任务分解为许多小的“映射”任务和“化简”任务,在集群中的不同节点上并行执行。Map阶段处理输入数据, Reduce阶段则聚合结果,两者通过中间键值对进行通信。

Hadoop生态系统还包括许多其他组件,如:

- YARN(Yet Another Resource Negotiator):作为资源管理系统,负责调度和管理集群中的计算资源,提高了系统的效率和利用率。

- Hive:一个基于Hadoop的数据仓库工具,允许用户使用SQL-like查询语言(HQL)处理存储在HDFS上的数据。

- Pig:提供高级数据流语言,简化了在Hadoop上构建大数据处理管道的过程。

- HBase:一个分布式的、面向列的NoSQL数据库,提供实时读写访问,适用于需要低延迟数据检索的应用。

- ZooKeeper:协调分布式服务,维护配置信息、命名服务、组服务等。

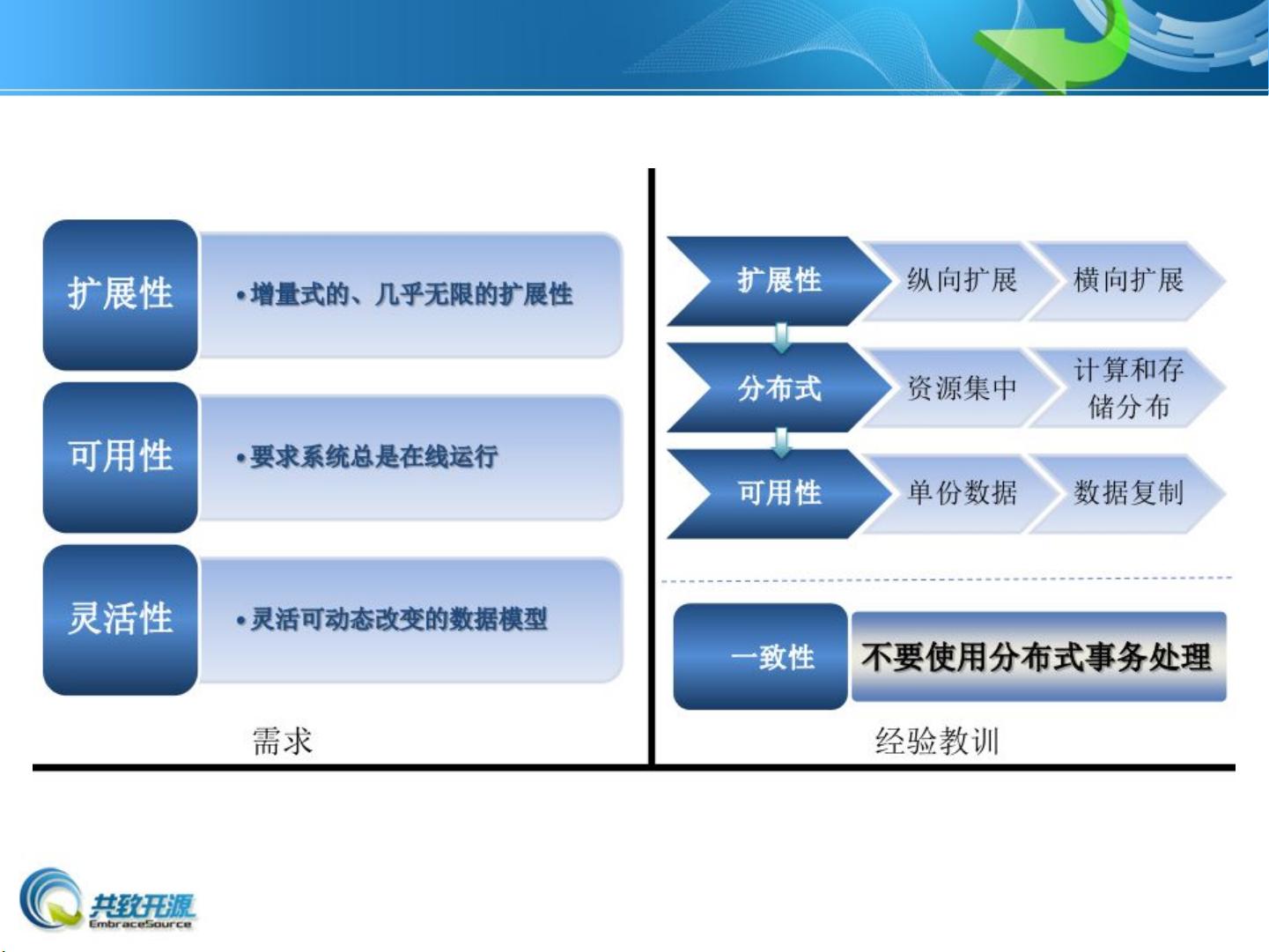

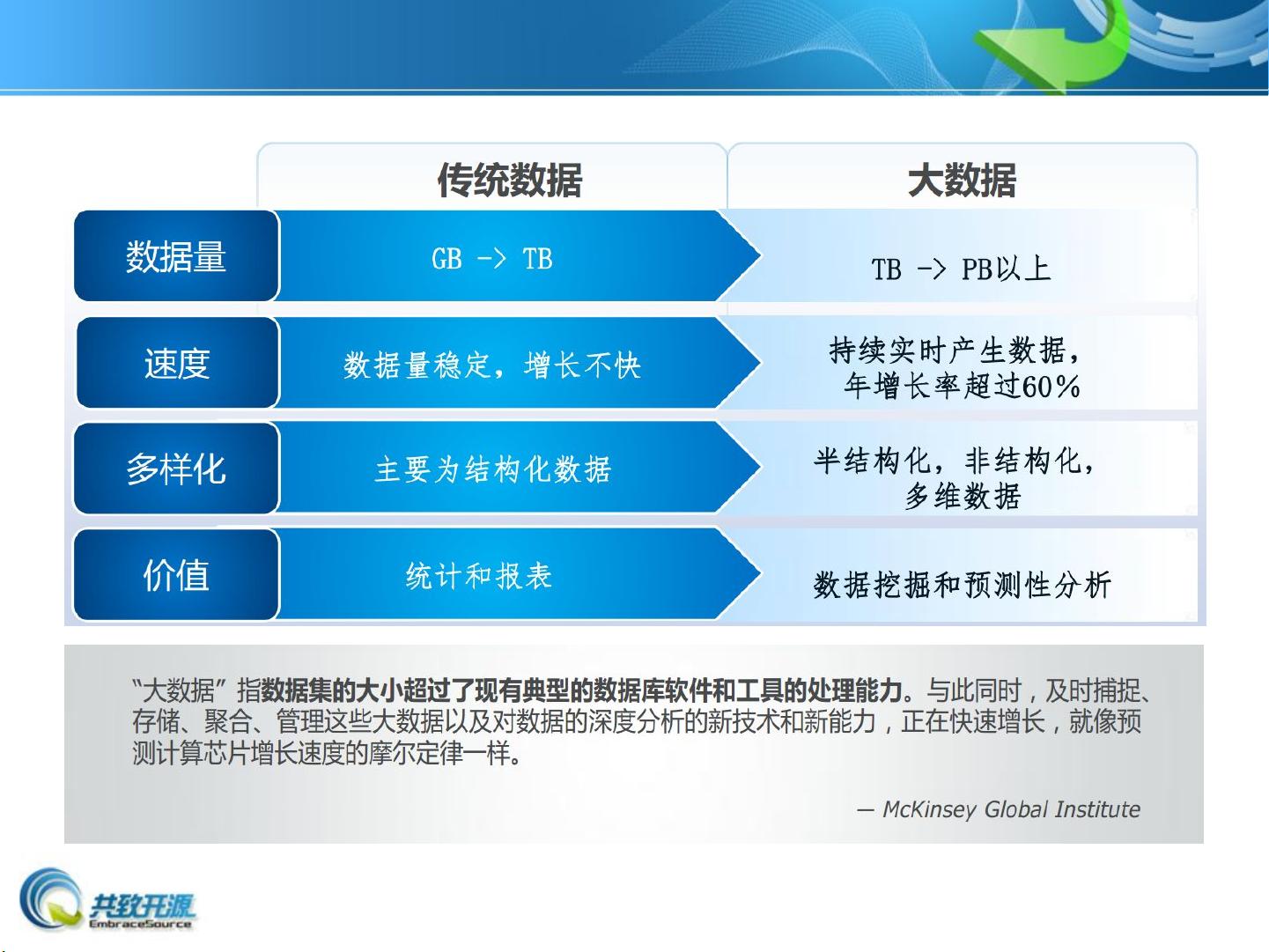

Hadoop与传统的并行关系数据库和MPP(大规模并行处理)系统相比,有其独特的优势和应用场景。在大数据处理中,Hadoop可以更好地处理非结构化和半结构化数据,支持大规模横向扩展,适应数据量快速增长的环境。然而,对于需要强一致性保证和实时事务处理的应用,传统的数据库系统可能更适合。

总结来说,Hadoop是一个强大的大数据处理平台,其核心组件HDFS和MapReduce为大数据的存储和处理提供了坚实的基础。随着Hadoop生态系统的不断发展和完善,越来越多的企业和组织正在利用Hadoop解决复杂的数据挑战,挖掘隐藏在海量数据中的价值。