深度学习:生成对抗网络(GAN)原理与应用解析

需积分: 0 187 浏览量

更新于2024-06-30

2

收藏 5.08MB PDF 举报

"本章介绍了生成对抗网络(GAN)的基本概念、评估方法、其他生成式模型、改进与优化以及各种应用场景。"

生成对抗网络(GAN)是深度学习领域的一个重要分支,由Ian Goodfellow等人在2014年提出。GAN的核心思想是通过两个神经网络,即生成器(Generator)和判别器(Discriminator),进行博弈来学习数据的分布。生成器试图生成逼真的样本,而判别器则尝试区分真实样本和生成器产生的假样本。在这个过程中,两者相互提升,直到判别器无法区分真伪,生成器就能生成接近真实的数据。

7.1.1 如何通俗理解GAN?GAN可以比喻为一个艺术家(生成器)和一个批评家(判别器)的互动过程。艺术家不断尝试画出更像真品的作品,而批评家则不断提高鉴赏能力,鉴别真假。随着双方技能的提升,艺术家最终能创作出几乎以假乱真的作品。

7.1.2 GAN的形式化表达与目标函数:GAN的训练过程可以表示为两个玩家的零和游戏,生成器G试图最大化判别器D对假样本的误判概率,而判别器D则试图最小化误判的概率。目标函数可以写作:\( \min_G \max_D V(D,G) \),其中\( V(D,G) \)是两个网络之间的博弈值。

7.1.4 GAN的目标函数与交叉熵的区别:交叉熵常用于分类任务,衡量预测概率分布与真实标签之间的差异;而GAN的目标函数是针对生成模型的,它不是直接比较生成样本与真实样本的相似性,而是通过两个网络的博弈来间接优化生成器。

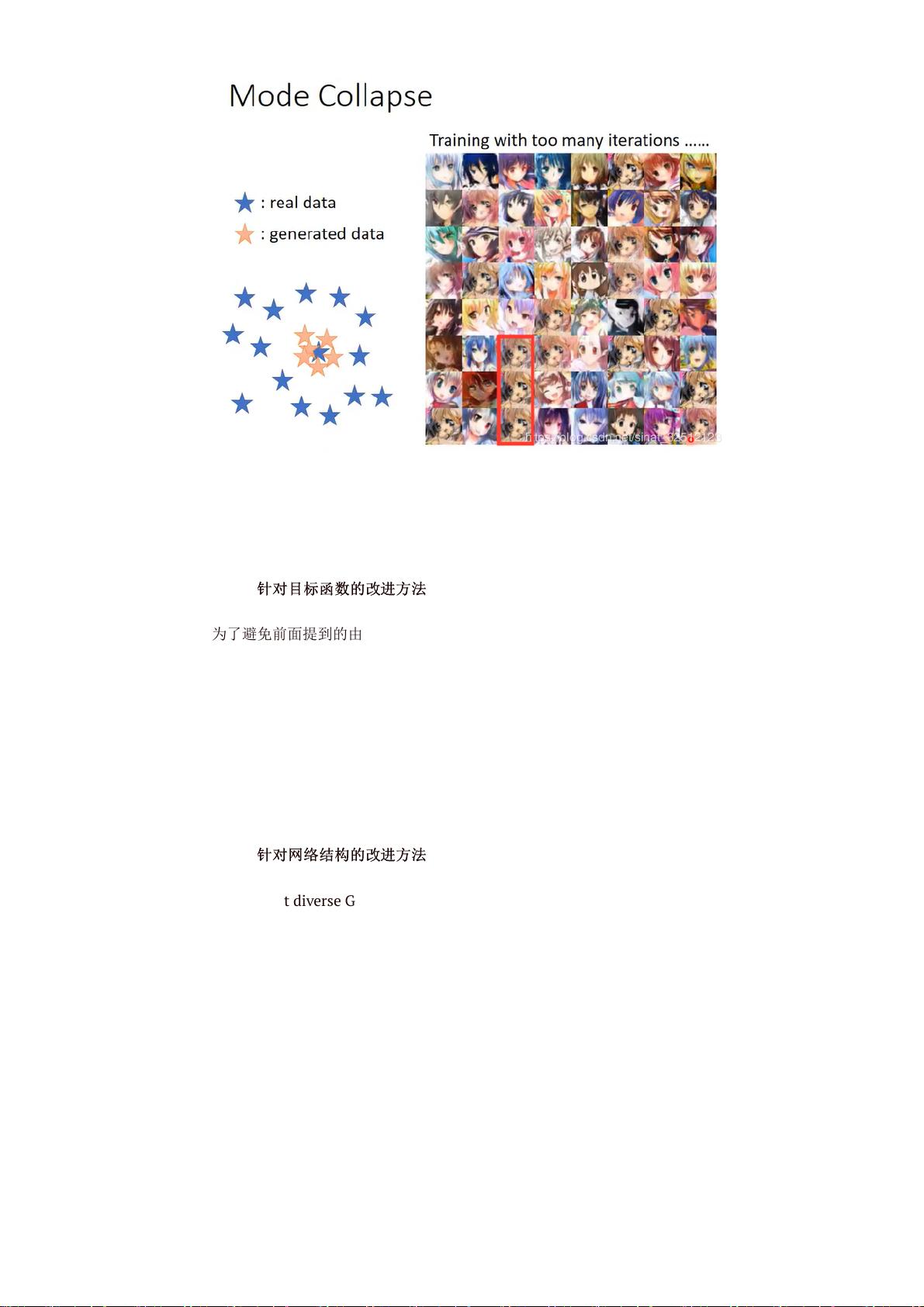

7.1.5 GAN的Loss降不下去的原因:这可能由于模式塌缩(mode collapsing)、梯度消失或爆炸、训练不稳定等问题导致。模式塌缩是指生成器只学会了生成有限种类的样本,导致多样性丢失。

7.1.7 mode collapsing:指的是生成器在学习过程中只学会了生成部分训练数据的样本,导致生成样本的多样性不足。

7.1.8 解决mode collapsing的方法:可以采用多种策略,如使用不同的损失函数(如LSGAN、WGAN)、设计复杂的网络结构(如DCGAN)、引入额外的约束(如CycleGAN)等。

7.2 GAN的生成能力评价:InceptionScore、ModeScore、KernelMMD、Wasserstein距离、Fréchet Inception Distance (FID)和1-Nearest Neighbor classifier等指标用于量化生成样本的质量和多样性。

7.3 其他生成式模型:自回归模型(如pixelRNN、pixelCNN)和变分自编码器(VAE)是两种常见的替代模型,它们各自有不同的优点和适用场景。

7.4 GAN的改进与优化:条件GAN允许生成指定条件的样本,DCGAN用卷积神经网络改进了GAN的稳定性,WGAN和WGAN-GP通过正则化解决了训练崩溃问题,LSGAN则通过最小二乘损失提升了训练稳定性。

7.5 GAN的应用:包括图像翻译(如pix2pix、CycleGAN、StarGAN)、文本生成(如seqGAN)、数据增强、图像超分辨和图像补全、语音领域等,展示了GAN在多个领域的广泛应用潜力。

总结,生成对抗网络是深度学习中的强大工具,其核心在于通过对抗学习实现高质量数据生成,但同时也面临着训练稳定性、模式塌缩等挑战。通过不断的研究和优化,GAN已经在图像生成、文本生成等多个领域取得了显著进展。

2022-08-03 上传

2022-08-03 上传

2023-08-23 上传

2021-04-29 上传

2021-11-16 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

ShenPlanck

- 粉丝: 951

- 资源: 343

最新资源

- JavaScript实现的高效pomodoro时钟教程

- CMake 3.25.3版本发布:程序员必备构建工具

- 直流无刷电机控制技术项目源码集合

- Ak Kamal电子安全客户端加载器-CRX插件介绍

- 揭露流氓软件:月息背后的秘密

- 京东自动抢购茅台脚本指南:如何设置eid与fp参数

- 动态格式化Matlab轴刻度标签 - ticklabelformat实用教程

- DSTUHack2021后端接口与Go语言实现解析

- CMake 3.25.2版本Linux软件包发布

- Node.js网络数据抓取技术深入解析

- QRSorteios-crx扩展:优化税务文件扫描流程

- 掌握JavaScript中的算法技巧

- Rails+React打造MF员工租房解决方案

- Utsanjan:自学成才的UI/UX设计师与技术博客作者

- CMake 3.25.2版本发布,支持Windows x86_64架构

- AR_RENTAL平台:HTML技术在增强现实领域的应用