CUDA编程指南4.0:通用并行计算入门

需积分: 41 105 浏览量

更新于2024-07-26

收藏 2.16MB PDF 举报

"CUDA 编程指南4.0中文版,由风辰翻译,详细介绍了CUDA的体系结构、编程方法和编程接口,包括内核、线程层次、存储器层次、异构编程、计算能力等内容,并深入讲解了nvcc编译、CUDAC运行时的诸多细节,如初始化、设备存储器、共享存储器、异步并发执行、多设备系统等。"

CUDA(Compute Unified Device Architecture)是一种由NVIDIA推出的并行计算平台和编程模型,主要用于利用GPU进行高性能计算。CUDA提供了一种方法,让开发者能够利用图形处理器的强大计算能力来解决复杂的计算问题,不仅限于图形处理,而是扩展到了通用并行计算领域。

本指南的章节结构如下:

1. **第一章导论**:

- 介绍CUDA从图形处理向通用并行计算的转变,阐述CUDA作为通用并行计算架构的特点和优势。

- 解释CUDA的可扩展编程模型,允许开发者设计高效的并行算法。

2. **第二章编程模型**:

- **内核(Kernels)**:CUDA程序的核心部分,是运行在GPU上的函数,可以并行执行。

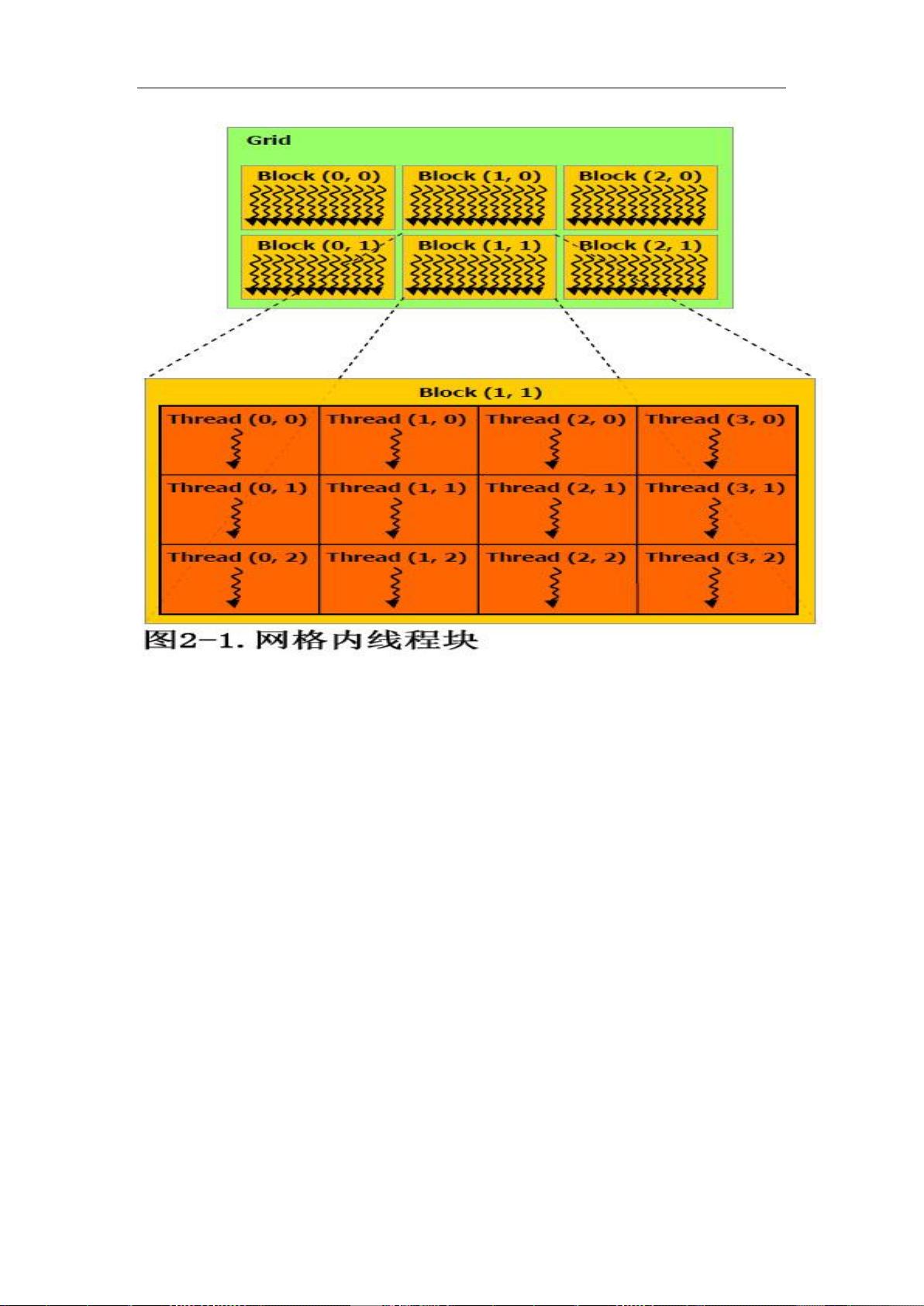

- **线程层次**:包括线程块(Thread Blocks)、网格(Grids),以及更细粒度的线程(Threads),构成了并行执行的基本单位。

- **存储器层次**:包括全局内存、共享内存、寄存器和常量内存,开发者需要根据需求选择合适的存储类型。

- **异构编程**:CUDA允许同时使用CPU和GPU,优化计算任务的执行效率。

- **计算能力**:衡量GPU执行CUDA程序的能力,包括浮点运算速度等指标。

3. **第三章编程接口**:

- **nvcc编译**:CUDA的编译工具,涉及离线编译、即时编译、二进制兼容性和其他兼容性问题。

- **CUDAC运行时**:详细讲解了CUDA运行时库的使用,包括初始化、设备存储器管理(如分配、释放)、共享存储器的使用、分页锁定主机存储器的交互(如可分享存储器、写结合存储器、被映射存储器),以及异步并发执行的各种机制,如流(Streams)、事件(Events)、同步调用等。

- **多设备系统**:涵盖了在拥有多个GPU的系统中如何管理和协调设备,包括设备枚举、选择、P2P内存访问和复制,以及统一虚拟地址空间的使用。

- **错误检查**、**调用栈**、**纹理和表面存储器**:提供了优化数据访问的方法,如纹理内存和表面存储器的使用,以及CUDA数组和读写一致性的概念。

- **图形学互操作性**:讨论了CUDA与OpenGL的集成,使得在图形渲染和计算之间无缝切换成为可能。

CUDA编程涉及的概念和技术广泛且深入,本指南旨在为开发者提供全面的指导,帮助他们理解和利用CUDA进行高效并行计算。通过学习和实践,开发者能够充分发挥GPU的并行计算潜力,解决各种计算密集型问题。

522 浏览量

点击了解资源详情

点击了解资源详情

点击了解资源详情

128 浏览量

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

zhujf553

- 粉丝: 0

- 资源: 3