掌握卷积神经网络基础:LeNet与参数调整

187 浏览量

更新于2024-08-30

收藏 1.2MB PDF 举报

卷积神经网络基础是深度学习领域中的关键组成部分,尤其在计算机视觉任务中发挥着重要作用。本篇教程着重介绍了LeNet(LeNet-5),一个早期广泛应用的卷积神经网络模型,它在手写数字识别等任务中取得了显著成果。在深入理解卷积神经网络时,我们首先要掌握二维卷积层,这是构建网络的基础。

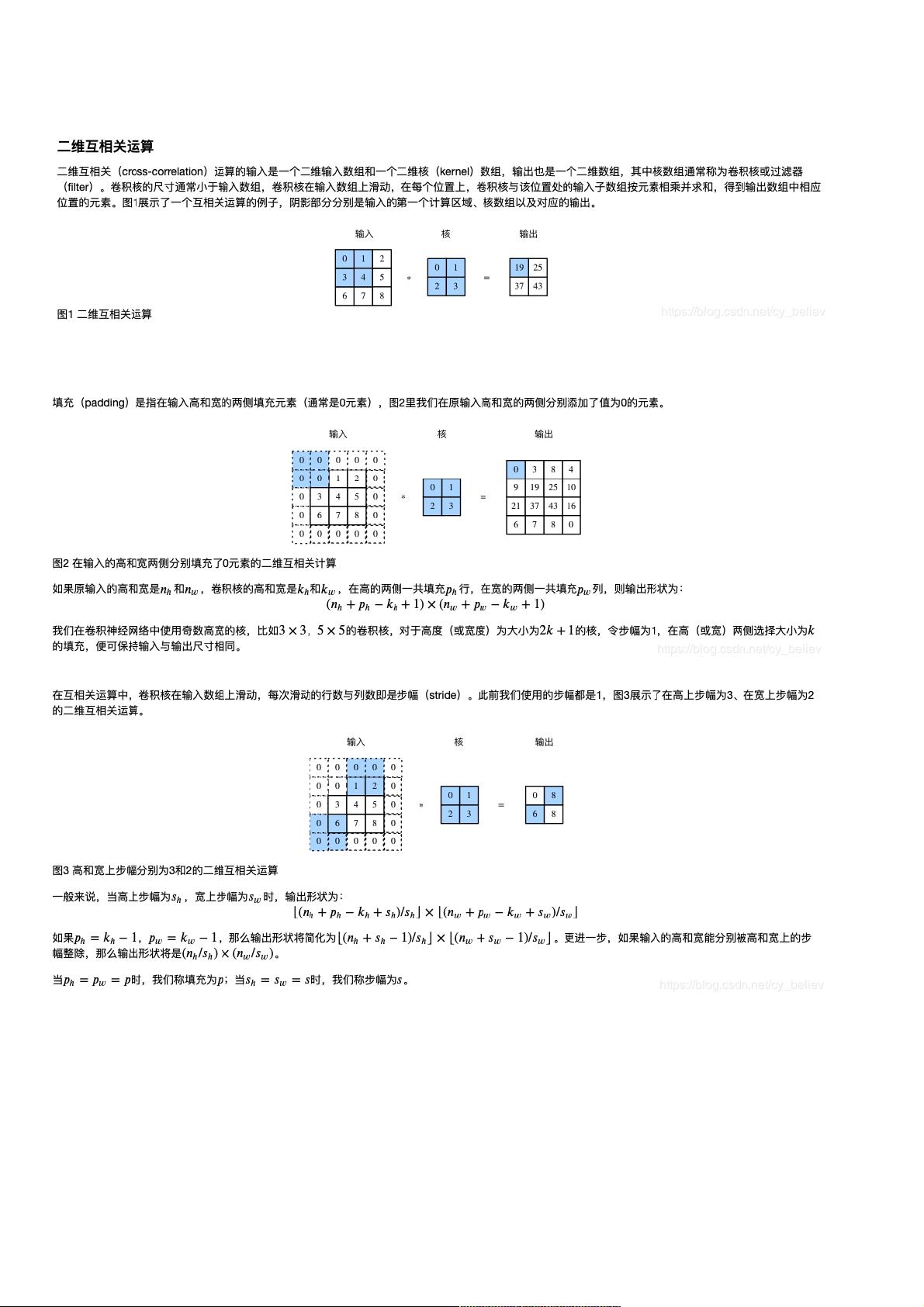

**二维卷积层**:卷积层是CNN的核心,它通过滑动一个小的、可学习的滤波器(或称卷积核)在输入数据上进行局部特征提取。滤波器会在每个位置进行内积运算,并通过激活函数(如ReLU)引入非线性,增强模型表达能力。这里的`nn.Conv2d`函数定义了卷积层的基本结构,包括输入通道数(in_channels)、输出通道数(out_channels)、卷积核大小(kernel_size)、步幅(stride)以及填充(padding)。步幅决定每次移动滤波器时,输出特征图在高度和宽度上的变化,而填充则用于保持输出尺寸不变,通过在输入边界添加额外的零元素。

**填充(Padding)**:填充是在输入边缘添加额外的值,这会影响卷积核在输入上的覆盖范围,从而控制输出特征图的尺寸。填充值通常是0,如代码所示的`(1, 2)`意味着在宽度方向上添加1,高度方向上添加2。总计算公式中,如果没有指定填充,输出尺寸会因为减去步幅后的计算而缩小。然而,当加上填充时,输出尺寸会保持不变或者根据具体数值增大。理解何时加1的关键在于理解公式,当滤波器的边缘部分不会被输入边界“切掉”时,应进行加1的操作。

**多输入通道和多输出通道**:在实际应用中,一张图像可能有多个通道(如RGB图像有红绿蓝三个通道),`nn.Conv2d`中的`in_channels`指明了输入通道数,`out_channels`则表示输出通道数,每个通道对应一组不同的滤波器。多输出通道允许网络同时提取不同类型或层次的特征。

**LeNet示例**:LeNet是一种经典的卷积网络结构,它巧妙地结合了卷积层和池化层,解决了全连接层在处理高维输入时的问题。例如,LeNet包含卷积层、最大池化层、全连接层,以及最终的分类层。全连接层的局限性在于距离遥远的像素信息在向量中丢失了空间关系,而卷积层通过局部感受野解决了这一问题。

**池化层**:`nn.MaxPool2d`用于下采样,减少特征图的尺寸,降低计算复杂度。代码展示了使用3x3大小的池化窗口,填充1,步幅为(2,1)的操作,可以看到输入数据经过池化后尺寸的变化。

**实践代码**:教程中提供了代码实例,包括创建`Conv2d`对象、进行卷积操作、展平和重塑操作,以及使用LeNet的简单结构。这些代码演示了如何在实际项目中应用卷积神经网络。

总结来说,本资源是关于卷积神经网络基础的重要教程,讲解了二维卷积层、填充、步幅的概念及其在LeNet中的运用,强调了这些概念在构建和优化神经网络模型中的作用。通过理解并掌握这些核心概念,读者能够更好地设计和训练自己的卷积神经网络模型,应对各种计算机视觉任务。

275 浏览量

159 浏览量

264 浏览量

641 浏览量

181 浏览量

160 浏览量

264 浏览量

275 浏览量

103 浏览量

weixin_38699352

- 粉丝: 8

- 资源: 920

最新资源

- Linear Algebra

- Red5 部署Tomcat

- c语言高级教程C语言进阶

- (ebook - English) Advanced Linux Programming

- 基于VRML的虚拟工厂场景构建技术研究

- JavaScript 高级程序设计[精华].pdf

- 嵌入式C/C++语言精华文章集锦

- 软件工程思想视野独特,构思新颖,内容风趣

- AppDirector配置手册.doc

- EJB3 中文帮助文档

- 电力通信网综合监控系统在沧东电厂的应用及展望.pdf

- .NET开发技巧大串烧

- iceman_linux教程

- Oracle 11g 2 Day DBA

- AIX_5L系统操作手册

- 学习Java的30个基本概念