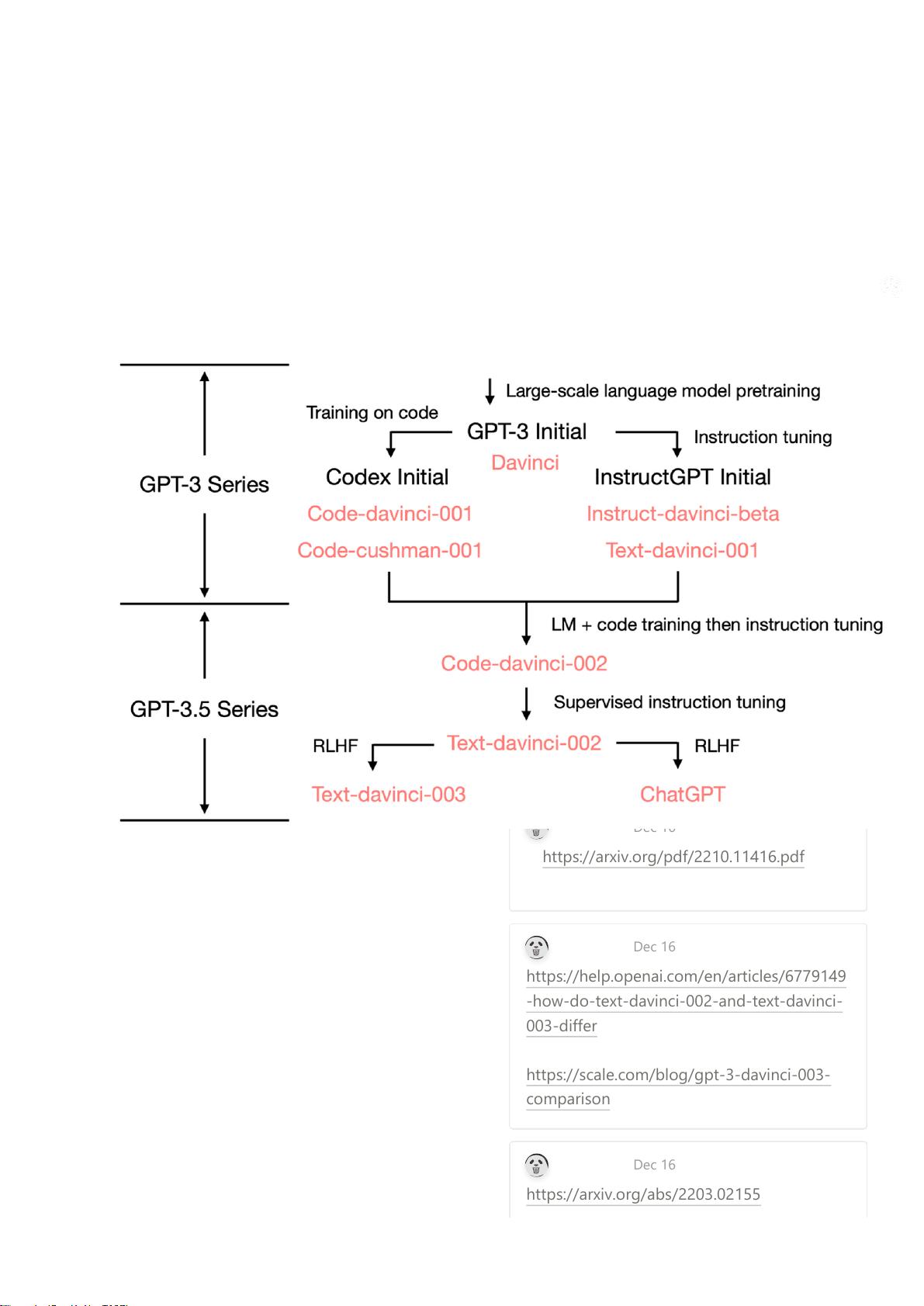

《拆解追溯 GPT-3.5 各项能力的起源》是一篇深度研究文章,由作者Yao Fu、Hao Peng和Tushar Khot合作撰写,主要探讨了大型语言模型GPT-3.5的各项能力并非孤立发展,而是源自其背后的训练数据、架构设计以及算法优化。该报告通过详细的分析,揭示了这些能力如何从基础原理逐渐涌现,尤其是在模型规模增长和数据集的丰富性方面对其性能提升的影响。 文章首先定义了"突现能力"(Emergent Abilities),即当模型尺寸达到一定程度时才会显现出来的高级功能,这表明了模型能力并非线性增加,而是通过复杂的学习过程在大量数据交互中逐渐形成。作者关注的核心问题是:GPT-3.5是如何从基础的语言模型训练中习得理解和生成复杂文本、进行推理、甚至展现出某些人类认知相似性的能力。 报告通过实例和实验,深入研究了以下几个关键点: 1. 训练数据的作用:GPT-3.5的能力很大程度上依赖于OpenAI在其训练过程中所使用的海量文本数据,包括互联网上的各种来源,这些数据提供了丰富的语言范例,使模型能够学习到广泛的语境和模式。 2. Transformer架构的影响:基于Transformer的架构使得模型能够处理序列数据,并通过自注意力机制实现跨上下文的理解和生成,这是GPT-3.5能够生成连贯且有逻辑内容的关键。 3. 预训练与微调:GPT-3.5在大规模无监督预训练阶段获取了广泛的基础知识,随后的微调则针对特定任务进行了针对性的调整,进一步增强了其在特定领域的表现。 4. 多模态学习:尽管GPT-3.5主要是基于文本数据,但研究还可能涉及了模型对图像和其他形式数据的隐性理解,这是通过将文本和其他信息融合来增强其综合能力的表现。 5. 模型规模效应:随着模型参数数量的增加,GPT-3.5能够处理更复杂的语言结构,从而表现出更多的高级功能,如生成连贯故事、解答问题等。 6. 模型的可解释性和潜在风险:研究者还探讨了如何理解和评估模型决策的内在逻辑,以及在避免潜在偏见和误导方面所面临的挑战。 通过这份报告,读者可以深入了解GPT-3.5背后的技术细节,以及理解这些技术进步如何塑造了我们今天看到的人工智能能力。同时,它也提醒我们在享受技术带来的便利时,要关注其背后的数据伦理和模型透明度问题。

剩余56页未读,继续阅读

信息提交成功

信息提交成功