生成性压缩:深度学习驱动的优雅降级压缩新方法

需积分: 1 60 浏览量

更新于2024-09-09

收藏 1.47MB DOCX 举报

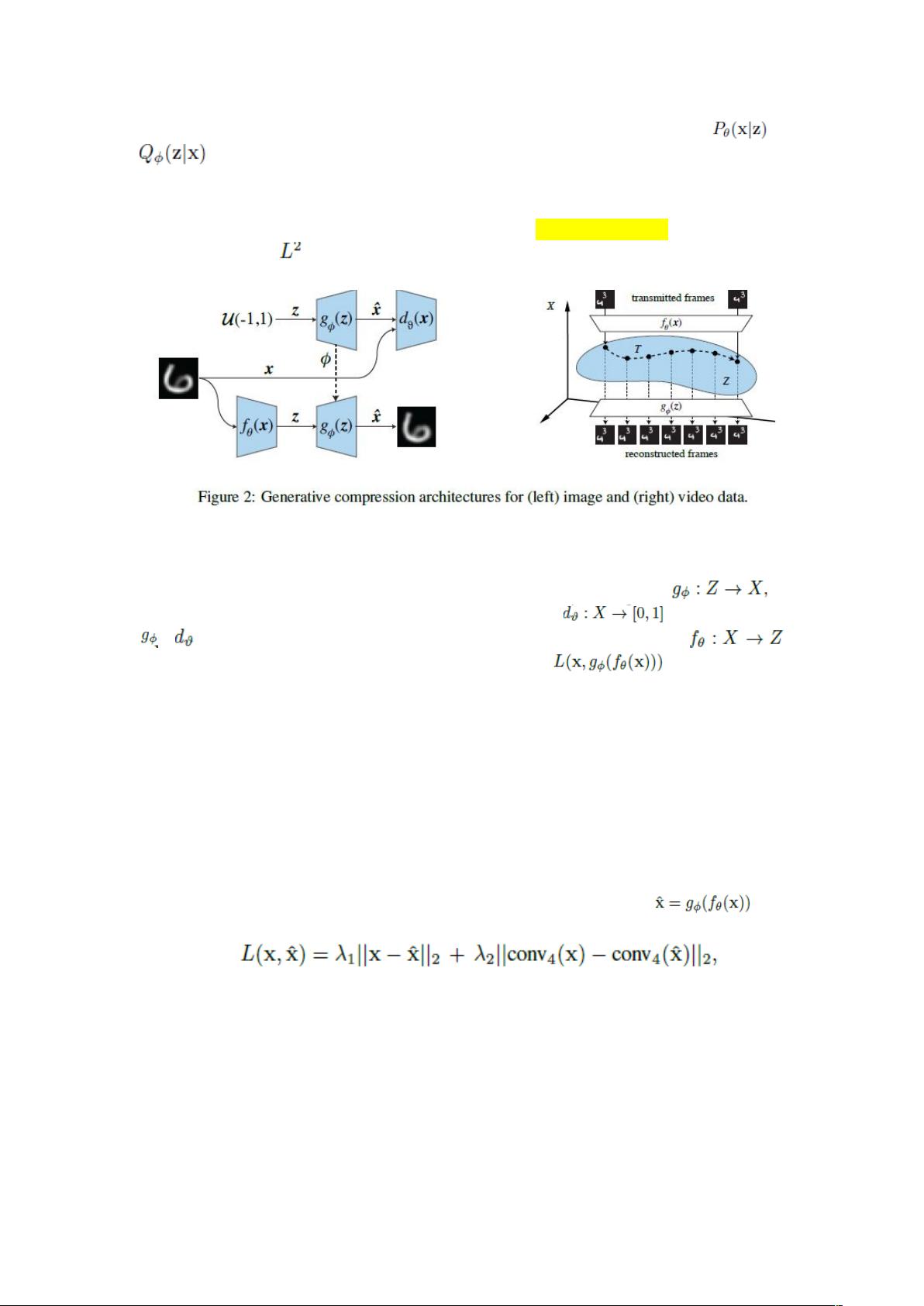

"这篇文档介绍了‘可生性压缩’的概念,这是一种使用生成模型对数据进行压缩的方法,尤其在图像和视频领域,能产生更精确、视觉效果更好的重建结果。相较于传统可变长度编码,生成压缩在面对比特错误时更具容错性,能够实现更优雅的降级。文中探讨了生成模型在有损压缩中的应用,提出它有潜力在这一领域带来显著的改进,特别是在处理高维度数据如图像和视频时,能够有效地利用感知冗余来减少编码的长度。传统压缩方法通常通过分析和合成变换结合率失真优化来实现,而生成压缩则提供了新的思路,有望超越这一局限。"

在当前的压缩技术中,尤其是图像和视频压缩,传统算法如JPEG依赖于固定的编码器/解码器,对压缩数据的特性缺乏理解,导致在数据传输过程中出现错误时,用户体验的下降往往较为明显。生成性压缩的引入,借鉴了深度生成模型的理念,旨在通过训练模型学习数据的内在结构,进而生成更接近原始内容的压缩表示。这种方式不仅在压缩效率上有所提升,还能在低带宽或存在传输错误的情况下,保持较好的视觉效果。

有损压缩是生成压缩的主要研究领域,目标是在降低数据率的同时控制失真。传统方法通过分析转换将输入数据映射到潜在空间,再通过量化和熵编码进行压缩。然而,这种做法往往无法同时优化速率和失真,因为这是一个复杂的优化问题。生成压缩通过学习数据的潜在分布,可能找到更高效的编码方式,尤其是在高维数据中,如图像的像素强度或视频帧,这些数据可能存在大量的感知冗余。

文章提到了一个例子,说明了一个简单的字符串“草地网球场”虽然只有少量字节,但人类的理解却能重构出丰富的场景。同样的,即使是简单的28x28灰度图像,其潜在的图像多样性也是巨大的。生成压缩的目标就是利用这种感知冗余,减少编码的长度,同时保持高质量的重建。

生成模型,如变分自编码器(VAE)和生成对抗网络(GAN),已经在图像生成等领域取得了显著进展。将这些模型应用于压缩领域,可以期望在不失真的前提下实现更高的压缩比率,或者在相同的压缩比率下获得更低的失真。此外,由于生成模型能够学习到数据的复杂模式,它们在面对传输错误时,可能比传统的编码方案更具有恢复能力,从而实现更优雅的降级,即在带宽受限或噪声环境中仍能保持可接受的解压效果。

生成性压缩是一个有前景的研究方向,它结合了机器学习和信息理论,旨在提升数据压缩的效率和质量,特别是在对视觉效果要求较高的应用中。随着深度学习技术的不断进步,未来可能会有更多创新的压缩方法出现,进一步推动信息技术的发展。

2021-10-03 上传

2019-05-27 上传

2021-02-22 上传

2020-12-12 上传

2022-01-06 上传

2021-09-23 上传

shuquewan2433

- 粉丝: 0

- 资源: 1

最新资源

- BottleJS快速入门:演示JavaScript依赖注入优势

- vConsole插件使用教程:输出与复制日志文件

- Node.js v12.7.0版本发布 - 适合高性能Web服务器与网络应用

- Android中实现图片的双指和双击缩放功能

- Anum Pinki英语至乌尔都语开源词典:23000词汇会话

- 三菱电机SLIMDIP智能功率模块在变频洗衣机的应用分析

- 用JavaScript实现的剪刀石头布游戏指南

- Node.js v12.22.1版发布 - 跨平台JavaScript环境新选择

- Infix修复发布:探索新的中缀处理方式

- 罕见疾病酶替代疗法药物非临床研究指导原则报告

- Node.js v10.20.0 版本发布,性能卓越的服务器端JavaScript

- hap-java-client:Java实现的HAP客户端库解析

- Shreyas Satish的GitHub博客自动化静态站点技术解析

- vtomole个人博客网站建设与维护经验分享

- MEAN.JS全栈解决方案:打造MongoDB、Express、AngularJS和Node.js应用

- 东南大学网络空间安全学院复试代码解析