Spark2.3 HA集群分布式安装详教程:图文实战

33 浏览量

更新于2024-09-09

收藏 1.11MB PDF 举报

Spark学习笔记(二)详细介绍了Spark 2.3版本的高可用性(High Availability, HA)集群的分布式安装过程。该指南以图文并茂的形式,涵盖了从下载Spark安装包、安装前提条件、安装步骤到实际操作的各个环节。

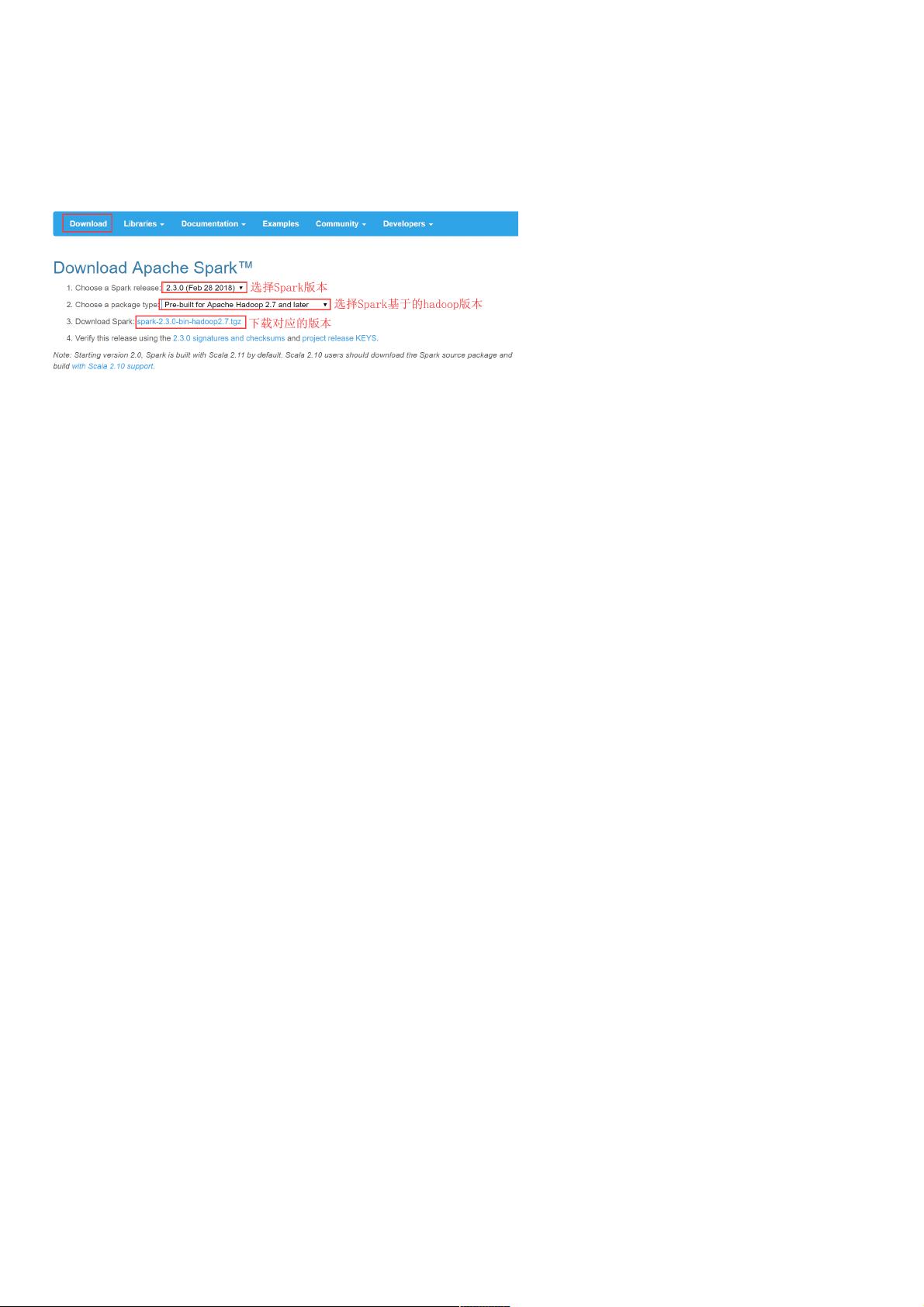

首先,作者建议从Apache官网(<http://spark.apache.org/downloads.html>)、微软镜像站(<http://mirrors.hust.edu.cn/apache/>)或清华大学镜像站(<https://mirrors.tuna.tsinghua.edu.cn/apache/>)下载Spark 2.3的安装包,确保使用的是与Hadoop 2.7.5兼容的版本。

安装前,需要确保Java 8、Zookeeper以及Hadoop 2.7.5已经成功安装。Java是Spark运行的基础,Zookeeper负责集群的协调服务,而Hadoop是Spark构建在之上的大数据处理框架。Scala语言(尽管不是必需的,但Spark的很多应用需要用到)也需要预先安装。

安装过程中,用户需要将下载的Spark安装包`spark-2.3.0-bin-hadoop2.7.tgz`解压到`apps`目录,并创建一个软链接指向Spark的bin目录,以便于后续的命令行操作。这一步对于在多个节点间共享Spark环境至关重要。

接着,读者可以按照文章中的示例进行操作,例如查看当前目录的文件结构,确认安装包的存在,以及创建软链接等。这些步骤旨在确保Spark环境的整洁和一致性。

最后,通过实例演示了如何启动Spark HA集群,包括配置环境变量、启动Spark Master和Worker节点,以及执行Spark程序。这些操作涉及配置核心的spark-env.sh文件,设置SPARK_HOME和HADOOP_CONF_DIR等环境变量,以及启动`sbin/start-master.sh`和`sbin/start-slave.sh`命令。

这篇Spark学习笔记提供了详细的Spark 2.3 HA集群分布式安装指导,帮助读者理解并实践如何在一个集群环境中部署和管理Spark,这对于任何希望在大数据处理场景中使用Spark的开发者来说,都是非常实用的参考资料。

2024-03-08 上传

2022-08-07 上传

2023-06-14 上传

2024-07-18 上传

2021-05-26 上传

2024-09-16 上传

2021-05-26 上传

weixin_38625599

- 粉丝: 8

- 资源: 867

最新资源

- Raspberry Pi OpenCL驱动程序安装与QEMU仿真指南

- Apache RocketMQ Go客户端:全面支持与消息处理功能

- WStage平台:无线传感器网络阶段数据交互技术

- 基于Java SpringBoot和微信小程序的ssm智能仓储系统开发

- CorrectMe项目:自动更正与建议API的开发与应用

- IdeaBiz请求处理程序JAVA:自动化API调用与令牌管理

- 墨西哥面包店研讨会:介绍关键业绩指标(KPI)与评估标准

- 2014年Android音乐播放器源码学习分享

- CleverRecyclerView扩展库:滑动效果与特性增强

- 利用Python和SURF特征识别斑点猫图像

- Wurpr开源PHP MySQL包装器:安全易用且高效

- Scratch少儿编程:Kanon妹系闹钟音效素材包

- 食品分享社交应用的开发教程与功能介绍

- Cookies by lfj.io: 浏览数据智能管理与同步工具

- 掌握SSH框架与SpringMVC Hibernate集成教程

- C语言实现FFT算法及互相关性能优化指南