Python利用神经网络解决非线性回归问题实例详解利用神经网络解决非线性回归问题实例详解

主要介绍了Python利用神经网络解决非线性回归问题,结合实例形式详细分析了Python使用神经网络解决非线性回归问题的相

关原理与实现技巧,需要的朋友可以参考下

本文实例讲述了Python利用神经网络解决非线性回归问题。分享给大家供大家参考,具体如下:

问题描述问题描述

现在我们通常使用神经网络进行分类,但是有时我们也会进行回归分析。

如本文的问题:

我们知道一个生物体内的原始有毒物质的量,然后对这个生物体进行治疗,向其体内注射一个物质,过一段时间后重新测量这个生物体内有

毒物质量的多少。

因此,问题中有两个输入,都是标量数据,分别为有毒物质的量和注射物质的量,一个输出,也就是注射治疗物质后一段时间生物体的有毒

物质的量。

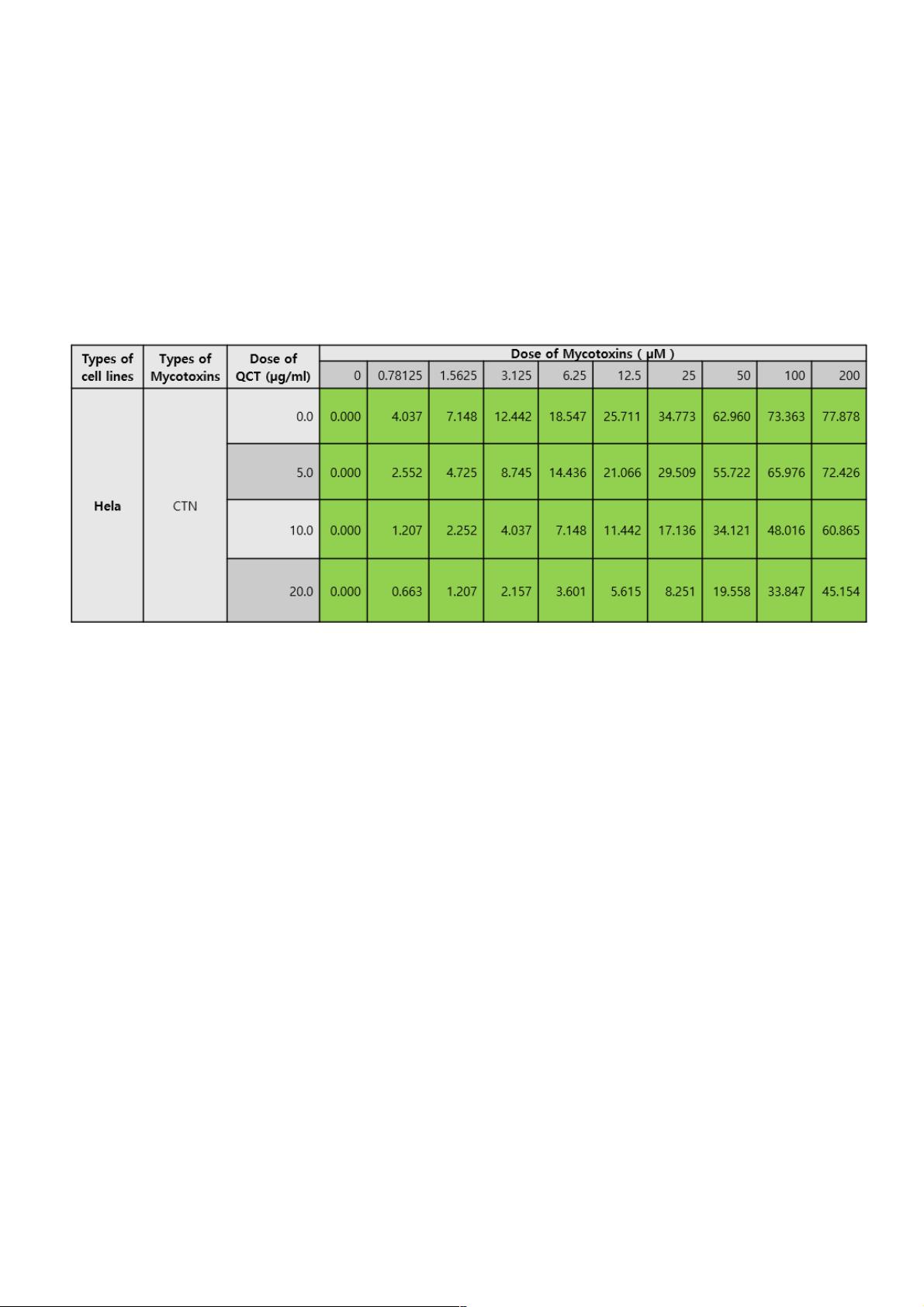

数据如下图:

其中Dose of Mycotoxins 就是有毒物质,Dose of QCT就是治疗的药物。

其中蓝色底纹的数字就是输出结果。

一些说明一些说明

由于本文是进行回归分析,所以最后一层不进行激活,而直接输出。

本文程序使用sigmoid函数进行激活。

本文程序要求程序有一定的可重复性,隐含层可以指定。

另外,注意到

本文将使用数据预处理,也就是将数据减去均值再除以方差,否则使用sigmoid将会导致梯度消失。

因为数据比较大,比如200,这时输入200,当sigmoid函数的梯度就是接近于0了。

与此同时,我们在每一次激活前都进行BN处理,也就是batch normalize,中文可以翻译成规范化。

否则也会导致梯度消失的问题。与预处理情况相同。

程序程序

程序包括两部分,一部分是模型框架,一个是训练模型

第一部分:第一部分:

# coding=utf-8

import numpy as np

def basic_forard(x, w, b):

x = x.reshape(x.shape[0], -1)

out = np.dot(x, w) + b

cache = (x, w, b)

return out, cache

def basic_backward(dout, cache):

x, w, b = cache

dout = np.array(dout)

dx = np.dot(dout, w.T)

# dx = np.reshape(dx, x.shape)

# x = x.reshape(x.shape[0], -1)

dw = np.dot(x.T, dout)

db = np.reshape(np.sum(dout, axis=0), b.shape)

return dx, dw, db

def batchnorm_forward(x, gamma, beta, bn_param):

mode = bn_param['mode']

eps = bn_param.get('eps', 1e-5)

momentum = bn_param.get('momentum', 0.9)

N, D = x.shape

评论0