深度学习基础:神经网络偏置项的作用解析

44 浏览量

更新于2023-03-16

3

收藏 293KB PDF 举报

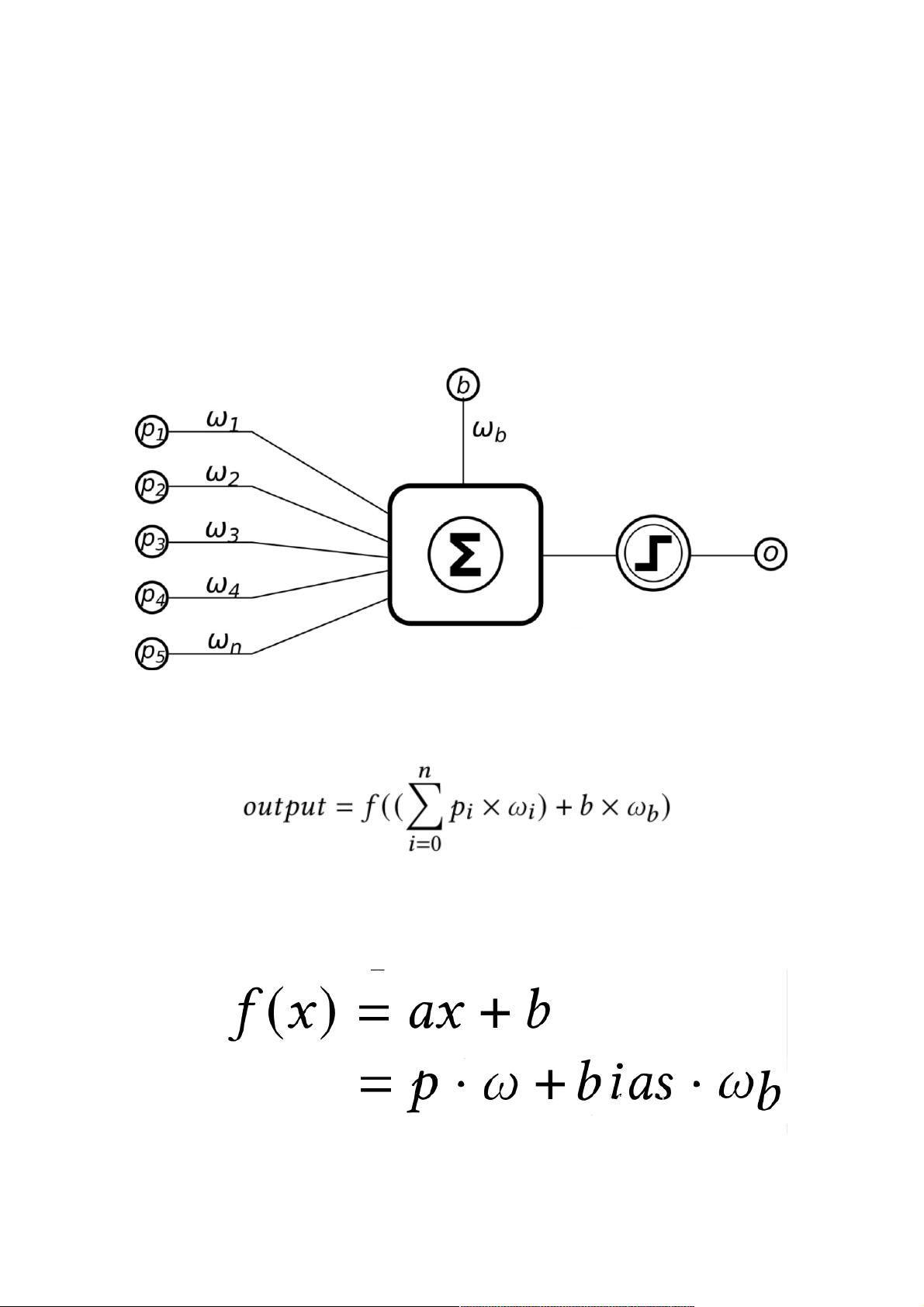

"这篇文章除了探讨为什么神经网络中的感知机需要偏置项外,还涉及了感知器的基本概念,以及偏置项在模型中的作用。文章通过一个简单的线性函数与感知器模型的比较,解释了偏置项如何影响函数的特性,并通过OR函数的例子展示了偏置项在分类问题中的重要性。"

在深度学习和神经网络中,偏置项(bias)是神经元不可或缺的一部分。它与权重(weights)一起决定了神经元的输出。在标题和描述中,作者指出,从早期的感知器模型开始,偏置项就已经被广泛使用,但对于为何需要偏置项,许多人可能并没有深入理解。

首先,感知器是最早期的人工神经网络模型之一,它主要用于简单的二分类问题。在感知器的数学模型中,输入信号与权重的乘积加上偏置项后,通过激活函数转化为输出。激活函数如阶跃函数,将线性组合转换为非线性决策边界。

不包含偏置项的线性函数只有在特定情况下才能产生非零输出。例如,当所有输入都为零时,没有偏置项的函数输出也将为零。这限制了模型的能力,因为它无法适应那些需要在输入均为零时仍需产生非零响应的情况。偏置项的作用类似于调整线性函数的y轴截距,它可以改变函数的起始位置,使得模型能够处理更广泛的输入情况。

在图示的OR函数例子中,有两个类别的数据点,[0,0]和[1,0]。若没有偏置项,感知器的决策边界将始终穿过原点,无法正确地将这两个点分开。然而,通过引入偏置项,我们可以使决策边界偏移,从而正确地划分这两个类别。这表明在某些情况下,偏置项对于模型的分类能力至关重要。

此外,偏置项对于解决所谓的“零均值问题”也非常重要。在实际数据集中,输入特征的均值可能不为零,这可能导致模型的训练困难。偏置项允许模型在不改变权重的情况下,对输入数据的平均值进行补偿,从而提高模型的泛化性能。

神经网络中的偏置项是模型表达能力的关键组成部分。它增加了模型的灵活性,使模型能够适应更复杂的输入分布,并解决了特定场景下的分类问题。在理解和构建神经网络时,偏置项的引入和调整是必不可少的步骤,对于优化模型的性能有着重要的作用。

2020-09-12 上传

2023-05-17 上传

2023-07-17 上传

2023-07-28 上传

2023-06-08 上传

2023-07-09 上传

2024-07-05 上传

2024-04-16 上传

2023-06-10 上传

weixin_38680671

- 粉丝: 4

- 资源: 960

最新资源

- IPQ4019 QSDK开源代码资源包发布

- 高频组电赛必备:掌握数字频率合成模块要点

- ThinkPHP开发的仿微博系统功能解析

- 掌握Objective-C并发编程:NSOperation与NSOperationQueue精讲

- Navicat160 Premium 安装教程与说明

- SpringBoot+Vue开发的休闲娱乐票务代理平台

- 数据库课程设计:实现与优化方法探讨

- 电赛高频模块攻略:掌握移相网络的关键技术

- PHP简易简历系统教程与源码分享

- Java聊天室程序设计:实现用户互动与服务器监控

- Bootstrap后台管理页面模板(纯前端实现)

- 校园订餐系统项目源码解析:深入Spring框架核心原理

- 探索Spring核心原理的JavaWeb校园管理系统源码

- ios苹果APP从开发到上架的完整流程指南

- 深入理解Spring核心原理与源码解析

- 掌握Python函数与模块使用技巧