没有合适的资源?快使用搜索试试~ 我知道了~

首页支持向量机通俗导论(SVM三层境界)-2018最新LaTex版

资源详情

资源评论

资源推荐

目录 2

目录

1 第一层:了解 SVM 4

1.1 分类标准的起源:Logistic 回归 . . . . . . . . . . . . . . . . . . . . . . . . 4

1.2 线性分类的一个例子 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 5

1.3 函数间隔 Functional margin 与几何间隔 Geometrical margin . . . . . . . 8

1.4 最大间隔分类器 Maximum Margin Classifier 的定义 . . . . . . . . . . . . 9

2 第二层:深入 SVM 12

2.1 从线性可分到线性不可分 . . . . . . . . . . . . . . . . . . . . . . . . . . . 12

2.1.1 从原始问题到对偶问题的求解 . . . . . . . . . . . . . . . . . . . . . 12

2.1.2 K.K.T. 条件 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 13

2.1.3 对偶问题求解的 3 个步骤 . . . . . . . . . . . . . . . . . . . . . . . 14

2.1.4 线性不可分的情况 . . . . . . . . . . . . . . . . . . . . . . . . . . . 16

2.2 核函数:Kernel . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 18

2.2.1 特征空间的隐式映射:核函数 . . . . . . . . . . . . . . . . . . . . . 18

2.2.2 核函数:如何处理非线性数据 . . . . . . . . . . . . . . . . . . . . . 19

2.2.3 几个核函数 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 22

2.2.4 核函数的本质 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 23

2.3 使用松弛变量处理 outliers 方法 . . . . . . . . . . . . . . . . . . . . . . . . 24

3 证明 SVM 29

3.1 线性学习器 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 29

3.1.1 感知器算法 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 29

3.2 非线性学习器 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 31

3.2.1 Mercer 定理 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 31

3.3 损失函数 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

3.4 最小二乘法 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 34

3.4.1 什么是最小二乘法? . . . . . . . . . . . . . . . . . . . . . . . . . . 34

3.4.2 最小二乘法的解法 . . . . . . . . . . . . . . . . . . . . . . . . . . . 35

3.5 SMO 算法 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 37

3.5.1 SMO 算法的推导 . . . . . . . . . . . . . . . . . . . . . . . . . . . . 37

3.5.2 SMO 算法的步骤 . . . . . . . . . . . . . . . . . . . . . . . . . . . . 42

3.5.3 SMO 算法的实现 . . . . . . . . . . . . . . . . . . . . . . . . . . . . 44

3.6 SVM 的应用 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 45

3.6.1 文本分类 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 45

目录 3

前言

动笔写这个支持向量机 (Support Vector Machine

1

) 是费了不少劲和困难的,原

因很简单,一者这个东西本身就并不好懂,要深入学习和研究下去需花费不少时间和精

力,二者这个东西也不好讲清楚,尽管网上已经有朋友写得不错了 (见文末参考链接),

但在描述数学公式的时候还是显得不够。得益于同学白石的数学证明,我还是想尝试写

一下,希望本文在兼顾通俗易懂的基础上,真真正正能足以成为一篇完整概括和介绍支

持向量机的导论性的文章。

本文在写的过程中,参考了不少资料,包括《支持向量机导论》、《统计学习方法》

及网友 pluskid 的支持向量机系列等等,于此,还是一篇学习笔记,只是加入了自己的

理解和总结,有任何不妥之处,还望海涵。全文宏观上整体认识支持向量机的概念和用

处,微观上深究部分定理的来龙去脉,证明及原理细节,力保逻辑清晰 & 通俗易懂。

同时,阅读本文时建议大家尽量使用 chrome 等浏览器,如此公式才能更好的显示,

再者,阅读时可拿张纸和笔出来,把本文所有定理. 公式都亲自推导一遍或者直接打印

下来(可直接打印网页版或本文文末附的 PDF,享受随时随地思考、演算的极致快感),

在文稿上演算。

OKL,还是那句原话,有任何问题,欢迎任何人随时不吝指正 & 赐教,感谢。

1

http://en.wikipedia.org/wiki/Support_vector_machine

1 第一层:了解 SVM 4

1 第一层:了解 SVM

支

持向量机,因其英文名为 Support Vector Machine,故一般简称 SVM,通俗

来讲,它是一种二类分类模型,其基本模型定义为特征空间上的间隔最大的线

性分类器,其学习策略便是间隔最大化,最终可转化为一个凸二次规划问题的求解。

1.1 分类标准的起源:Logistic 回归

理解 SVM,咱们必须先弄清楚一个概念:线性分类器。

给定一些数据点,它们分别属于两个不同的类,现在要找到一个线性分类器把这些

数据分成两类。如果用 x 表示数据点,用 y 表示类别(y 可以取 1 或者 −1,分别代表

两个不同的类),一个线性分类器的学习目标便是要在 n 维的数据空间中找到一个超平

面(hyper plane),这个超平面的方程可以表示为(w

T

中的 T 代表转置):

w

T

x + b = 0 (1.1)

可能有读者对类别取 1 或 −1 有疑问,事实上,这个 1 或 −1 的分类标准起源于

Logistic 回归

2

。

定义 1 (Logistic 回归) Logistic 回归目的是从特征学习出一个 0/1 分类模型,而这个

模型是将特征的线性组合作为自变量,由于自变量的取值范围是负无穷到正无穷,因

此,使用 Logistic 函数(或称作 sigmoid 函数)将自变量映射到 (0, 1) 上,映射后的值

被认为是属于 y = 1 的概率。

假设函数:

h

θ

(x) = g(θ

T

x) =

1

1 + e

−θ

T

x

(1.2)

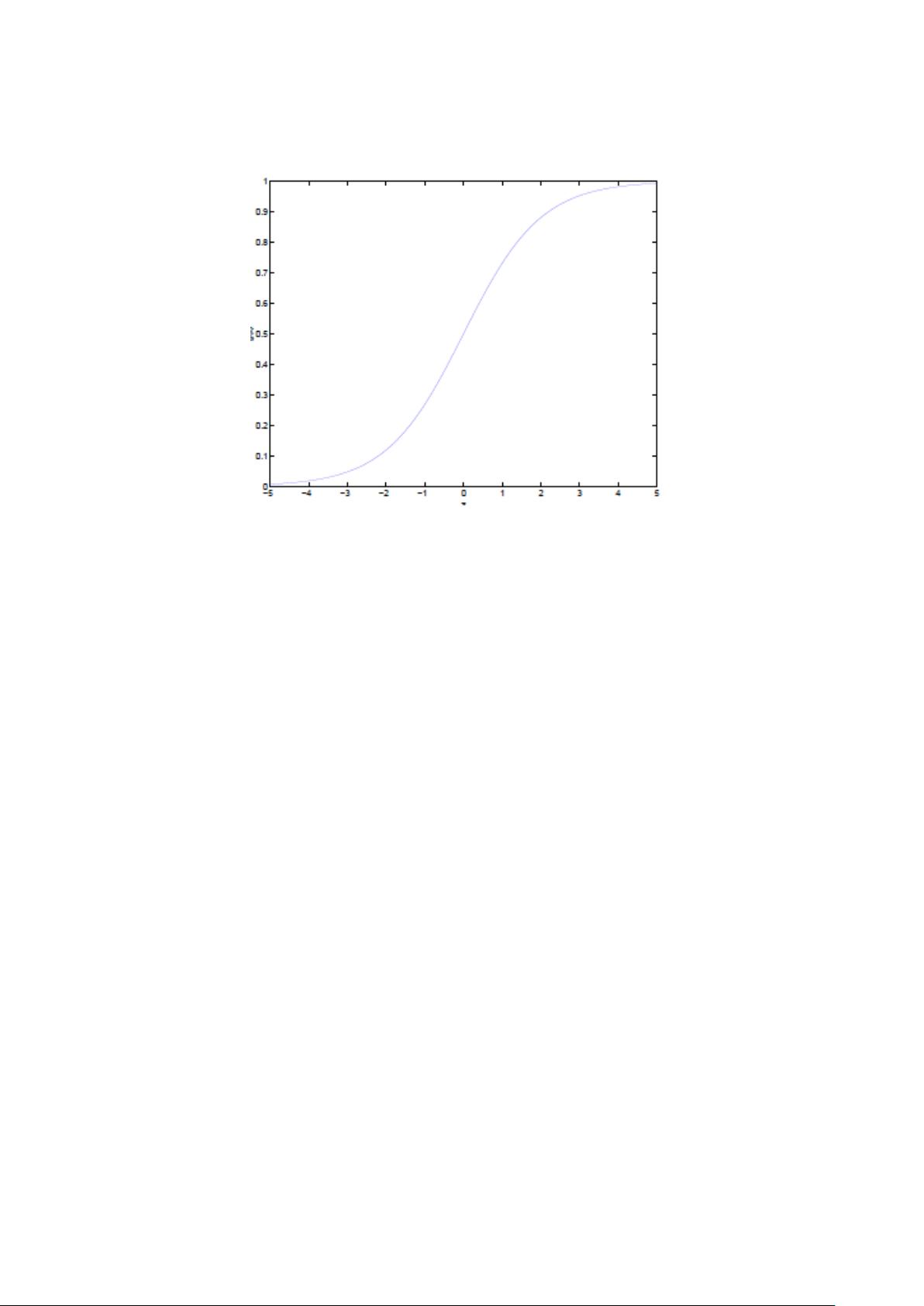

其中,x 是 n 维特征向量,函数 g 就是 Logistic 函数。而 g(z) =

1

1+e

−z

的图像如

图1,将无穷映射到了 (0, 1)。

而假设函数就是属于 y = 1 的概率:

P (y = 1|x; θ) = h

θ

(x) (1.3)

P (y = 0|x; θ) = 1 − h

θ

(x) (1.4)

从而,当我们要判别一个新来的特征属于哪个类时,只需求 h

θ

(x) 即可,若 h

θ

(x)

大于 0.5 就是 y = 1 的类,反之属于 y = 0 类。

2

http://en.wikipedia.org/wiki/Logistic_regression

1 第一层:了解 SVM 5

图 1: Logistic 函数图像

此外,h

θ

(x) 只和 θ

T

x 有关,θ

T

x > 0,那么 h

θ

(x) > 0.5,而 g(z) 只是用来映射,

真实的类别决定权还是在于 θ

T

x。再者,当 θ

T

x ≫ 0 时,h

θ

(x) = 1,反之 h

θ

(x) = 0。如

果我们只从 θ

T

x 出发,希望模型达到的目标就是让训练数据中 y = 1 的特征 θ

T

x ≫ 0,

而 y = 0 的特征 θ

T

x ≪ 0。Logistic 回归就是要学习得到 θ,使得正例的特征远大于 0,

负例的特征远小于 0,而且要在全部训练实例上达到这个目标。

接下来,尝试把 Logistic 回归做个变形。首先,将使用的结果标签 y = 0 和 y = 1

替换为 y = −1,y = 1,然后将 θ

T

x = θ

0

+ θ

1

x

1

+ θ

2

x

2

+ ···+ θ

n

x

n

(x

0

= 1) 中的 θ

0

替换

为 b,最后将后面的 θ

1

x

1

+ θ

2

x

2

+ ···+ θ

n

x

n

替换为 w

T

x。如此,则有了 θ

T

x = w

T

x + b。

也就是说除了 y 由 y = 0 变为 y = −1 外,线性分类函数跟 Logistic 回归的形式化表示

h

θ

(x) = g(θ

T

x) = g(w

T

x + b) 没区别。

进一步,可以将假设函数 h

w,b

(x) = g(w

T

x + b) 中的 g(z) 做一个简化,将其简单映

射到 y = −1 和 y = 1 上。映射关系如下:

g(z) =

1 z ≥ 0

−1 z < 0

(1.5)

1.2 线性分类的一个例子

下面举个简单的例子,如图2所示,现在有一个二维平面,平面上有两种不同的数

据,分别用圈和叉表示。由于这些数据是线性可分的,所以可以用一条直线将这两类数

据分开,这条直线就相当于一个超平面,超平面一边的数据点所对应的 y 全是 −1 ,另

一边所对应的 y 全是 1。

剩余50页未读,继续阅读

图灵的猫.

- 粉丝: 7348

- 资源: 10

上传资源 快速赚钱

我的内容管理

收起

我的内容管理

收起

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

会员权益专享

最新资源

- RTL8188FU-Linux-v5.7.4.2-36687.20200602.tar(20765).gz

- c++校园超市商品信息管理系统课程设计说明书(含源代码) (2).pdf

- 建筑供配电系统相关课件.pptx

- 企业管理规章制度及管理模式.doc

- vb打开摄像头.doc

- 云计算-可信计算中认证协议改进方案.pdf

- [详细完整版]单片机编程4.ppt

- c语言常用算法.pdf

- c++经典程序代码大全.pdf

- 单片机数字时钟资料.doc

- 11项目管理前沿1.0.pptx

- 基于ssm的“魅力”繁峙宣传网站的设计与实现论文.doc

- 智慧交通综合解决方案.pptx

- 建筑防潮设计-PowerPointPresentati.pptx

- SPC统计过程控制程序.pptx

- SPC统计方法基础知识.pptx

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论1