CNN学习笔记学习笔记

个人整理的CNN学习笔记,所有素材均来自于互联网,版权归作者所有,感谢各位作者的无私分享。我个人仅作了整理便于学

习之用。

http://www.cnblogs.com/charleshuang/p/3651843.html

http://www.68idc.cn/help/buildlang/ask/20150705417730.html(CNN的背景介绍)

http://www.68idc.cn/help/mobilesys/other/20160516616446.html(全面的综合讲解)

先解释一下:什么是卷积?先解释一下:什么是卷积?

在泛函分析中,卷积、旋积或摺积(英语:Convolution)是通过两个函数f 和g 生成第三个函数的一种数学算子,表征函数f 与

g经过翻转和平移翻转和平移的重叠部分的面积。

如果将参加卷积的一个函数看作区间的指示函数,卷积还可以被看作是“滑动平均滑动平均”的推广。

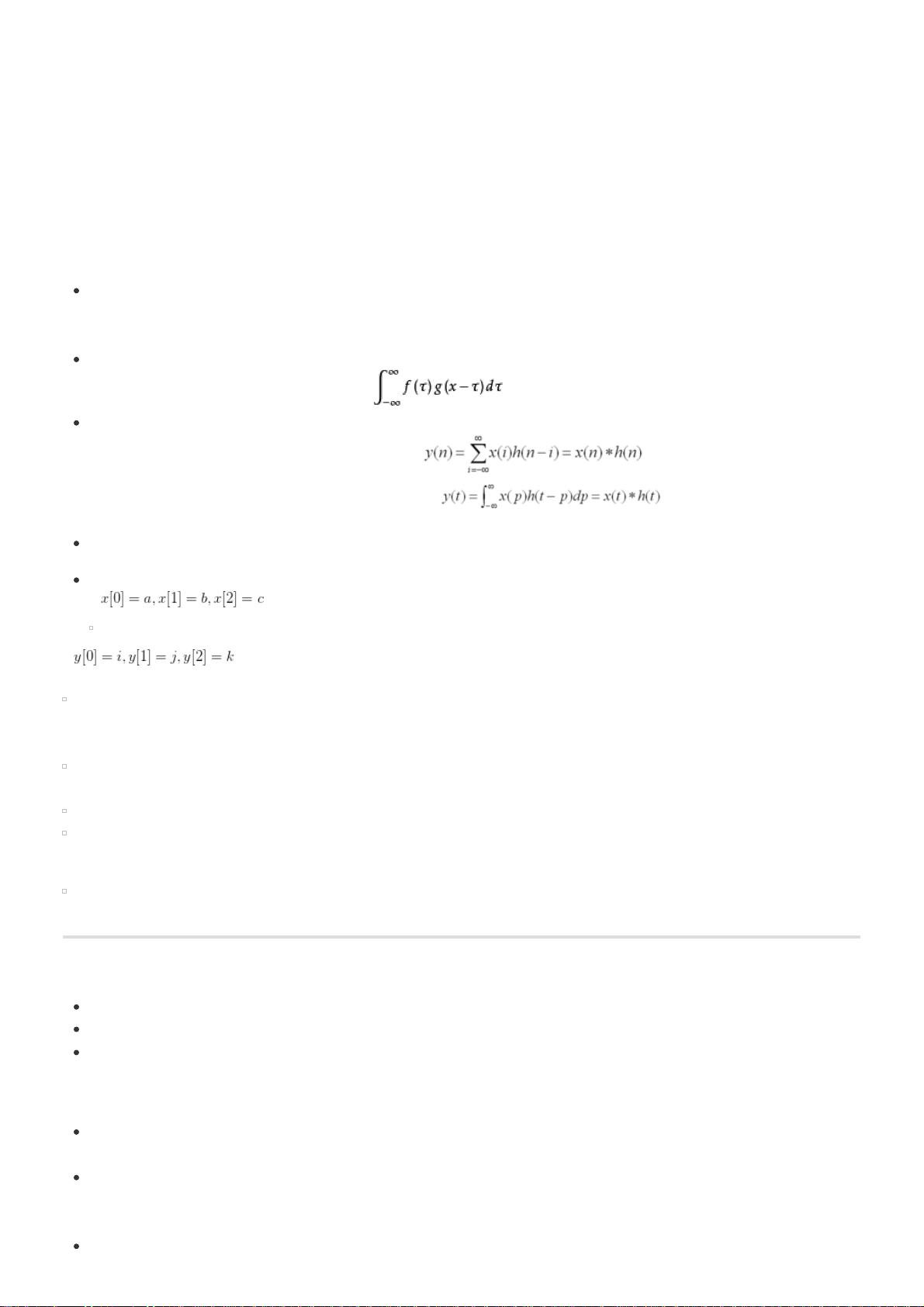

卷积的基本内涵公式:

设:f(x),g(x)是R1上的两个可积函数,作积分:

上面公式继而解释为:

1.如果卷积的变量是序列x(n)和h(n),则卷积的结果:

2.如果卷积的变量是函数x(t)和h(t),则卷积的计算变为:

物理意义:加权叠加加权叠加

图示见这个网址: http://www.zhihu.com/question/22298352?rf=21686447

1.

2.

3.x[n]乘以y[n]的过程

(1)x[n]乘以y[0]并平移到位置0:

(2)x[n]乘以y[1]并平移到位置1:

(3)x[n]乘以y[2]并平移到位置2:

(4)最后把上面三个图叠加,就得到了x[n]乘以y[n]:

重复一遍,这就是卷积的意义:加权叠加。重复一遍,这就是卷积的意义:加权叠加。

1.概述概述

CNN有两点:非全连接、权重共享

非全连接非全连接:并不是所有上、下层的神经元都直接相连

权重共享权重共享:同一层中某些神经元之间的连接权重是共享的(即相同的),降低了复杂度。

2.CNN结构结构

特征提取:提取局部特征局部特征。一旦一个特征被提取出来, 只要它相对于其他特征的位置被近似地保留下来,它的精确位置就

变得没有那么重要了。

特征映射:网络的每一个计算层都是由多个特征映射组成多个特征映射组成 的,每个特征映射都是平面形式的。平面中单独的神经元在约束

下共享相同的突触权值集共享相同的突触权值集,这种结构形式具有如下的有益效果:a.平移不变性。b.自由参数数量的缩减(通过权值共享实

现)。

子抽样:每个卷积层跟着一个实现局部平均和子抽样的计算层,由此特征映射的分辨率降低。这种操作具有使特征映射的

评论7