"这是一份来自上海交通大学的最优化方法课程笔记,涵盖了18个主要讲解内容,视频链接为<https://www.bilibili.com/video/BV1nx411x7dY/?spm_id_from=333.788.recommend_more_video.3>,涉及的学科领域包括最优化理论、数学以及机器学习。笔记中讨论了优化问题的最优条件、凸优化、一阶和二阶必要条件、充分条件、局部最小和全局最小等核心概念。"

在最优化方法中,我们关注的是如何找到函数的最优解,即最小值或最大值。这个过程广泛应用于机器学习中的模型训练,通过对损失函数的优化来提升模型性能。以下是笔记中提到的一些关键知识点:

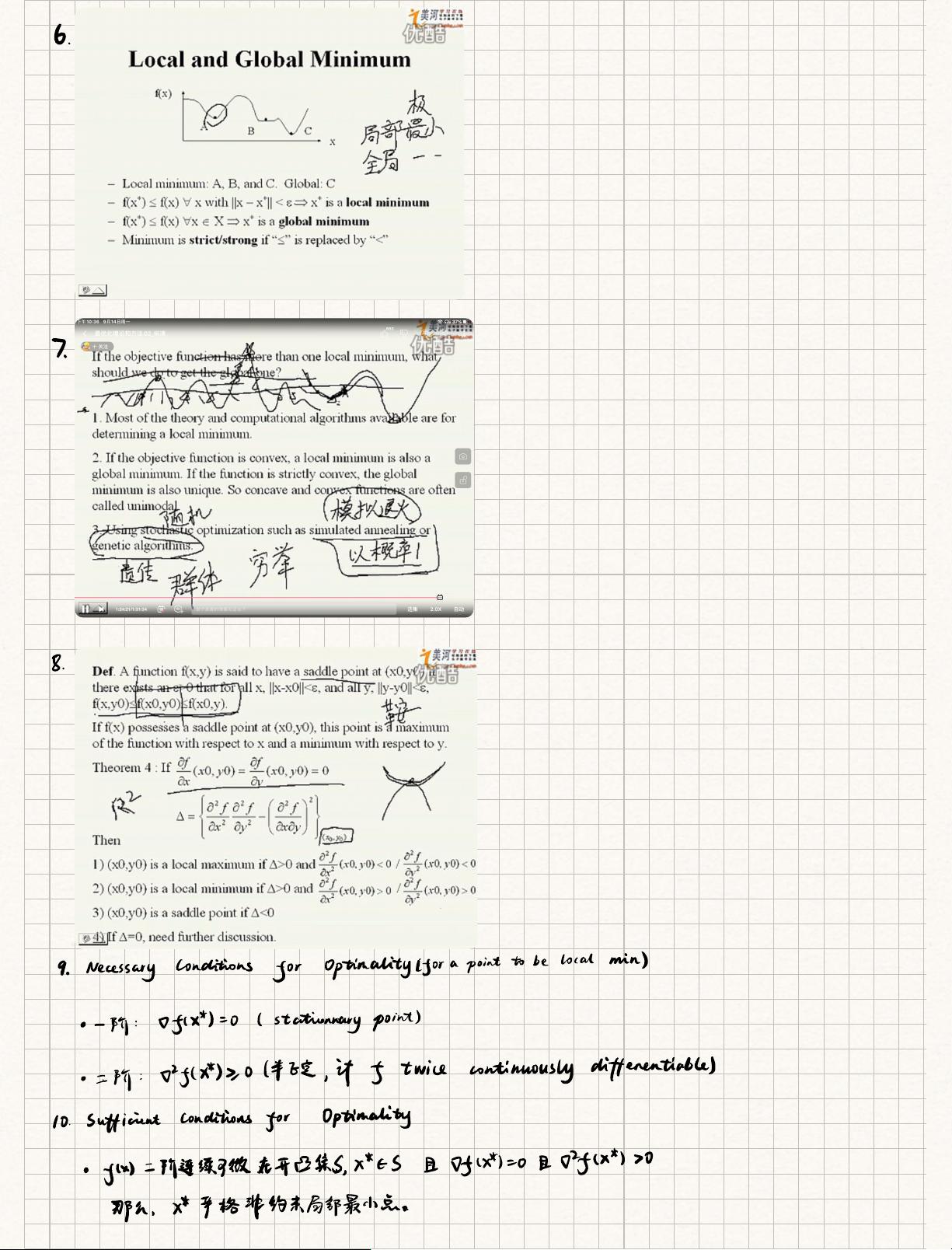

1. **最优条件**:这是判断一个点是否是局部最小值的基础。通常,如果一个点满足一阶导数为零(stationary point),那么它可能是局部最小值、最大值或者鞍点。

2. **二阶条件**:对于局部最小值的进一步确认,我们需要考虑二阶导数。如果Hessian矩阵(函数的二阶导数矩阵)是负定的,那么该点是局部最大值;如果是正定的,则为局部最小值;若为零,需要进一步分析。

3. **凸优化**:在凸函数的优化问题中,局部最小值就是全局最小值,这使得凸优化问题的求解更加简单和有效。函数在连接集X上是凸的,如果对于所有X中的点,函数的线性插值始终大于等于函数值。

4. **奇异点**:奇异点是指Hessian矩阵奇异(非满秩),这意味着二阶条件不能应用。处理这类点通常比较困难,因为它们可能既不是局部最小也不是局部最大。

5. **存在性**:在一定条件下,最优化问题总能找到解。例如,如果函数在紧集上取最小值,那么至少存在一个全局最小值。此外,如果函数是强制性的(coercive),即随着变量远离原点函数值趋于无穷大,那么在闭合且有界的集合上也总能找到全局最小值。

6. **一维搜索技术**:在寻找最优解的过程中,有时会用到一维搜索,如梯度下降法。初始点选定后,通过不断评估函数值,沿着负梯度方向更新点,直到无法再下降为止,以达到最小化目标。

7. **单峰函数**:假设函数在某区间内具有单峰性质(unimodal),即函数值只在一个方向上单调递增或递减。在这种情况下,可以通过区间分割等方法有效地找到最小值点。

这些是优化方法中的基本概念,理解和掌握这些知识点对于解决实际优化问题至关重要,特别是在机器学习和数据科学领域。通过深入学习和实践,我们可以更有效地解决复杂优化问题,提升模型的预测或决策能力。