详解基于详解基于Scrapy的的IP代理池搭建代理池搭建

一、为什么要搭建爬虫代理池一、为什么要搭建爬虫代理池

在众多的网站防爬措施中,有一种是根据ip的访问频率进行限制,即在某一时间段内,当某个ip的访问次数达到一定的阀值

时,该ip就会被拉黑、在一段时间内禁止访问。

应对的方法有两种:

1. 降低爬虫的爬取频率,避免IP被限制访问,缺点显而易见:会大大降低爬取的效率。

2. 搭建一个IP代理池,使用不同的IP轮流进行爬取。

二、搭建思路二、搭建思路

1、从代理网站(如:西刺代理、快代理、云代理、无忧代理)爬取代理IP;

2、验证代理IP的可用性(使用代理IP去请求指定URL,根据响应验证代理IP是否生效);

3、将可用的代理IP保存到数据库;

在《Python爬虫代理池搭建》一文中我们已经使用Python的 requests 模块简单实现了一个IP代理池搭建,但是爬取速度较

慢。由于西刺代理、快代理和云代理等网站需要爬取的IP代理列表页多达上千页,使用此种方法来爬取其实并不适合。

本文将以快代理网站的IP代理爬取为例,示例如何使用 Scrapy-Redis 来爬取代理IP。

三、搭建代理池三、搭建代理池

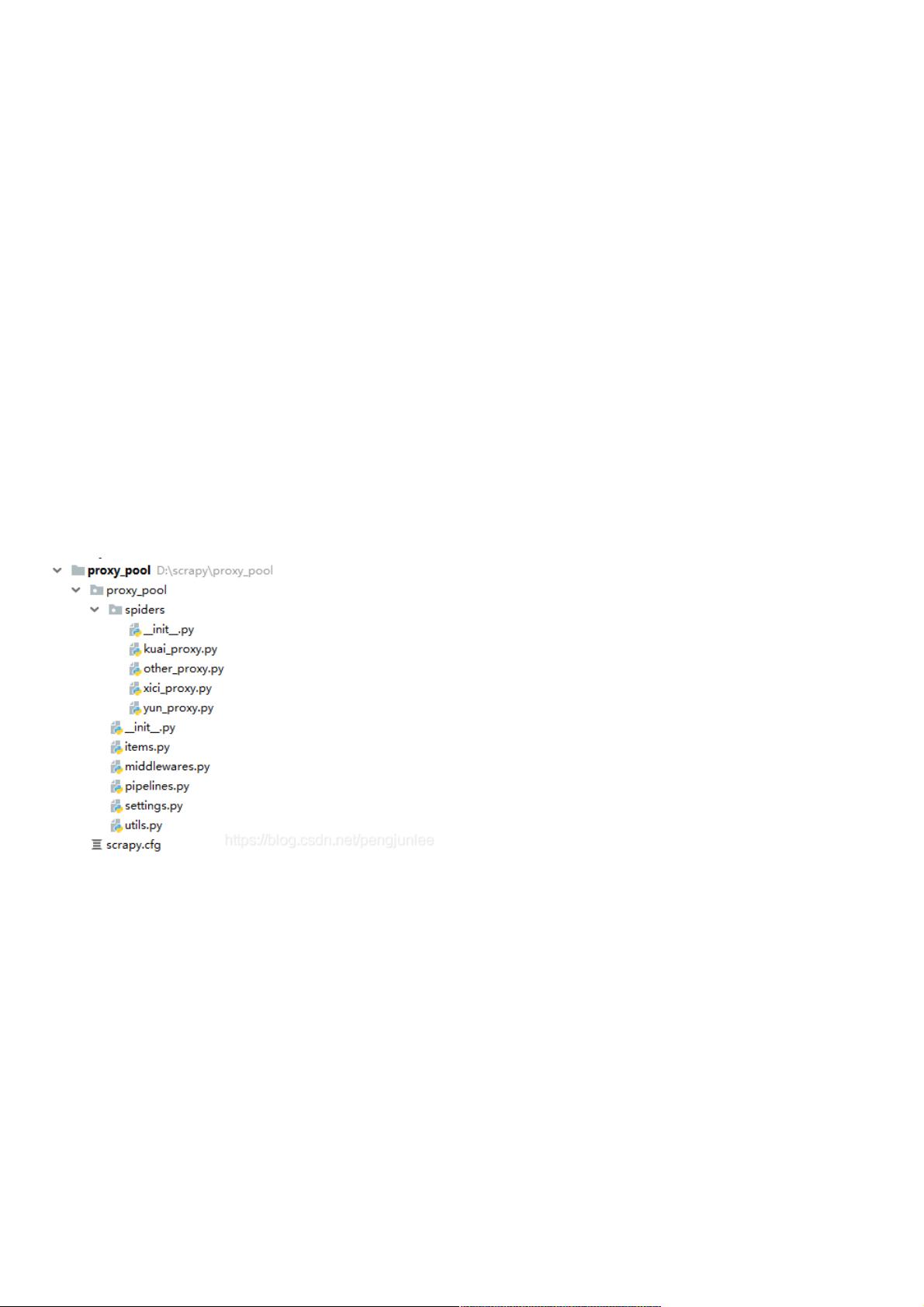

scrapy 项目的目录结构如下:

items.py

# -*- coding: utf-8 -*-

import re

import scrapy

from proxy_pool.settings import PROXY_URL_FORMATTER

schema_pattern = re.compile(r'http|https$', re.I)

ip_pattern = re.compile(r'^([0-9]{1,3}.){3}[0-9]{1,3}$', re.I)

port_pattern = re.compile(r'^[0-9]{2,5}$', re.I)

class ProxyPoolItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

'''

{

"schema": "http", # 代理的类型

"ip": "127.0.0.1", # 代理的IP地址

"port": "8050", # 代理的端口号

"original":"西刺代理",

"used_total": 11, # 代理的使用次数

"success_times": 5, # 代理请求成功的次数

评论0