"scrapy-python3教程"

Scrapy是一个强大的Python爬虫框架,适用于高效地构建网络爬虫项目。该教程结合作者的学习经验与个人理解,旨在帮助初学者快速掌握Scrapy的安装与基本使用。

首先,教程提到了Scrapy的安装过程。对于标准的Python3环境,需要预先安装lxml、zope.interface、Twisted、pyOpenSSL和win32py这五个依赖包,然后才能安装Scrapy本身。安装过程中可能会遇到各种问题,如pip版本过低或依赖包版本不匹配等,这些问题通常可以通过升级pip或手动安装缺失的依赖来解决。另外,教程推荐使用Anaconda环境,因为Anaconda内置了一个完整的Python环境,能够自动处理所有依赖,简化安装步骤,只需一行命令`conda install scrapy`即可完成Scrapy的安装。

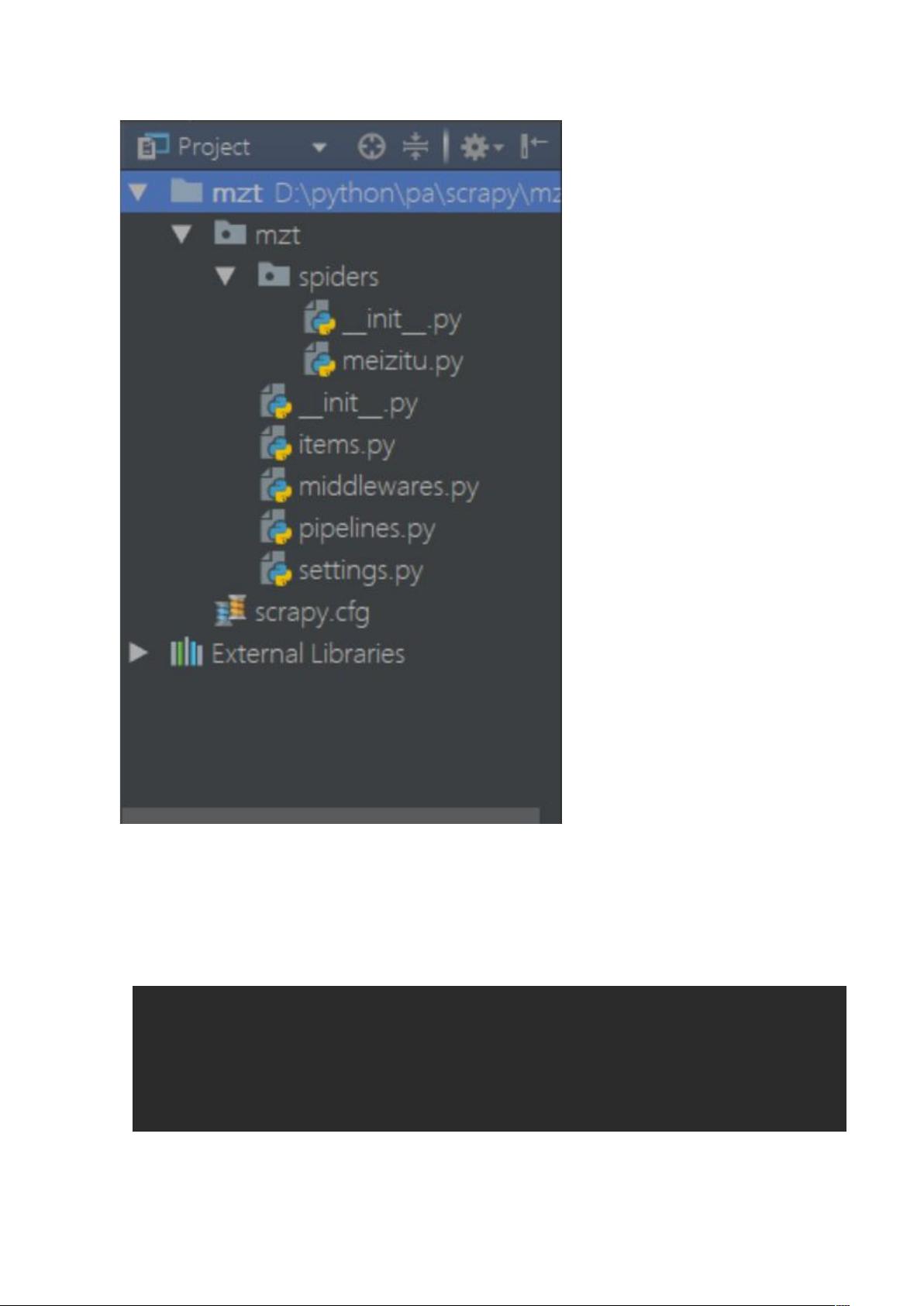

接着,教程进入Scrapy的实际应用部分,通过一个爬取妹子图的示例来讲解。创建Scrapy项目的第一步是生成项目框架,通过执行`scrapy startproject 项目名`命令,会在当前目录下生成一个包含标准结构的项目目录。此目录内的`scrapy.cfg`是项目的配置文件,其中`default`项指定了默认的设置模块位置。虽然默认设置通常能满足需求,但在大型项目中,根据实际需要可能需要自定义配置。

项目的核心文件包括`spiders`目录中的爬虫代码、`items.py`用于定义要抓取的数据结构、`pipelines.py`处理爬取数据的流程、`settings.py`定义项目的全局设置等。在示例中,作者未提供具体的代码,而是通过截图引导读者自行输入,以加深印象。爬虫通常会定义请求URL、解析响应内容(如使用XPath或CSS选择器)、遵循链接(如果有)、保存数据等步骤。

Scrapy的强大之处在于它的中间件系统,允许自定义请求和响应处理逻辑,以及对下载器和爬虫引擎的扩展。此外,Scrapy还支持分布式爬取,通过Scrapy Cluster或ScrapyRT等工具,可以将爬虫任务分布到多台机器上,提高抓取速度和稳定性。

本教程适合想要学习Python爬虫,并对Scrapy框架感兴趣的初学者。通过跟随教程的步骤,读者不仅可以了解如何安装和设置Scrapy,还能学会如何创建和运行一个基本的爬虫项目。随着对Scrapy的理解加深,读者可以进一步探索其高级特性,实现更复杂的网络爬虫应用。