"MapReduce源码分析完整版"

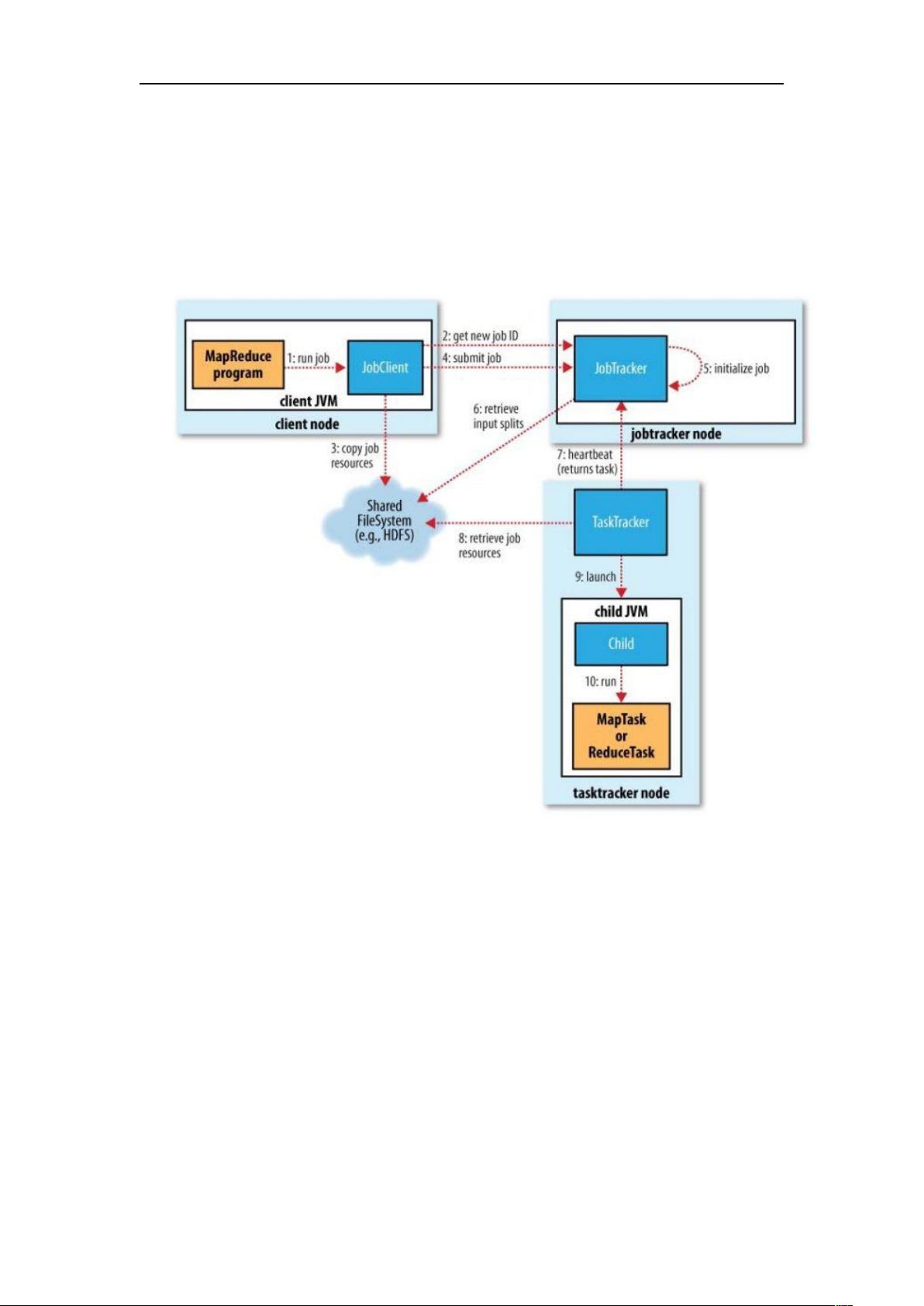

MapReduce是一种分布式计算模型,由Google工程师设计,用于处理和生成大规模数据集。它提供了一个编程模型,让用户可以通过自定义的map和reduce函数处理键值对数据。map函数接收键值对,生成新的中间键值对,而reduce函数则聚合所有具有相同中间键的值。这种模型适用于多种实际场景的数据处理任务。

MapReduce的工作原理分为两个主要阶段:Map阶段和Reduce阶段。在Map阶段,输入数据是键值对形式,这些对需要实现Writable接口以便序列化。键还需要实现WritableComparable接口,以便进行排序。Map函数将输入的键值对转换为一系列中间键值对。Reduce阶段则将具有相同中间键的所有值组合起来,生成最终的键值对结果。

以Hadoop自带的WordCount程序为例,它用于统计文本中单词的数量。在这个例子中,每个map任务处理文件的一行,将其拆分为单词,并生成形如<单词, 1>的中间键值对。然后,reduce任务收集所有相同的单词(中间键),并将对应的计数累加,最终输出形如<单词, 总计数>的键值对。

在map阶段,Hadoop使用LineRecordReader从文本文件中读取数据,每一行作为一个键值对,键通常是文件的偏移量,值是行的内容。例如,两个输入文件:

1. 文件1:HelloWorldByeWorld

2. 文件2:HelloHadoopGoodByeHadoop

在map阶段,这些行被分割成单词,生成的中间键值对可能是:

1. map1 输出:<Hello, 1>, <World, 1>, <Bye, 1>

2. map2 输出:<Hello, 1>, <Hadoop, 1>, <Good, 1>, <Bye, 1>

在reduce阶段,所有具有相同键的值被组合,计数被累加:

1. reduce 输出:<Hello, 2>, <World, 1>, <Bye, 2>, <Hadoop, 1>, <Good, 1>

MapReduce的核心在于其并行处理能力,可以将大规模数据分散到多台机器上处理,然后再汇总结果。通过这种方式,它能够有效地处理PB级别的数据。同时,MapReduce框架还包含了Shuffle和Sort过程,确保了数据在进入reduce之前被正确地分组和排序。

在源码分析中,我们通常会关注以下几个关键部分:

1. `Mapper`类:这是用户自定义的map函数实现,负责将输入键值对转换为中间键值对。

2. `Reducer`类:用户自定义的reduce函数实现,用于聚合中间键值对并生成最终结果。

3. `Partitioner`:确定哪些中间键将被送到哪个reduce任务,通常根据键的哈希值进行分配。

4. `Comparator`:如果需要自定义排序规则,可以提供比较器来决定中间键的顺序。

5. `InputFormat`和`OutputFormat`:分别定义数据的输入和输出格式,比如如何从文件中读取数据,以及如何将结果写入文件。

理解MapReduce的源码对于优化分布式计算任务、提高性能、解决数据处理中的问题以及实现复杂的并行算法至关重要。深入研究MapReduce源码有助于开发者更好地利用Hadoop生态系统,构建高效的大数据处理解决方案。