"该资源是一份关于文本挖掘的课程PDF,特别关注了词向量和深度学习在自然语言处理中的应用。文档以PPT的形式,从深度学习的基础开始讲解,适合初学者入门。内容涵盖了机器翻译、拼写纠错、智能问答、语言模型等多个主题,并深入探讨了语言模型的构建及其挑战,如数据稀疏性和参数空间过大问题。此外,还介绍了不同的语言模型方法,如基于n-gram的模型和神经网络模型,以及如CBOW这样的深度学习模型在处理语言任务中的优势。"

在自然语言处理(NLP)领域,深度学习已经成为解决复杂任务的关键技术。本课程首先介绍了深度学习的基础,这是理解和实现各种NLP任务的基础,例如机器翻译,它涉及到将一种语言的文本自动转化为另一种语言。拼写纠错是另一个重要应用,通过识别和修正文本中的错误拼写,提高文本的准确性和可读性。

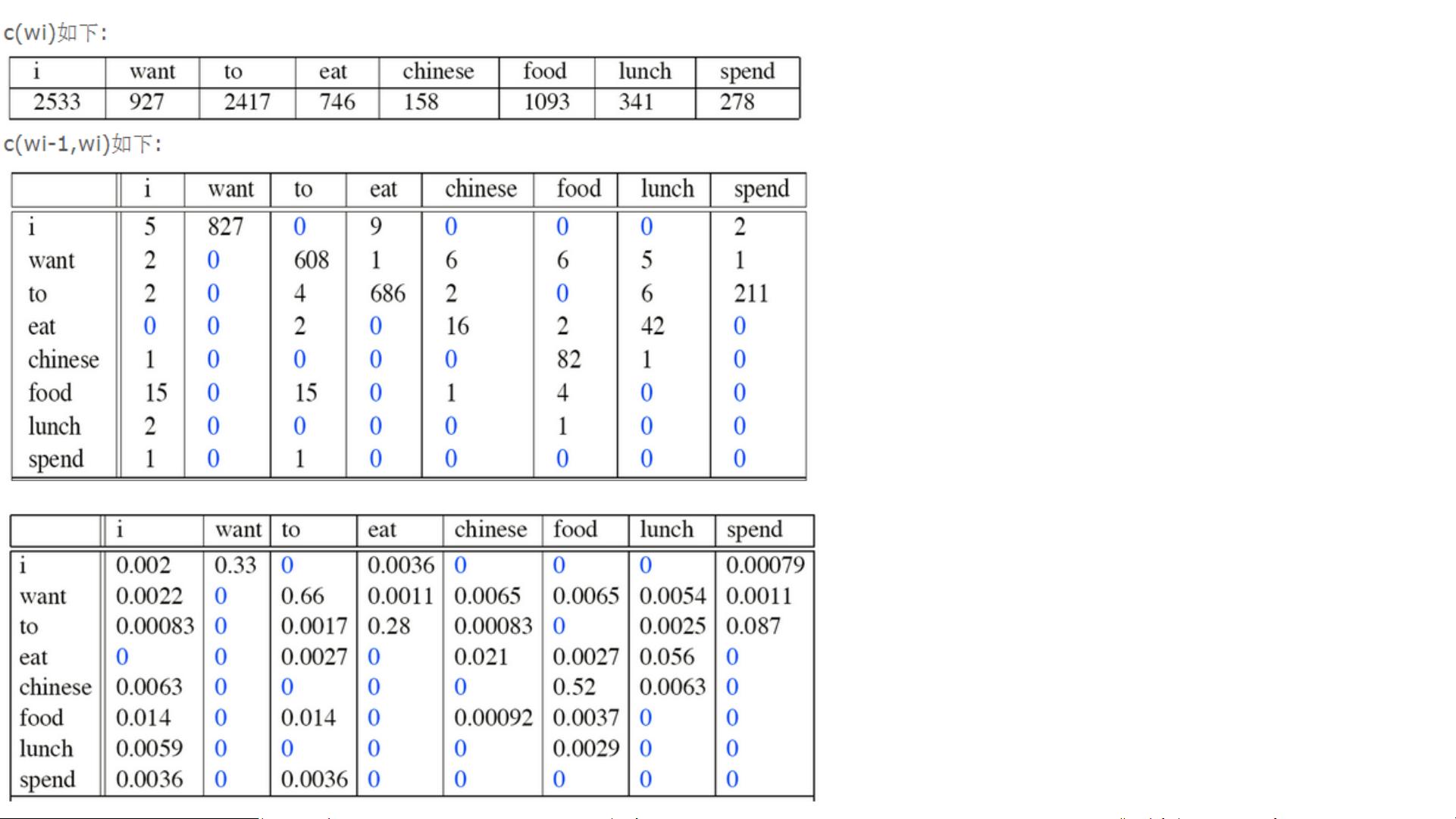

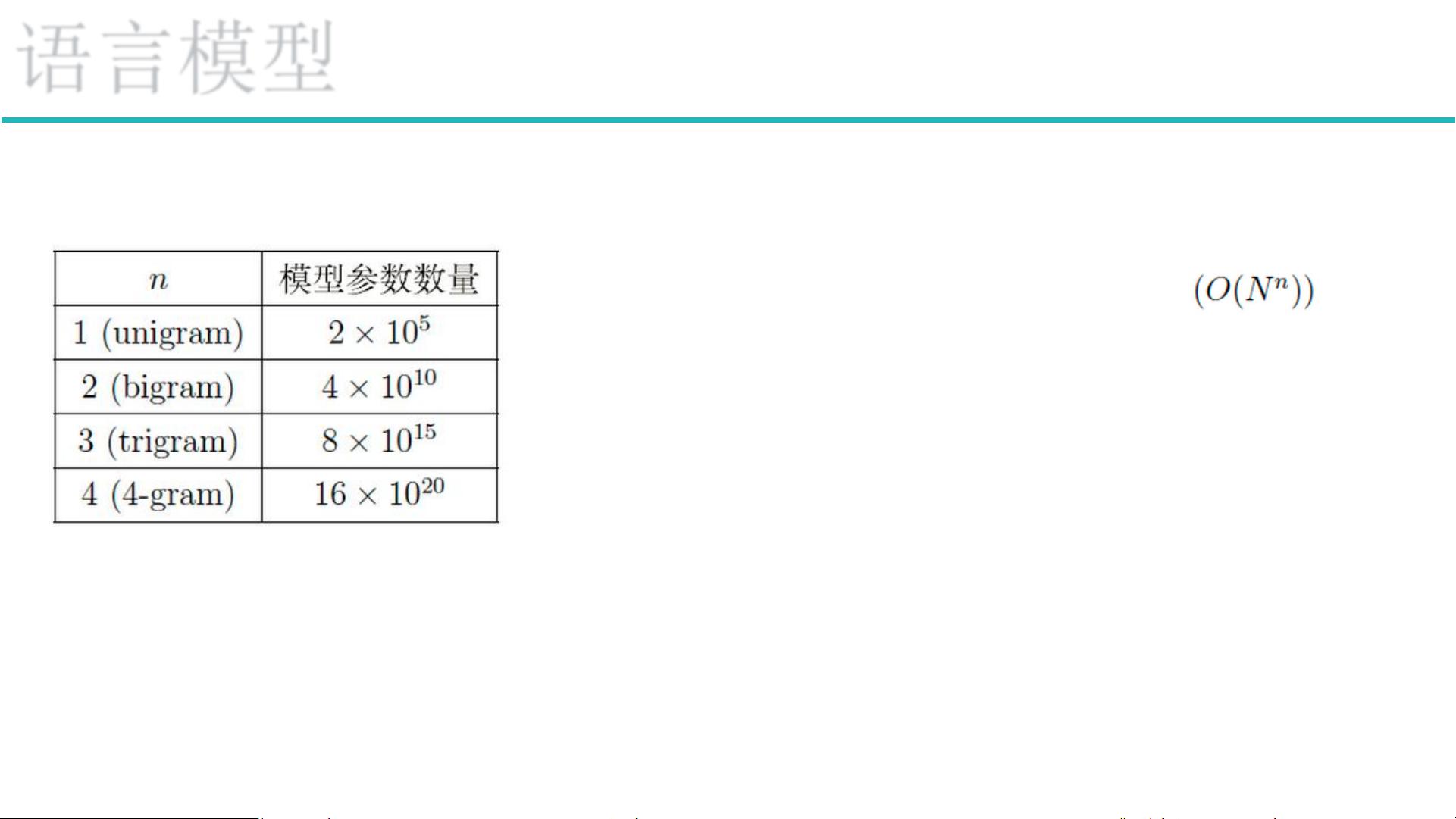

课程重点讲述了语言模型,它是衡量一个句子在给定语言中出现概率的数学工具。例如,公式p(S)=p(w1)p(w2|w1)p(w3|w1,w2)p(wn|w1,w2,...,wn-1)表示一个句子的概率是其组成词概率的乘积。语言模型面临的挑战包括数据稀疏性和巨大的参数空间,这可能导致过拟合和模型泛化能力下降。为了解决这些问题,课程讨论了不同级别的依赖模型,从依赖一个前导词到依赖两个或更多前导词。

词向量是NLP中的另一个核心概念,它们将词汇转化为连续的向量表示,使得词与词之间的语义关系可以通过向量运算来捕捉。例如,词向量可以用于计算"I want English food"的概率,通过将"I want"、"Chinese"和"food"的向量进行运算,得到"I want Chinese food"的概率。

神经网络模型,如CBOW(Continuous Bag-of-Words Model),是深度学习在NLP中的具体应用。CBOW模型通过考虑一个单词的上下文来预测该单词,从而提高了对常见短语和句子结构的理解。与传统的N-gram模型相比,神经网络模型能够更好地捕捉语料库中的长距离依赖,即使某些特定的句子在语料库中出现频率较低,模型也能给出相对合理的概率估计。

这份文本挖掘课程PDF为学习者提供了深度学习和NLP基础知识的全面介绍,特别是语言模型和词向量的应用,有助于提升对自然语言处理的理解和实践能力。