深度学习解析:技术、迭代与局限

需积分: 0 49 浏览量

更新于2024-09-10

收藏 3.17MB DOCX 举报

"这篇机器学习笔记主要探讨了深度学习的技术原理、迭代路径和局限性,重点关注神经元、神经网络、分类器以及深度学习框架。"

深度学习是机器学习的一个重要分支,它通过模拟人脑神经网络的工作机制来处理和学习数据。在深度学习的核心——神经元中,每个神经元都是一个包含线性函数和非线性激活函数的复合体。线性函数用于模型训练,而激活函数如Sigmoid、ReLU等则引入非线性,以解决线性模型可能面临的欠拟合问题,使网络能够学习更复杂的模式。

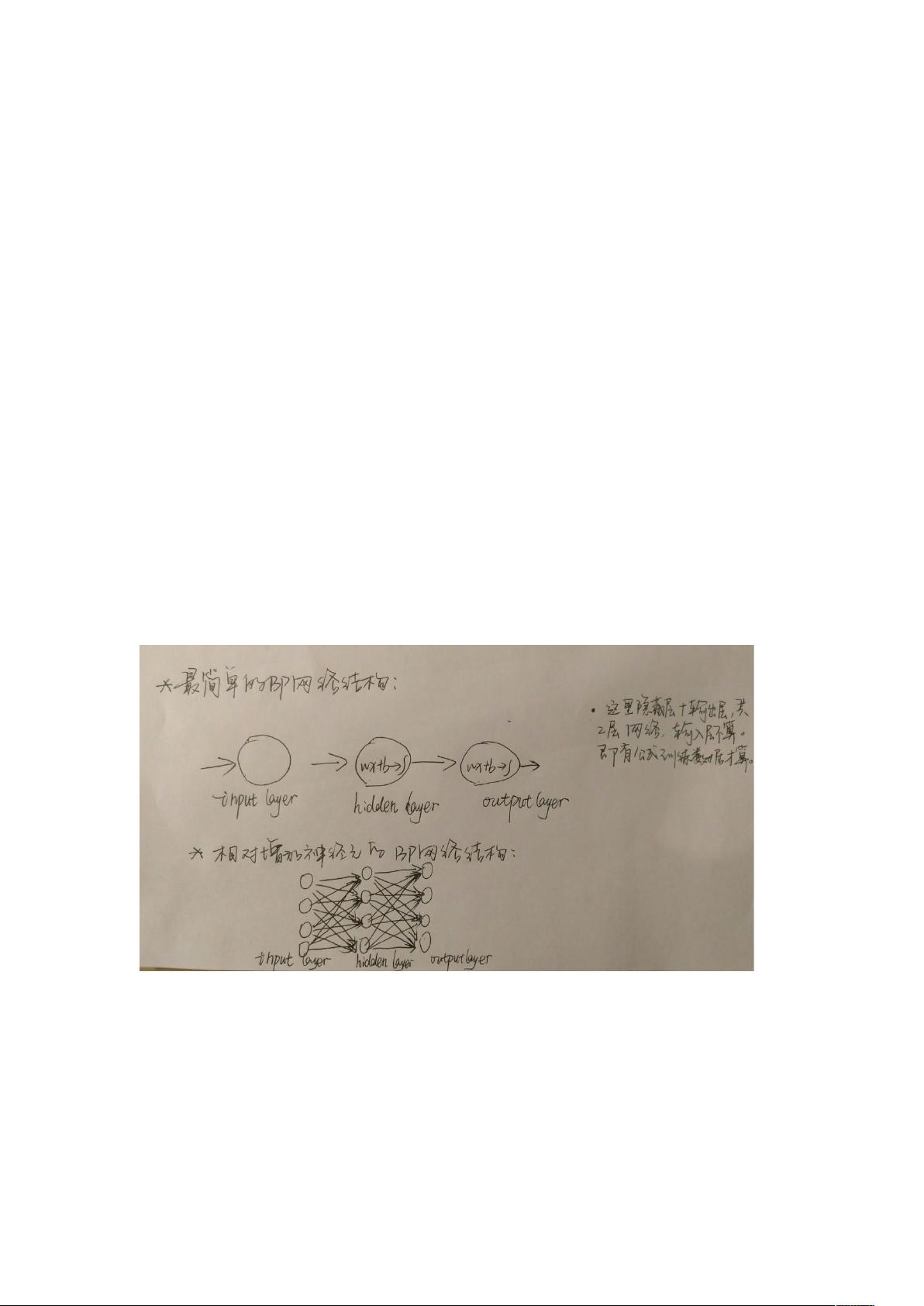

神经元通过连接形成神经网络,其中最基础的网络结构包含输入层、隐藏层和输出层。深度神经网络(DNN)进一步扩展了这一概念,拥有多个隐藏层,能够处理更复杂的任务,例如图像识别、自然语言处理等。与传统机器学习方法相比,深度学习的一大优势在于其自动特征学习能力,无需人为定义特征,能从原始数据中自下而上地学习层次化的表示。

在传统机器学习中,算法如朴素贝叶斯、决策树、回归模型和SVM依赖于人为设计的特征和明确的分类标签。然而,深度学习中的分类器如卷积神经网络(CNN)、循环神经网络(RNN)等能够自动从数据中提取特征并进行分类,降低了对特征清晰度的依赖,并能处理模糊和噪声数据。

深度学习框架在实际应用中起着关键作用,如TensorFlow、Caffe、Chainer、Torch和Theano等。TensorFlow是谷歌开发的流行开源框架,它提供了灵活的计算图构建方式,支持分布式训练,并且有一套丰富的工具库供开发者使用。在实践中,这些框架使得模型的构建、训练和优化变得更加便捷。

尽管深度学习取得了显著的成功,但它也有自身的局限性。首先,训练深度学习模型通常需要大量的标注数据,这在某些领域可能是难以获取的。其次,深度学习模型的解释性相对较弱,即“黑箱”问题,这在需要透明度和可解释性的场景中是个挑战。最后,训练过程中的过拟合和梯度消失/爆炸问题也是深度学习需要克服的关键难点。

这篇笔记提供了一个深度学习基础知识的概览,涵盖了从基本的神经元结构到深度学习框架的使用,同时也提到了深度学习相对于传统机器学习的优势和当前面临的问题。对于想要深入理解深度学习的读者来说,这是一个很好的起点。

2023-12-27 上传

2020-09-28 上传

2024-01-08 上传

2023-09-01 上传

2023-08-17 上传

2023-08-12 上传

2023-07-27 上传

2023-09-22 上传

2023-07-05 上传

yindangchi

- 粉丝: 0

- 资源: 11

最新资源

- 深入理解23种设计模式

- 制作与调试:声控开关电路详解

- 腾讯2008年软件开发笔试题解析

- WebService开发指南:从入门到精通

- 栈数据结构实现的密码设置算法

- 提升逻辑与英语能力:揭秘IBM笔试核心词汇及题型

- SOPC技术探索:理论与实践

- 计算图中节点介数中心性的函数

- 电子元器件详解:电阻、电容、电感与传感器

- MIT经典:统计自然语言处理基础

- CMD命令大全详解与实用指南

- 数据结构复习重点:逻辑结构与存储结构

- ACM算法必读书籍推荐:权威指南与实战解析

- Ubuntu命令行与终端:从Shell到rxvt-unicode

- 深入理解VC_MFC编程:窗口、类、消息处理与绘图

- AT89S52单片机实现的温湿度智能检测与控制系统