GoogLeNet模型实现与结果分析-TensorFlow2

178 浏览量

更新于2024-09-01

收藏 74KB PDF 举报

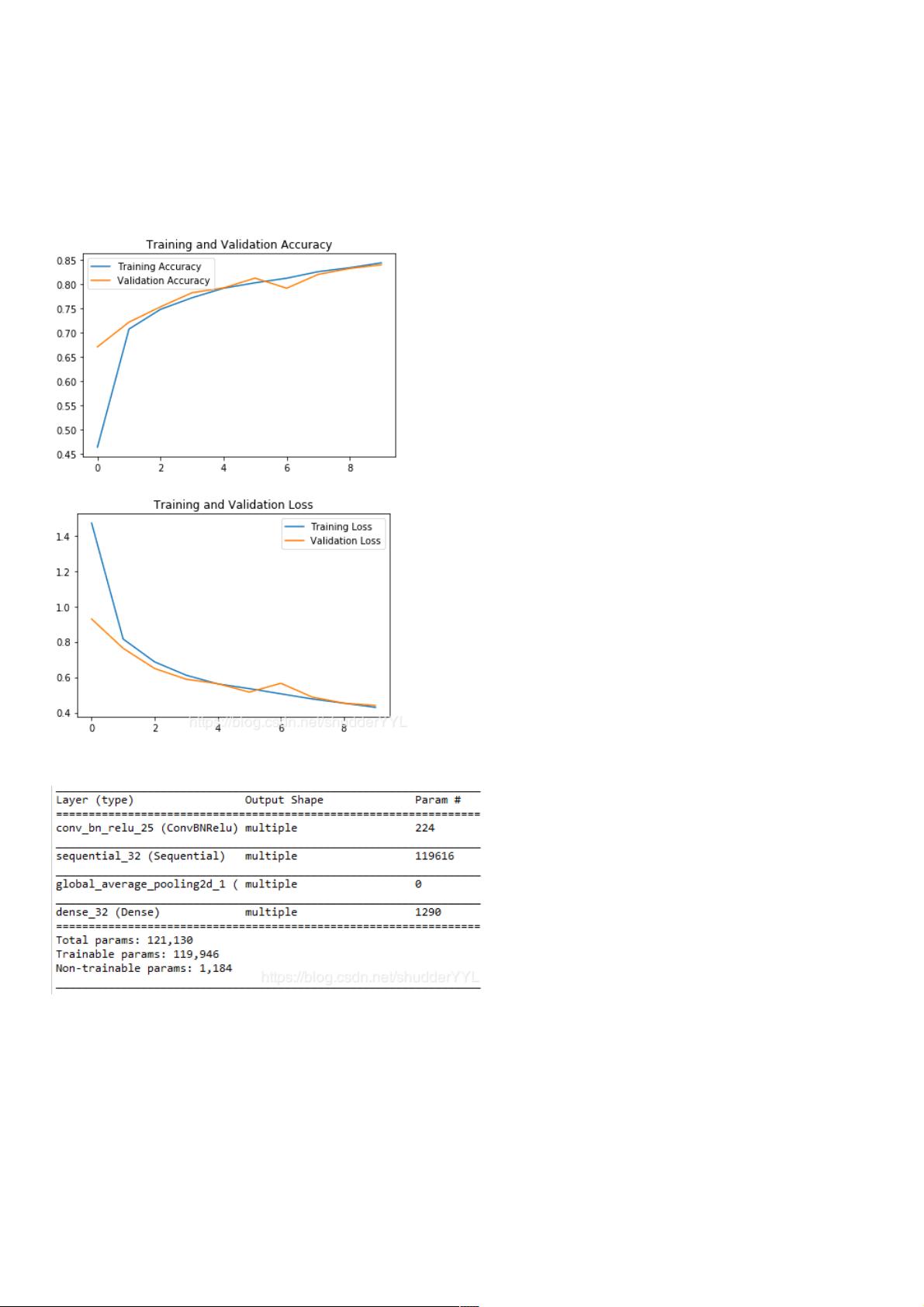

"GoogLeNet卷积神经网络在TensorFlow2框架下的实现,包括结果展示、损失(loss)与准确率(acc)曲线的绘制以及计算参数的程序代码。"

GoogLeNet是一种深度卷积神经网络,最初由Google在2014年的ImageNet竞赛中提出,因其网络结构中含有Inception模块而著名。这个模型的设计目的是解决当时深度网络中存在的计算复杂度和参数数量过多的问题。GoogLeNet通过引入并行的卷积核和池化层结构,降低了计算需求,同时保持了网络的深度和宽度,从而在性能和效率上取得了良好的平衡。

在TensorFlow2中实现GoogLeNet,首先需要导入必要的库,如`tensorflow`用于深度学习操作,`numpy`用于数值计算,`matplotlib`用于绘制图表,以及`keras`的高级API,使得模型构建更加便捷。在这个例子中,还定义了一个自定义的`ConvBNRelu`类,该类结合了卷积、批量归一化(Batch Normalization)和ReLU激活函数,这是构建Inception模块的基本组件。

数据预处理部分,这里使用的是Fashion-MNIST数据集,它包含10类不同的衣物图片。数据集加载后,将像素值归一化到0-1之间,并将输入图像调整为具有额外一维的四维张量,以便适应卷积网络的输入要求。

`ConvBNRelu`类的构造函数定义了卷积层的配置,包括卷积核大小、步长和填充方式。通过`tf.keras.Model`的子类化,我们可以创建自定义的层或模型,这使得构建复杂的网络结构变得更加灵活。在实际的GoogLeNet网络构建中,会使用多个这样的`ConvBNRelu`实例来构建Inception模块,每个模块都有不同尺寸的卷积核,以捕捉不同尺度的特征。

训练过程中,通常会监控损失(loss)和准确率(acc)的变化。在描述中提到的训练结果是经过10个epochs后的,准确率为83.98%。损失和准确率的曲线可以通过`matplotlib`库进行绘制,这样可以直观地观察模型的训练过程和性能。

GoogLeNet的TensorFlow2实现涉及到了深度学习的基础知识,包括卷积神经网络的构建、数据预处理、模型训练和性能评估。同时,通过自定义层展示了高级API的灵活性,这对于理解和实现其他复杂的网络结构也大有裨益。

455 浏览量

424 浏览量

2287 浏览量

2021-10-02 上传

1502 浏览量

153 浏览量

点击了解资源详情

180 浏览量

131 浏览量

weixin_38562329

- 粉丝: 1

- 资源: 949