深度解析:卷积神经网络(CNN)原理与实践

需积分: 24 124 浏览量

更新于2024-07-18

收藏 766KB PDF 举报

"CNN详细介绍——卷积神经网络的深度解析"

卷积神经网络(CNN,Convolutional Neural Networks)是深度学习领域中的一个重要组成部分,尤其在图像识别、计算机视觉任务中表现出色。本文将深入探讨CNN的基本原理和操作,通过实例帮助理解其工作方式。

1. 引言

卷积神经网络起源于1980年代,近年来由于计算能力的提升和大量数据的可用性而得到了广泛的应用。CNN的主要优势在于能够捕捉图像的局部特征,并通过层次结构进行特征提取,这使得它们在处理图像和视频等高维数据时具有高效性和准确性。

2. 基础知识

- 张量与向量化:在CNN中,数据通常以多维数组(张量)的形式存在。向量化是将张量转换为一维向量的过程,便于计算和处理。

- 向量微积分与链式法则:理解这些概念是计算梯度和执行反向传播的关键,用于更新网络参数以优化模型性能。

3. CNN概述

- 架构:CNN通常由输入层、多个卷积层、池化层、全连接层和输出层组成。

- 前向运行:数据通过网络层层传递,每个层应用不同的操作,如卷积、激活函数和池化。

- 随机梯度下降(SGD):CNN训练常用优化算法,通过迭代调整权重以最小化损失函数。

- 错误反向传播:从输出层开始,计算损失函数关于每个参数的梯度,然后反向传播更新权重。

4. 层输入、输出与表示

每层都有特定的输入和输出规格,例如卷积层的输入是前一层的输出,输出是通过卷积操作得到的特征图。

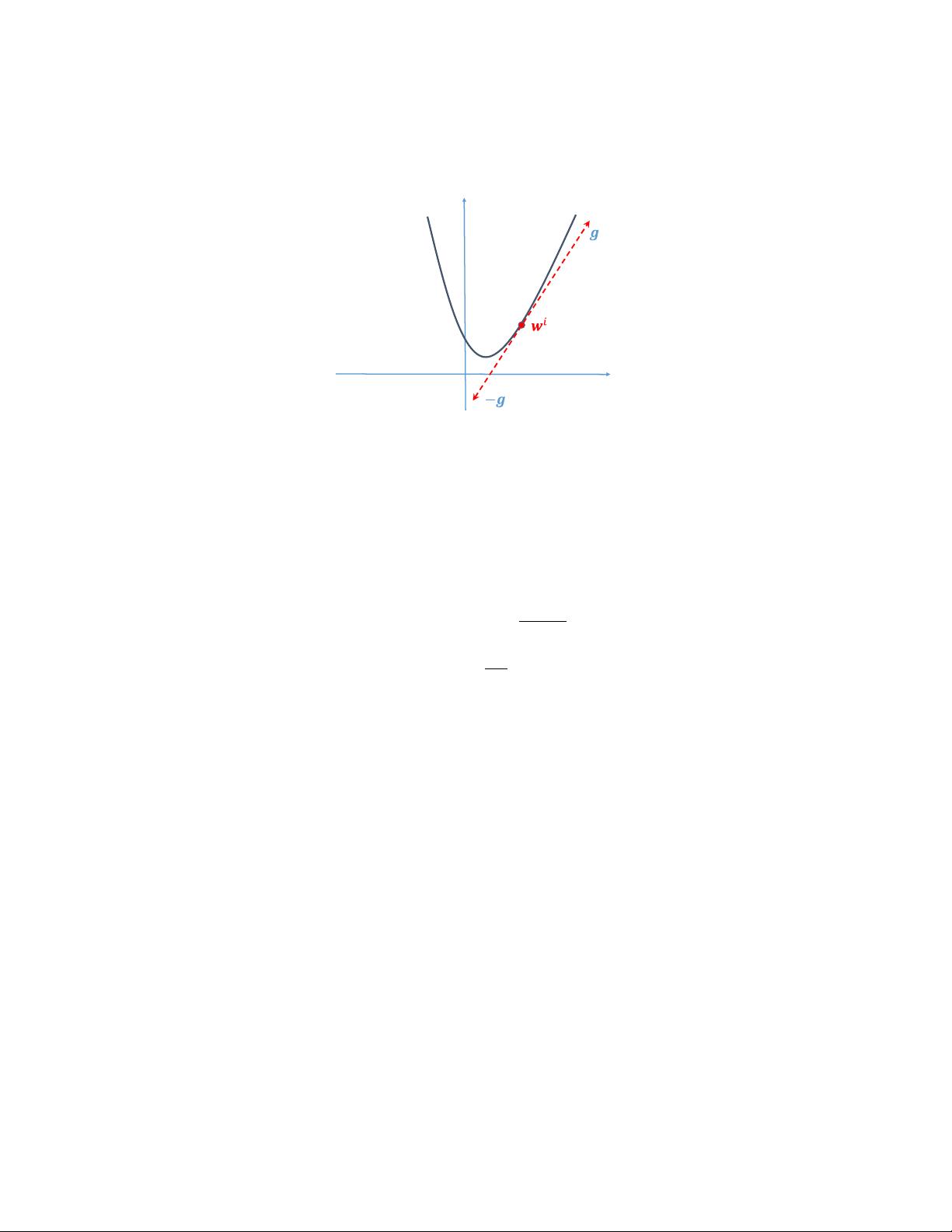

5. 激活函数层

ReLU(Rectified Linear Unit)层是最常见的激活函数,引入非线性以增强模型表达能力。

6. 卷积层

- 卷积定义:卷积操作是核(filter)与输入数据的滑动运算,用于检测特征。

- 为何卷积:通过局部连接和权重共享减少参数数量,提高计算效率并防止过拟合。

- 卷积作为矩阵乘法:通过展平和拉伸,可以将卷积视为两个矩阵的乘积。

- 克罗内克积:在实现高效卷积计算时,克罗内克积是一个重要的工具。

- 反向传播:计算梯度以更新卷积核,同时为前一层准备监督信号。

- 高维指示矩阵:在反向传播中,高维矩阵用于存储和传递信息。

7. 池化层

池化层用于减小数据的空间维度,提高模型的不变性,例如最大池化能保留最重要特征。

8. 案例研究:VGG-16网络

VGG-16是一个非常深的CNN架构,由16层组成,其中包含多个连续的卷积层,以极小的滤波器尺寸(3x3)增加网络深度。接收域的概念在此网络中尤为重要,它描述了输入数据的一个部分如何影响输出。

9. 结论

CNN因其独特的设计在图像处理任务中表现出强大的性能。理解其工作原理对于构建和优化自己的CNN模型至关重要。

10. 练习

为了巩固所学知识,文章提供了相关练习题目以供读者实践。

CNN通过其特有的卷积和池化操作,能有效地学习和提取图像数据的特征,是深度学习中不可或缺的一部分。通过本文的深入解析,读者应能更好地理解和运用CNN解决实际问题。

2018-05-28 上传

2024-09-26 上传

2023-05-24 上传

2023-09-07 上传

2023-02-24 上传

2023-05-10 上传

2023-04-28 上传

追求一个梦想s

- 粉丝: 6

- 资源: 10

最新资源

- 俄罗斯RTSD数据集实现交通标志实时检测

- 易语言开发的文件批量改名工具使用Ex_Dui美化界面

- 爱心援助动态网页教程:前端开发实战指南

- 复旦微电子数字电路课件4章同步时序电路详解

- Dylan Manley的编程投资组合登录页面设计介绍

- Python实现H3K4me3与H3K27ac表观遗传标记域长度分析

- 易语言开源播放器项目:简易界面与强大的音频支持

- 介绍rxtx2.2全系统环境下的Java版本使用

- ZStack-CC2530 半开源协议栈使用与安装指南

- 易语言实现的八斗平台与淘宝评论采集软件开发

- Christiano响应式网站项目设计与技术特点

- QT图形框架中QGraphicRectItem的插入与缩放技术

- 组合逻辑电路深入解析与习题教程

- Vue+ECharts实现中国地图3D展示与交互功能

- MiSTer_MAME_SCRIPTS:自动下载MAME与HBMAME脚本指南

- 前端技术精髓:构建响应式盆栽展示网站