图神经网络对抗攻击与防御是当前研究领域的重要议题,尤其是在处理图数据时,由于其非欧几里得性质,对抗攻击的存在可能导致模型性能显著下降。这篇PPT分享了两个关键的研究成果,首先是KDD 2018年的最佳论文,探讨了在图神经网络(GNN)上实施的对抗攻击。

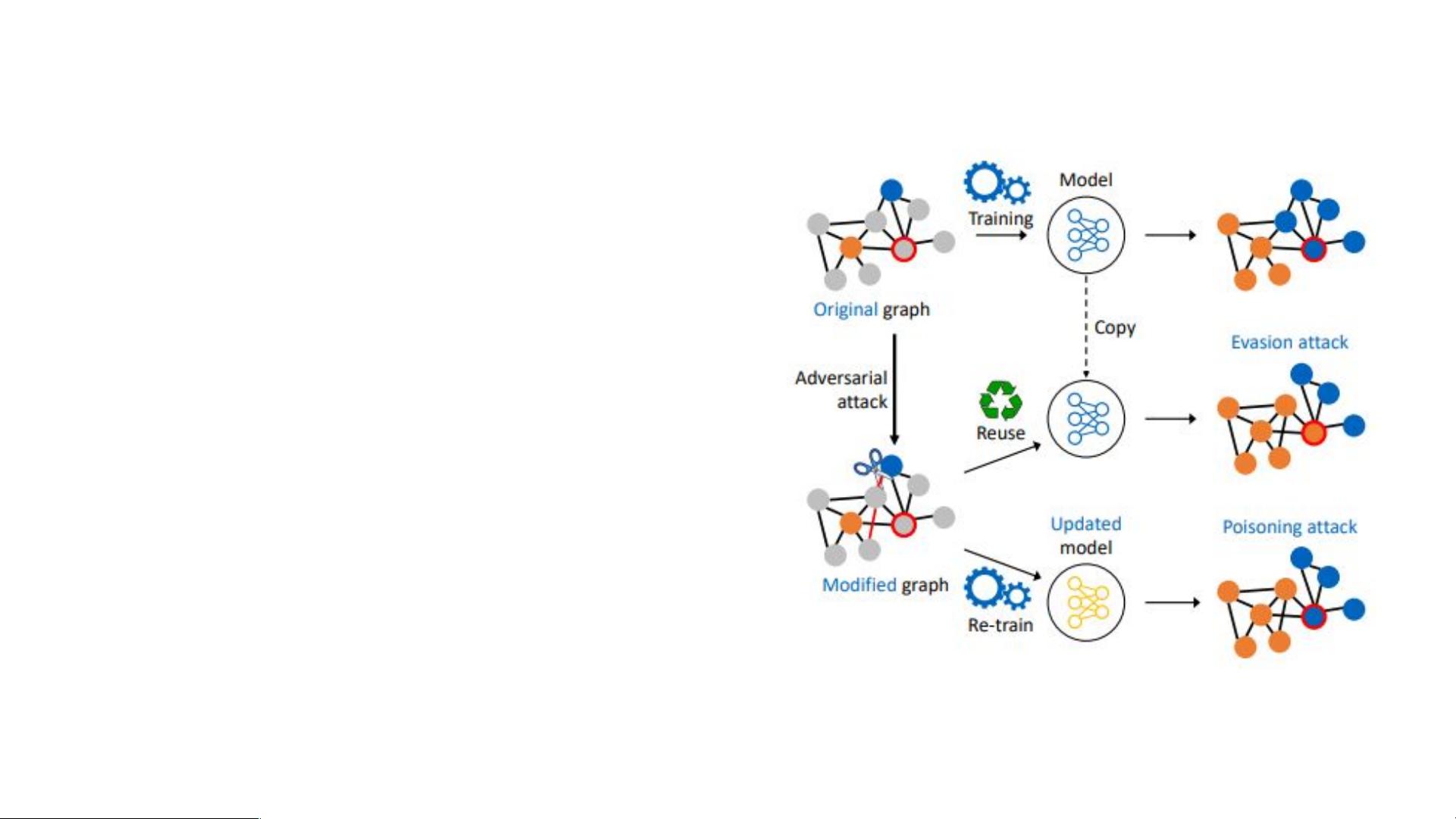

在KDD2018论文中,主要关注两种类型的攻击:投毒攻击(Poisoning Attack)和逃逸攻击(Evasion Attack)。投毒攻击发生在模型训练阶段,攻击者通过篡改训练数据,使模型学习到错误的模式,从而影响其预测能力。而逃逸攻击则发生在模型部署后,攻击者利用已知的模型结构,对测试样本施加微小但足以误导的扰动,挑战的是设计一种方法让扰动不易察觉。

问题的核心在于如何定义和实现“不明显的”扰动,即在保持图的固有属性的同时进行最小化影响。论文提出了一种核心思想,即限制扰动只针对那些不会改变图基本特性(如结构、特征和标签)的部分。此外,通过实验评估了在有限知识情况下对抗攻击的效果,结果显示在没有防御措施(Panel A)下,模型容易发生误分类。

另一方面,NeurIPS 2020的GNNGUARD算法是一个通用的防御框架,它旨在保护图神经网络免受对抗攻击。GNNGUARD的设计策略包括检测虚假边缘、降低虚假连接的权重,以及利用邻接节点的重要性来量化消息传递。例如,研究发现,连接相似节点的边通常会传递更多信息,因此通过估计邻居的重要性并调整边的权重,可以增强模型的鲁棒性。

论文还引用了其他研究成果,如[1]和[2],它们深入探讨了图数据中的对抗样本,以及社交网络中的同质性(homophily)现象。GNNGUARD的实验结果显示,当结合层间记忆(Layer-wise Memory)机制时,模型能够更好地恢复原始图结构,提高了防御效果。通过比较带GNNGuard的Panel B与无防御的Panel A,可以明显看到防御机制的有效性,即在存在GNNGuard时,模型能更准确地进行分类。

图神经网络对抗攻击与防御是一个既具有理论挑战又需实践经验的领域,涉及数据污染检测、模型鲁棒性提升和对抗样本识别等多个层面。随着研究的深入,这些技术有望在实际应用中提高图模型的安全性和可靠性。