GRD-GNN:一种图神经网络的图重构防御对抗攻击方法

版权申诉

44 浏览量

更新于2024-07-03

收藏 3.33MB DOCX 举报

"一种面向图神经网络的图重构防御方法"

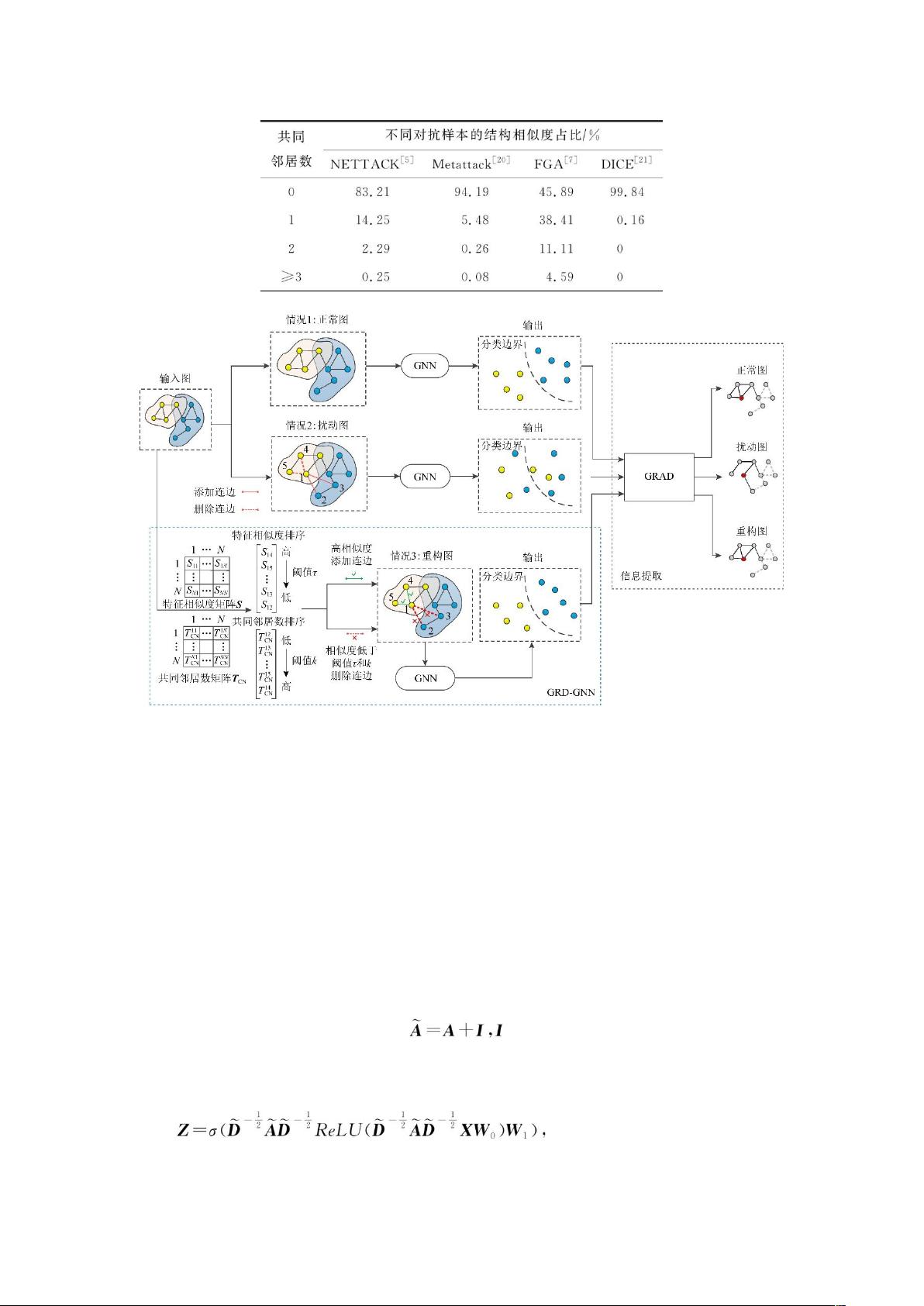

本文介绍了一种新的防御策略,称为GRD-GNN(Graph Reconstruction Defense for Graph Neural Networks),针对图神经网络(GNN)的对抗攻击。GNN在图表示学习领域中有着广泛应用,如电子商务、社交媒体和生物学等,但由于其易受精心设计的对抗攻击的影响,网络的鲁棒性成为了一个关键问题。攻击者可能通过添加或删除连边或创建虚假节点来操纵图结构,从而误导GNN的决策。

现有的防御方法,如对抗训练,虽然在一定程度上提高了模型的鲁棒性,但在不损害主任务性能的同时降低攻击成功率方面仍有待改进。GRD-GNN的独特之处在于它利用了对抗连边通常存在于低结构相似性和低节点特征相似性节点之间的这一现象。通过计算共同邻居数和节点相似度作为相似度指标,GRD-GNN能够检测并移除这些对抗连边,同时重构图结构,添加增强关键特征的连边,从而提高防御效果。

在实验部分,GRD-GNN在三个真实数据集上进行了测试,与现有防御方法对比,显示出了最佳的防御性能,同时保持了对正常图数据分类任务的高准确性。此外,通过可视化手段,作者进一步解释了防御结果,证实了GRD-GNN方法的有效性。

图神经网络的核心在于通过多层信息传播和聚合来学习节点和边的表示。在面对对抗攻击时,这些信息传播过程可能会被恶意篡改。GRD-GNN通过重构图结构,确保了信息传递的正确性和模型的稳定性。这一方法不仅有助于防止恶意行为对GNN的影响,还有潜力应用于各种图数据驱动的应用中,如社交网络分析、推荐系统和生物信息学中的网络分析。

GRD-GNN提供了一种创新的图重构策略,增强了图神经网络对对抗攻击的抵抗力,为未来在图数据安全和鲁棒性方面的研究提供了新的方向。通过深入理解图结构和节点特征的相互作用,该方法有望进一步优化,以适应更复杂的攻击场景,并在实际应用中发挥更大的作用。

2022-05-29 上传

2022-05-28 上传

2023-02-23 上传

罗伯特之技术屋

- 粉丝: 4410

- 资源: 1万+

最新资源

- 天池大数据比赛:伪造人脸图像检测技术

- ADS1118数据手册中英文版合集

- Laravel 4/5包增强Eloquent模型本地化功能

- UCOSII 2.91版成功移植至STM8L平台

- 蓝色细线风格的PPT鱼骨图设计

- 基于Python的抖音舆情数据可视化分析系统

- C语言双人版游戏设计:别踩白块儿

- 创新色彩搭配的PPT鱼骨图设计展示

- SPICE公共代码库:综合资源管理

- 大气蓝灰配色PPT鱼骨图设计技巧

- 绿色风格四原因分析PPT鱼骨图设计

- 恺撒密码:古老而经典的替换加密技术解析

- C语言超市管理系统课程设计详细解析

- 深入分析:黑色因素的PPT鱼骨图应用

- 创新彩色圆点PPT鱼骨图制作与分析

- C语言课程设计:吃逗游戏源码分享