深度解析Apollo感知模块:障碍物检测与融合算法

需积分: 0 30 浏览量

更新于2024-06-28

收藏 6.3MB PDF 举报

在"Apollo感知模块详解与实践2"中,该课程由讲师永辉主讲,专为刚接触Apollo自动驾驶感知模块或对此有一定了解但寻求深入学习的人群设计。课程的核心目标是提供一个系统且全面的理解,包括感知模块在自动驾驶中的关键作用。

首先,课程介绍了Apollo感知框架,它是一个集成多种传感器数据(如摄像头、雷达和激光雷达)的关键组件。这些传感器协同工作,能够识别障碍物、车道线、红绿灯等,并预测它们的运动和位置信息,如航向和速度。通过融合多源数据,感知模块能够生成更精确的车辆周围环境模型。

Lidar障碍物检测是感知模块的重要部分,它利用点云数据对周围环境进行高精度扫描,能够检测到远处的障碍物并进行分类。此外,课程也提到了Paddle3D、PaddleSeg以及基于Paddlepaddle的相关项目,这些工具和框架在点云障碍物检测、自动驾驶语义分割和行车检测等领域有广泛应用,展示了如何通过深度学习技术提高感知模块的性能。

相机在感知模块中负责车道线检测、红绿灯识别以及障碍物检测,其单帧检测结果虽然包含类型、位置和航向等信息,但对于物体动态的预测能力有限。为了弥补这一不足,障碍物跟踪功能通过连续帧的处理,实现了对物体运动状态的持续追踪,提高了整体的决策准确性。

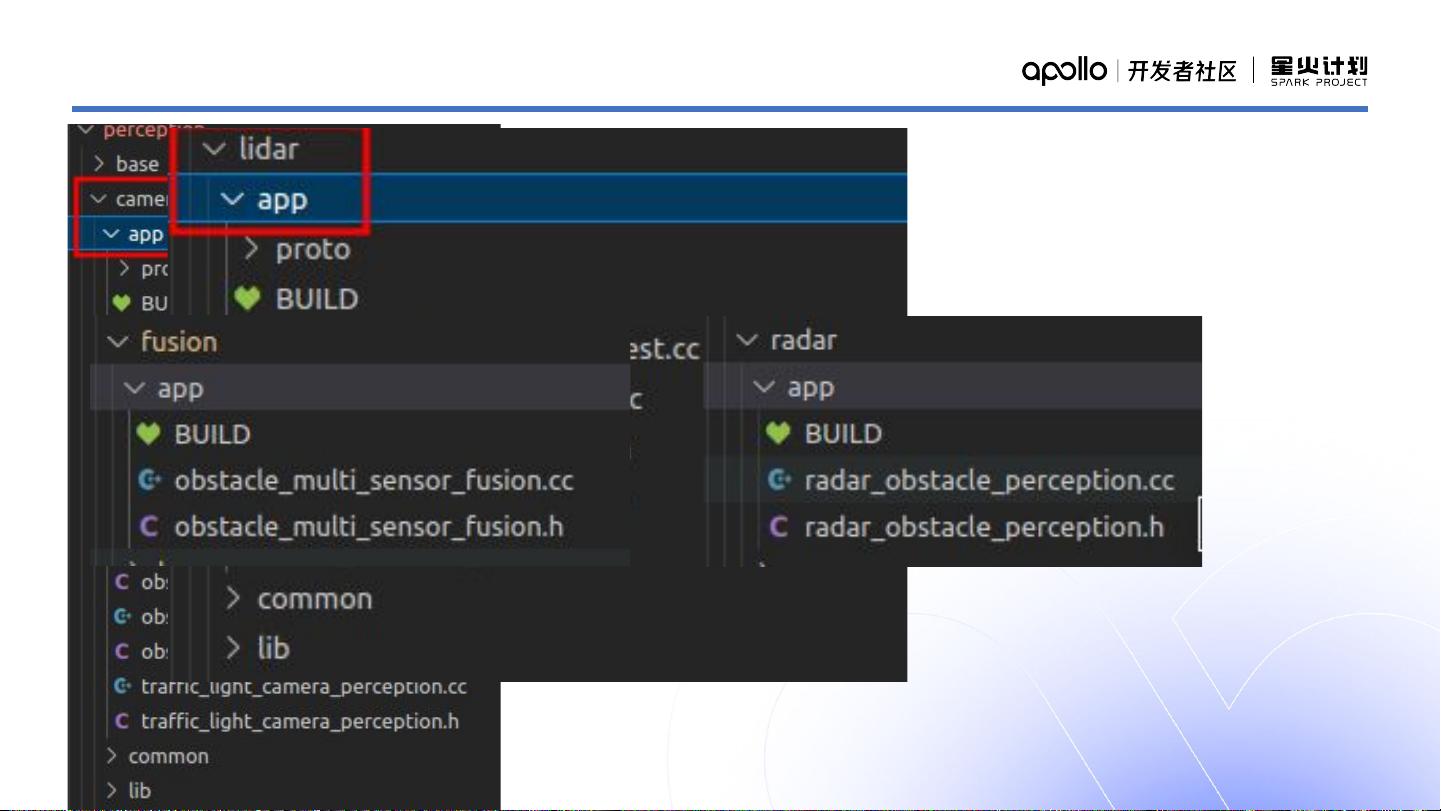

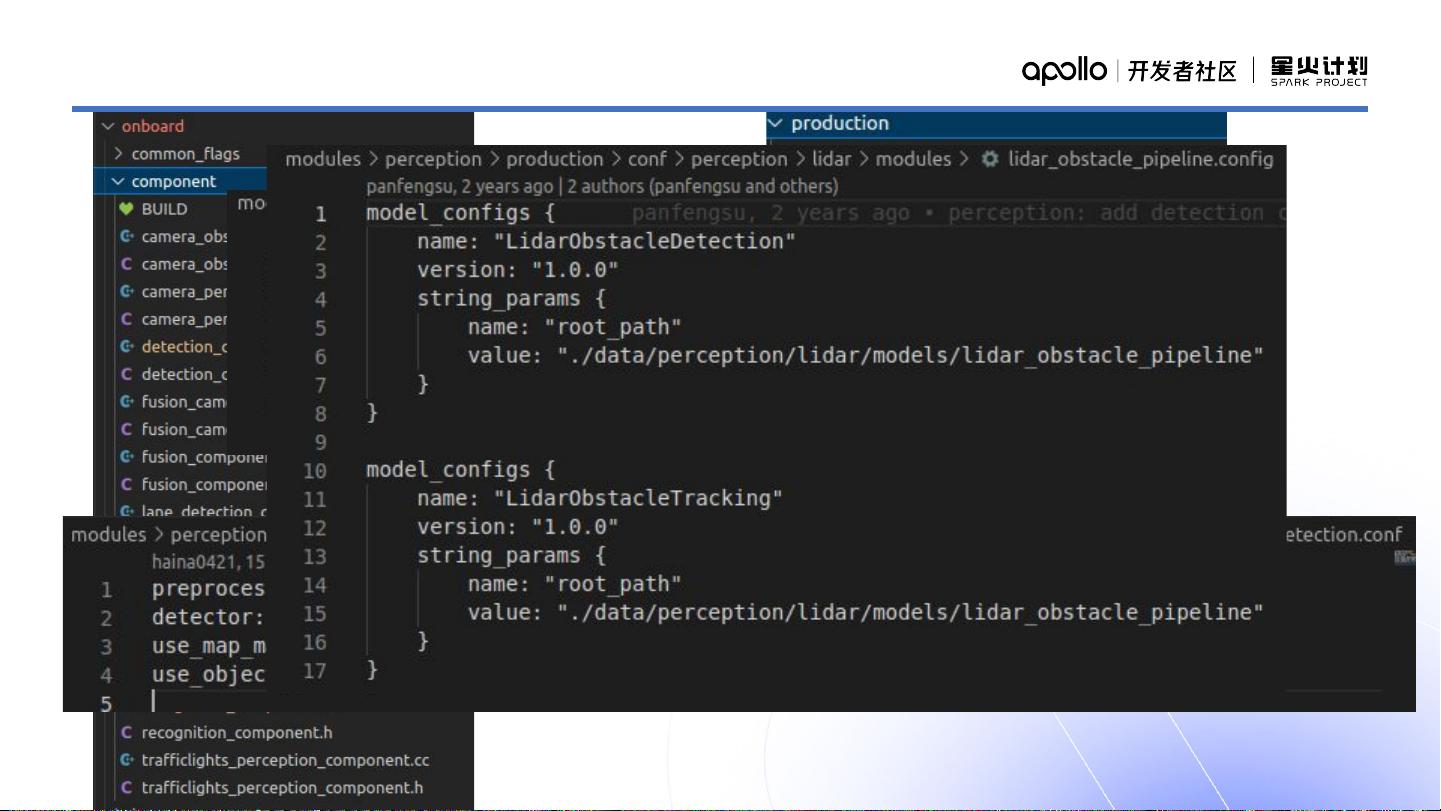

感知模块的代码结构清晰,分为camera、lidar、fusion、radar和onboard&production等多个模块。相机和lidar专注于实时数据处理,融合模块负责整合不同传感器的数据,而radar则可能用于补充其他传感器的信息。onboard和production阶段可能涉及模块的优化和实际部署,确保在复杂道路环境中保持稳定和高效。

通过本课程,学习者不仅能掌握感知模块的基本原理和工作流程,还能了解到如何结合具体工具和技术进行实践操作,从而为构建安全、可靠的自动驾驶系统打下坚实基础。学习者将有机会看到实际的代码示例,了解如何学习和应用关键算法,以便更好地理解和掌握Apollo自动驾驶感知模块的精髓。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2022-12-08 上传

2022-12-08 上传

2022-12-08 上传

2021-10-02 上传

2022-12-08 上传

2022-12-09 上传

Ponnyao

- 粉丝: 8443

- 资源: 33

最新资源

- react_synthPad_2021

- 简历

- 基于角点检测和非局部相似性的视频压缩感知重构算法

- tls:过境最小二乘:一种优化的过境拟合算法,用于搜索小行星的周期性过境

- DeepCache:移动版CNN的缓存设计

- botsquad:自动化代理即服务

- 美萍超市销售管理系统标准版

- vcurrency:https的API包装器(用V编写)

- c代码-回文检查(正反读都一样的)

- openGJK:针对C,C#和Matlab的Gilbert-Johnson-Keerthi(GJK)算法的快速可靠实现

- nano-2.2.1.tar.gz

- iOS17.0真机调试包

- CRUD_PHP_PDO_MYSQL:CRUD SIMPLES COM PHP + PDO + MYSQL

- latteminjae.github.io

- stl_test:STL中deque、list、vector、stack、map、set、hashmap的基本应用

- ruhue:试用Philips Hue,记录下我的进度