KNN算法详解:最近邻分类与平衡秤TXT数据集应用

需积分: 0 96 浏览量

更新于2024-06-30

收藏 1016KB PDF 举报

"该资源是一篇关于KNN(K-Nearest Neighbors,最近邻)分类算法的详解文章,属于Python数据挖掘课程的一部分,作者通过分析平衡秤TXT数据集来阐述KNN算法的基础原理和应用。文章涵盖了KNN算法的基本知识、预测坐标类型的分析、使用Pandas读取TXT数据集、在平衡秤数据集上的应用以及算法优化。"

在机器学习领域,KNN算法是一种简单而直观的分类方法。它基于“物以类聚”的思想,即一个样本的类别由其最近的K个邻居的类别决定。KNN算法的核心步骤包括以下几个方面:

1. **KNN算法基础原理**:KNN算法首先计算待分类样本与训练集中每个样本的距离,然后选取距离最近的K个样本,根据这K个样本的类别出现频率来决定待分类样本的类别。这里的距离可以是欧氏距离、曼哈顿距离或余弦相似度等。

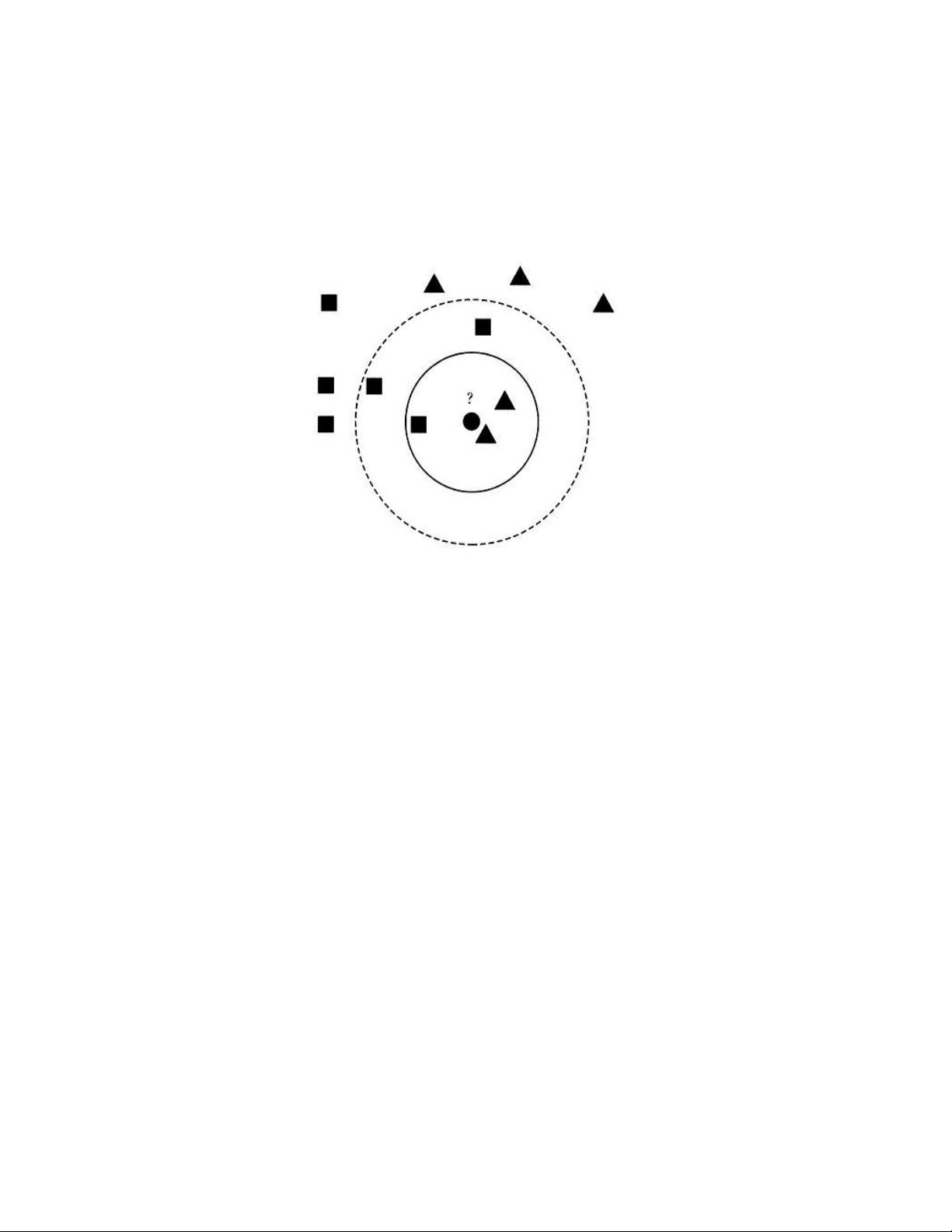

2. **最近邻分类算法分析预测坐标类型**:在二维或高维空间中,预测一个未知样本的类别时,KNN算法会找到最近的K个已知类别的样本,若K个样本中多数为某一类别,则预测该未知样本属于这一类别。例如,当K=3时,若一个点被两个同类别样本包围,那么这个点就会被分类到这个类别。

3. **Pandas读取TXT数据集**:在Python中,Pandas库提供了强大的数据处理能力,可以方便地读取TXT数据集。使用`pandas.read_csv()`或`pandas.read_table()`函数,可以轻松将TXT数据加载成DataFrame对象,便于后续的数据预处理和分析。

4. **KNN分析平衡秤数据集**:平衡秤数据集可能包含不同物体的质量和平衡状态,KNN算法可以用于预测未知物体在特定条件下是否能使天平保持平衡。通过计算新样本与其他已知样本的距离,判断其可能的平衡状态。

5. **算法优化**:KNN算法虽然简单,但也存在一些优化问题,如选择合适的K值、距离度量的选择、异常值处理、剪枝策略等。K值的选择对结果有很大影响,过小可能导致过拟合,过大则可能导致噪声影响增大;合适的距离度量可以提高分类效果;异常值可能对分类结果产生误导,需要合理处理。

在实际应用中,KNN算法常用于分类任务,尤其是在数据挖掘和模式识别领域。虽然它的计算复杂度较高,但在小规模数据集或特定场景下仍能展现出良好的性能。此外,KNN还可以与其他机器学习方法结合,如集成学习,以提升整体预测能力。

本篇文章不仅介绍了KNN算法的理论知识,还通过实际案例展示了如何使用Python进行数据读取和分析,对于初学者来说,是一个很好的学习资源。作者提到的其他Python数据挖掘课程文章,可以作为进一步学习的参考资料,帮助读者全面掌握数据挖掘的相关技能。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2022-09-20 上传

2023-04-26 上传

2022-09-19 上传

2022-09-24 上传

2017-11-22 上传

2021-04-19 上传

笨爪

- 粉丝: 890

- 资源: 333

最新资源

- MATLAB实现小波阈值去噪:Visushrink硬软算法对比

- 易语言实现画板图像缩放功能教程

- 大模型推荐系统: 优化算法与模型压缩技术

- Stancy: 静态文件驱动的简单RESTful API与前端框架集成

- 掌握Java全文搜索:深入Apache Lucene开源系统

- 19计应19田超的Python7-1试题整理

- 易语言实现多线程网络时间同步源码解析

- 人工智能大模型学习与实践指南

- 掌握Markdown:从基础到高级技巧解析

- JS-PizzaStore: JS应用程序模拟披萨递送服务

- CAMV开源XML编辑器:编辑、验证、设计及架构工具集

- 医学免疫学情景化自动生成考题系统

- 易语言实现多语言界面编程教程

- MATLAB实现16种回归算法在数据挖掘中的应用

- ***内容构建指南:深入HTML与LaTeX

- Python实现维基百科“历史上的今天”数据抓取教程